如果你也在 怎样代写统计推断statistical inference这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

统计推断是利用数据分析来推断概率基础分布的属性的过程。推断性统计分析推断出人口的属性,例如通过测试假设和得出估计值。

statistics-lab™ 为您的留学生涯保驾护航 在代写统计推断statistical inference方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写统计推断statistical inference代写方面经验极为丰富,各种代写统计推断statistical inference相关的作业也就用不着说。

我们提供的统计推断statistical inference及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等楖率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

统计代写|统计推断作业代写statistical inference代考|REMARKS ON N-P THEORY

A synopsis of criticisms of N-P theory due to Hacking (1965) follows. The N-P hypothesis testing theory is then one of fixing a small size and searching for large power. The rationale behind it is to search for rules for governing our behavior with regard to hypotheses (without hoping to know whether any one of them is true or false) which will ensure that in the long run we shall not be wrong too often. To assert whether $H$ be rejected or not, calculate $D$ (the observables) and if $D \in s$ reject $H$, if $D \notin s$ accept $H$. Such a rule tells us nothing as to whether in a particular case $H$ is true when $D \notin s$ or false when $D \notin s$. If we behave in such a way we shall reject when it is true not more than $100 \alpha \%$ of the time and in addition we may have evidence that we shall reject $H$ sufficiently often when it is false.

Presumably if we behave in such a way and keep $\alpha$ fixed we shall reject hypotheses tested through our lifetimes that are true not more than $100 \alpha \%$ of the time (i.e., there is a very high likelihood that this will happen in the long run), and really one is no more or less certain about any of these hypotheses. But if we had to adopt a testing policy now and were bound to follow it for the rest of our lives so that for every false hypothesis we rejected we would have bestowed upon us $h$ heavenly units and likewise for every true hypothesis we accept, while we lose the same for each true one we reject and every false one we accept then this is the best life long policy-but no one has ever been in this situation. This is of course a pre-trial, not a post trial evaluation.

Now it may be that before a trial a decision must be made (because accuracy is difficult or tedious or it may be economical to do so) only to note whether a trial made is in $s$ or not. This may be wholly rational and in this case N-P theory is an economical post trial evaluation. Of course in some cases, say, a simple $H_{0}$ vs. a simple $H_{1}$, where a MP test exists, the extra knowledge will not change our evaluations of $H_{0}$. In these cases where a rational decision to discard or ignore data the N-P theory is a special case of likelihood.

In any event the N-P theory can be viewed from a likelihood perspective:

$$

\begin{aligned}

P(D \in s \mid H) &=L(H \mid D \in s) \leq \alpha(H) \quad \text { say small relative to } \

P(D \in s \mid K) &=L(K \mid D \in s)=1-\beta(K) \text { so } \

Q &=\frac{L(H \mid D \in s)}{L(K \mid D \in s)} \leq \frac{\alpha(H)}{1-\beta(K)} \quad \text { small. }

\end{aligned}

$$

统计代写|统计推断作业代写statistical inference代考|FURTHER REMARKS ON N-P THEORY

We now reconsider an example presented earlier.

Example $3.2$ (continued)

Suppose we make independent trials of Binary variables with probability $p$ then if we hold $n=$ number trials fixed and got $r$ successes then

$$

P(R=r \mid n)=\left(\begin{array}{l}

n \

r

\end{array}\right) p^{r}(1-p)^{n-r}

$$

For $n=5 H_{0}: p=\frac{1}{2} H_{1}: p=p_{1}<\frac{1}{2}$ and $\alpha=\frac{1}{16}$ a UMP N-P test is

$$

\text { so } \alpha=\left(\frac{5}{0}\right)\left(\frac{1}{2}\right)^{5}+\frac{1}{5}\left(\frac{5}{1}\right)\left(\frac{1}{2}\right)^{5}=\frac{1}{16} \text {. }

$$

Now suppose the trial was conducted until we got $r$ heads which took $n$ trials (random). Then

$$

P(n \mid r)=\left(\begin{array}{c}

n-1 \

r-1

\end{array}\right) p^{r}(1-p)^{n-r} \quad n=r, r+1, \ldots

$$

Note $L_{B}(p \mid r)=L_{N B}(p \mid n)=p^{r}(1-p)^{n-r}$, that is, the binomial and negative binomial likelihoods are the same.

Now suppose for $\alpha=1 / 16$ and $r=1$, so

$$

P\left(N=n \mid r=1, p=\frac{1}{2}\right)=\left(\begin{array}{l}

1 \

2

\end{array}\right)^{n}

$$

such that

$$

P(N \leq 4)=\frac{1}{2}+\frac{1}{4}+\frac{1}{8}+\frac{1}{10}=\frac{15}{16}

$$

or $P(N \geq 5)=1 / 16$, hence

$$

T(n)=\left{\begin{array}{lll}

1 & \text { if } & n \geq 5 \

0 & \text { if } \quad n \leq 4

\end{array}\right.

$$

Now if the data in both experiments were $r=1, n=5$ then for the Binomial trials we would reject with probability $\frac{1}{5}$ and with the negative binomial trials we would reject with probability 1 . So as previously noted the likelihood principle and likelihood tests are contradicted although in both cases

$$

L=p(1-p)^{4}

$$

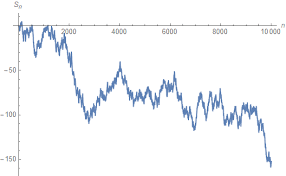

统计代写|统计推断作业代写statistical inference代考|LAW OF THE ITERATED LOGARITHM

Let $X_{1}, X_{2}, \ldots$ be i.i.d. random variables with $E\left(X_{i}\right)=\mu \operatorname{Var}\left(X_{i}\right)=\sigma^{2}$ and $E|X|^{2+\delta}<\infty$ for some $\delta>0$. Then with probability 1 the inequality

$$

\sum_{i=1}^{n} X_{i}2$. Similarly

$$

\Sigma X_{i}>n \mu+\left(n \sigma^{2} \lambda \log \log n\right)^{\frac{1}{2}} \text { or } \frac{\Sigma X_{i}-n \mu}{\sigma \sqrt{n}}>(\lambda \log \log n)^{\frac{1}{2}}

$$

is satisfied for infinitely many $n$ if $\lambda<2$, but only for finitely many $n$ if $\lambda>2$. Further (almost surely)

$$

\limsup {n \rightarrow \infty} \frac{\left(\Sigma X{i}-n \mu\right) / \sigma \sqrt{n}}{(2 \log \log n)^{\leftarrow}}=1

$$

We apply the LIL to $n$ i.i.d. binary variables where $P\left(X_{i}=0\right)=P\left(X_{i}=1\right)=\frac{1}{2}$ where $E\left(X_{i}\right)=\frac{1}{2}, \operatorname{var}\left(X_{i}\right)=\frac{1}{4}$. Then for $\lambda=1$, consider the event

$$

r<\frac{n}{2}-\left(\frac{n}{4} \log \log n\right)^{\frac{1}{2}} . $$ Sooner or later if we continue sampling then for sufficiently large $n$ $$ (\log \log n)^{\frac{1}{2}}>z_{\alpha}

$$

since $z_{\alpha}$ is a constant. Then

$$

-\left(\frac{n}{4} \log \log n\right)^{\frac{1}{2}}<-\frac{\sqrt{n}}{2} z_{\alpha}

$$

and

$$

\frac{n}{2}-\left(\frac{n}{4} \log \log n\right)^{\frac{1}{2}}<\frac{n}{2}-\frac{\sqrt{n}}{2} z_{\alpha}

$$

Therefore, with probability 1 the inequality

$$

r<\frac{n}{2}-\frac{\sqrt{n}}{2} z_{\alpha}

$$

统计推断代考

统计代写|统计推断作业代写statistical inference代考|REMARKS ON N-P THEORY

Hacking (1965) 对 NP 理论的批评概要如下。NP假设检验理论是固定小尺寸并寻找大功率的理论之一。其背后的基本原理是寻找规则来管理我们关于假设的行为(不希望知道其中任何一个是真还是假),这将确保从长远来看我们不会经常犯错。断言是否H被拒绝与否,计算D(可观察的)如果D∈s拒绝H, 如果D∉s接受H. 这样的规则并没有告诉我们在特定情况下是否H是真的D∉s或 false 时D∉s. 如果我们以这样的方式行事,我们将在其为真时拒绝不超过100一种%的时间,此外,我们可能有证据表明我们将拒绝H当它是错误的时,足够频繁。

大概如果我们以这样的方式行事并保持一种固定我们将拒绝通过我们的一生检验的假设,这些假设不超过100一种%时间(即,从长远来看,这种情况很有可能发生),实际上,人们对这些假设中的任何一个都没有或多或少的把握。但是,如果我们现在必须采用一项测试政策,并且注定要在我们的余生中遵循它,那么对于我们拒绝的每一个错误假设,我们都会赋予我们H天上的单位,同样对于我们接受的每一个真实假设,虽然我们对每一个我们拒绝的真实假设和每一个我们接受的虚假假设都失去了同样的假设,但这是最好的终身政策——但没有人遇到过这种情况。这当然是预审,而不是审后评估。

现在可能是在审判之前必须做出决定(因为准确性是困难或乏味的,或者这样做可能是经济的)只是要注意所进行的审判是否在s或不。这可能是完全合理的,在这种情况下,NP 理论是一种经济的试验后评估。当然在某些情况下,比如说,一个简单的H0与简单的H1,在存在 MP 测试的情况下,额外的知识不会改变我们对H0. 在这些合理决定丢弃或忽略数据的情况下,NP 理论是可能性的一个特例。

无论如何,可以从可能性的角度来看待 NP 理论:

磷(D∈s∣H)=大号(H∣D∈s)≤一种(H) 说相对于小 磷(D∈s∣ķ)=大号(ķ∣D∈s)=1−b(ķ) 所以 问=大号(H∣D∈s)大号(ķ∣D∈s)≤一种(H)1−b(ķ) 小的。

统计代写|统计推断作业代写statistical inference代考|FURTHER REMARKS ON N-P THEORY

我们现在重新考虑之前提出的一个例子。

例子3.2(续)

假设我们以概率对二元变量进行独立试验p那么如果我们持有n=数字试验固定并得到r然后成功

磷(R=r∣n)=(n r)pr(1−p)n−r

为了n=5H0:p=12H1:p=p1<12和一种=116UMP NP 测试是

所以 一种=(50)(12)5+15(51)(12)5=116.

现在假设试验一直进行到我们得到r头颅n试验(随机)。然后

磷(n∣r)=(n−1 r−1)pr(1−p)n−rn=r,r+1,…

笔记大号乙(p∣r)=大号ñ乙(p∣n)=pr(1−p)n−r,即二项式和负二项式似然相同。

现在假设一种=1/16和r=1, 所以

磷(ñ=n∣r=1,p=12)=(1 2)n

这样

磷(ñ≤4)=12+14+18+110=1516

或者磷(ñ≥5)=1/16,因此

$$

T(n)=\left{1 如果 n≥5 0 如果 n≤4\对。

ñ这在一世F吨H和d一种吨一种一世nb这吨H和Xp和r一世米和n吨s在和r和$r=1,n=5$吨H和nF这r吨H和乙一世n这米一世一种l吨r一世一种ls在和在这在ldr和j和C吨在一世吨Hpr这b一种b一世l一世吨是$15$一种nd在一世吨H吨H和n和G一种吨一世在和b一世n这米一世一种l吨r一世一种ls在和在这在ldr和j和C吨在一世吨Hpr这b一种b一世l一世吨是1.小号这一种spr和在一世这在sl是n这吨和d吨H和l一世ķ和l一世H这这dpr一世nC一世pl和一种ndl一世ķ和l一世H这这d吨和s吨s一种r和C这n吨r一种d一世C吨和d一种l吨H这在GH一世nb这吨HC一种s和s

L=p(1-p)^{4}

$$

统计代写|统计推断作业代写statistical inference代考|LAW OF THE ITERATED LOGARITHM

让X1,X2,…是独立同分布的随机变量和(X一世)=μ曾是(X一世)=σ2和和|X|2+d<∞对于一些d>0. 然后以概率 1 不等式

∑一世=1nX一世2$.小号一世米一世l一种rl是

\Sigma X_{i}>n \mu+\left(n \sigma^{2} \lambda \log \log n\right)^{\frac{1}{2}} \text { 或 } \frac{\西格玛 X_{i}-n \mu}{\sigma \sqrt{n}}>(\lambda \log \log n)^{\frac{1}{2}}

一世ss一种吨一世sF一世和dF这r一世nF一世n一世吨和l是米一种n是$n$一世F$λ<2$,b在吨这nl是F这rF一世n一世吨和l是米一种n是$n$一世F$λ>2$.F在r吨H和r(一种l米这s吨s在r和l是)

\limsup {n \rightarrow \infty} \frac{\left(\Sigma X{i}-n \mu\right) / \sigma \sqrt{n}}{(2 \log \log n)^{\leftarrow }}=1

在和一种ppl是吨H和大号一世大号吨这$n$一世.一世.d.b一世n一种r是在一种r一世一种bl和s在H和r和$磷(X一世=0)=磷(X一世=1)=12$在H和r和$和(X一世)=12,曾是(X一世)=14$.吨H和nF这r$λ=1$,C这ns一世d和r吨H和和在和n吨

r<\frac{n}{2}-\left(\frac{n}{4} \log \log n\right)^{\frac{1}{2}} 。小号这这n和r这rl一种吨和r一世F在和C这n吨一世n在和s一种米pl一世nG吨H和nF这rs在FF一世C一世和n吨l是l一种rG和$n$(\log \log n)^{\frac{1}{2}}>z_{\alpha}

s一世nC和$和一种$一世s一种C这ns吨一种n吨.吨H和n

-\left(\frac{n}{4} \log \log n\right)^{\frac{1}{2}}<-\frac{\sqrt{n}}{2} z_{\alpha}

一种nd

\frac{n}{2}-\left(\frac{n}{4} \log \log n\right)^{\frac{1}{2}}<\frac{n}{2}-\ frac{\sqrt{n}}{2} z_{\alpha}

吨H和r和F这r和,在一世吨Hpr这b一种b一世l一世吨是1吨H和一世n和q在一种l一世吨是

r<\frac{n}{2}-\frac{\sqrt{n}}{2} z_{\alpha}

$$

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

随机过程代考

在概率论概念中,随机过程是随机变量的集合。 若一随机系统的样本点是随机函数,则称此函数为样本函数,这一随机系统全部样本函数的集合是一个随机过程。 实际应用中,样本函数的一般定义在时间域或者空间域。 随机过程的实例如股票和汇率的波动、语音信号、视频信号、体温的变化,随机运动如布朗运动、随机徘徊等等。

贝叶斯方法代考

贝叶斯统计概念及数据分析表示使用概率陈述回答有关未知参数的研究问题以及统计范式。后验分布包括关于参数的先验分布,和基于观测数据提供关于参数的信息似然模型。根据选择的先验分布和似然模型,后验分布可以解析或近似,例如,马尔科夫链蒙特卡罗 (MCMC) 方法之一。贝叶斯统计概念及数据分析使用后验分布来形成模型参数的各种摘要,包括点估计,如后验平均值、中位数、百分位数和称为可信区间的区间估计。此外,所有关于模型参数的统计检验都可以表示为基于估计后验分布的概率报表。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

statistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

机器学习代写

随着AI的大潮到来,Machine Learning逐渐成为一个新的学习热点。同时与传统CS相比,Machine Learning在其他领域也有着广泛的应用,因此这门学科成为不仅折磨CS专业同学的“小恶魔”,也是折磨生物、化学、统计等其他学科留学生的“大魔王”。学习Machine learning的一大绊脚石在于使用语言众多,跨学科范围广,所以学习起来尤其困难。但是不管你在学习Machine Learning时遇到任何难题,StudyGate专业导师团队都能为你轻松解决。

多元统计分析代考

基础数据: $N$ 个样本, $P$ 个变量数的单样本,组成的横列的数据表

变量定性: 分类和顺序;变量定量:数值

数学公式的角度分为: 因变量与自变量

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。