如果你也在 怎样代写主成分分析PCA这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

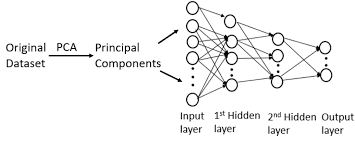

主成分分析(PCA)是计算主成分并使用它们对数据进行基础改变的过程,有时只使用前几个主成分,而忽略其余部分。

statistics-lab™ 为您的留学生涯保驾护航 在代写主成分分析PCA方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写主成分分析PCA代写方面经验极为丰富,各种代写主成分分析PCA相关的作业也就用不着说。

我们提供的主成分分析PCA及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

机器学习代写|主成分分析作业代写PCA代考|Extension or Generalization of PCA

It can be found that the above-mentioned algorithms only focused on eigenvector extraction or eigen-subspace tracking with noncoupled rules. However, a serious speed stability problem exists in the most noncoupled rules [28]. This problem is that in noncoupled PCA rules the eigen motion in all directions mainly depends on the principal eigenvalue of the covariance matrix; thus, numerical stability and fast convergence can only be achieved by guessing this eigenvalue in advance [28]; in noncoupled MCA rules the speed of convergence does not only depend on the minor eigenvalue, but also depend on all other eigenvalues of the covariance matrix, and if these extend over a large interval, no suitable learning rate may be found for a numerical solution that can still guarantee stability and ensure a sufficient speed of convergence in all eigen directions. Therefore, the problem is even more severe for MCA rules. To solve this common problem, Moller proposed some coupled PCA algorithms and some coupled MCA algorithms based on a special information criteria [28]. In coupled rules, the eigen pair (eigenvector and eigenvalue) is simultaneously estimated in coupled equations, and the speed of convergence only depends on the eigenvalue of its Jacobian. Thus, the dependence of the eigenvalues on the covariance matrix can be eliminated [28]. Recently, some modified coupled rules have been proposed [48].

It is well known that the generalized eigen decomposition (GED) plays very important roles in various signal processing applications, e.g., data compression, feature extraction, denoising, antenna array processing, and classification. Though PCA, which is the special case of GED problem, has been widely studied, the adaptive algorithms for the GED problem are scarce. Fortunately, a few efficient online adaptive algorithms for the GED problem that can be applied in real-time applications have been proposed [49-54]. In [49], Chaterjee et al. present new adaptive algorithms to extract the generalized eigenvectors from two sequences of random vectors or matrices. Most algorithms in literatures including [49] are gradient-based algorithms $[50,51]$. The main problem of this type of algorithms is slow convergence and the difficulty in selecting an appropriate step size which is essential: A too small value will lead to slow convergence and a too large value will lead to overshooting and instability. Rao et al. [51] have developed a fast recursive least squares (RLS)-like, not true RLS, sequential algorithm for GED. In [54], by reinterpreting the GED problem as an unconstrained minimization problem via constructing a novel cost function and applying projection approximation method and RLS technology to the cost function, RLS-based parallel adaptive algorithms for generalized eigen decomposition was proposed. In [55], a power method-based algorithm for tracking generalized eigenvectors was developed when stochastic signals having unknown correlation matrices are observed. Attallah proposed a new adaptive algorithm for the generalized symmetric eigenvalue problem, which can extract the principal and minor generalized eigenvectors, as well as their corresponding subspaces, at a low computational cost [56]. Recently, a fast and

numerically stable adaptive algorithm for the generalized Hermitian eigenvalue problem (GHEP) was proposed and analyzed in [48].

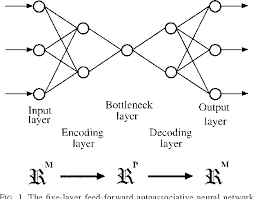

Other extensions of PCA also include dual-purpose algorithm [57-64], the details of which can be found in Chap. 5 , and adaptive or neural networks-based SVD singular vector tracking $[6,65-70]$, the details of which can be found in Chap. $9 .$

机器学习代写|主成分分析作业代写PCA代考|Concept of Subspace

Definition 1 If $\boldsymbol{S}=\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}$ is the vector subset of vector space $\boldsymbol{V}$, then the set $\boldsymbol{W}$ of all linear combinations of $\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}$ is called the subspace spanned by $\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{\boldsymbol{m}}$, namely $$ \boldsymbol{W}=\operatorname{Span}\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}=\left{\boldsymbol{u}: \boldsymbol{u}=\alpha_{1} \boldsymbol{u}{1}+\alpha{2} \boldsymbol{u}{2}+\cdots+\alpha{m} \boldsymbol{u}{m}\right} $$ where each vector in $\boldsymbol{W}$ is called the generator of $\boldsymbol{W}$, and the set $\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}$ which is composed of all the generators is called the spanning set of the subspace. A vector subspace which only comprises zero vector is called a trivial subspace. If the vector set $\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}_{m}\right}$ is linearly irrespective, then it is called a group basis of $W$.

Definition 2 The number of vectors in any group basis of subspace $W$ is called the dimension of $W$, which is denoted by $\operatorname{dim}(W)$. If any group basis of $W$ is not composed of finite linearly irrespective vectors, then $W$ is called an infinite-dimensional vector subspace.

Definition 3 Assume that $\boldsymbol{A}=\left[a_{1}, a_{2}, \ldots, a_{n}\right] \in \boldsymbol{C}^{\mathrm{m} \times n}$ is a complex matrix and all the linear combinations of its column vectors constitute a subspace, which is called column space of matrix $A$ and is denoted by $\operatorname{Col}(\boldsymbol{A})$, namely

$$

\operatorname{Col}(A)=\operatorname{Span}\left{a_{1}, a_{2}, \ldots, a_{n}\right}=\left{\boldsymbol{y} \in \boldsymbol{C}^{m}: \boldsymbol{y}=\sum_{j=1}^{n} \alpha_{j} a_{j}: \alpha_{j} \in \boldsymbol{C}\right}

$$

Row space of matrix $A$ can be defined similarly.

机器学习代写|主成分分析作业代写PCA代考|Subspace Tracking Method

The iterative computation of an extreme (maximal or minimum) eigen pair (eigenvalue and eigenvector) can date back to 1966 [72]. In 1980, Thompson proposed a LMS-type adaptive algorithm for estimating eigenvector, which correspond to the smallest eigenvalue of sample covariance matrix, and provided the adaptive tracking algorithm of the angle/frequency combing with Pisarenko’s harmonic estimator [14]. Sarkar et al. [73] used the conjugate gradient algorithm to track the variation of the extreme eigenvector which corresponds to the smallest eigenvalue of the covariance matrix of the slowly changing signal and proved its much faster convergence than Thompson’s LMS-type algorithm. These methods were only used to track single extreme value and eigenvector with limited application, but later they were extended for the eigen-subspace tracking and updating methods. In 1990, Comon and Golub [6] proposed the Lanczos method for tracking the extreme singular value and singular vector, which is a common method designed originally for determining some big and sparse symmetrical eigen problem $A x=\lambda x[74]$.

The earliest eigenvalue and eigenvector updating method was proposed by Golub in 1973 [75]. Later, Golub’s updating idea was extended by Bunch et al. [76, 77 , the basic idea of which is to update the eigenvalue decomposition of the covariance matrix after every rank-one modification, and then go to the matrix’s latent root using the interlacing theorem, and then update the place of the latent root using the iterative resolving root method. Thus, the eigenvector can be updated. Later, Schereiber [78] introduced a transform to change a majority of complex number arithmetic operation into real-number operation and made use of Karasalo’s subspace mean method [79] to further reduce the operation quantity. DeGroat and

Roberts [80] developed a numerically stabilized rank-one eigen structure updating method based on mutual Gram-Schmidt orthogonalization. Yu [81] extended the rank-one eigen structure update to block update and proposed recursive update of the eigenvalue decomposition of a covariance matrix.

The earliest adaptive signal subspace tracking method was proposed by Owsley [7] in 1978. Using the stochastic gradient method, Yang and Kaveh [18] proposed a LMS-type subspace tracking algorithm and extended Owsley’s method and Thompson’s method. This LMS-type algorithm has a high parallel structure and low computational complexity. Karhumen [17] extended Owsley’s idea by developing a stochastic approaching method based on computing subspace. Like Yang and Kaveh’s extension of Thompson’s idea to develop an LMS-type subspace tracking algorithm, Fu and Dowling [45] extended Sarkar’s idea to develop a subspace tracking algorithm based on conjugate gradient. During the recent 20 years, eigen-subspace tracking and update has been an active research field. Since eigen-subspace tracking is mainly applied to real signal processing, these methods should be fast algorithms.

主成分分析代写

机器学习代写|主成分分析作业代写PCA代考|Extension or Generalization of PCA

可以发现,上述算法只关注特征向量提取或非耦合规则的特征子空间跟踪。然而,在大多数非耦合规则中存在严重的速度稳定性问题[28]。这个问题是在非耦合PCA规则中,各个方向的特征运动主要取决于协方差矩阵的主特征值;因此,数值稳定性和快速收敛只能通过提前猜测这个特征值来实现[28];在非耦合 MCA 规则中,收敛速度不仅取决于次要特征值,还取决于协方差矩阵的所有其他特征值,如果这些特征值延伸到很大的区间,对于仍然可以保证稳定性并确保在所有特征方向上具有足够的收敛速度的数值解,可能找不到合适的学习率。因此,对于 MCA 规则来说,问题更加严重。为了解决这个常见问题,Moller 提出了一些耦合 PCA 算法和一些基于特殊信息准则的耦合 MCA 算法[28]。在耦合规则中,特征对(特征向量和特征值)是在耦合方程中同时估计的,收敛速度只取决于其雅可比行列式的特征值。因此,可以消除特征值对协方差矩阵的依赖性[28]。最近,已经提出了一些修改后的耦合规则[48]。Moller 提出了一些基于特殊信息标准的耦合 PCA 算法和一些耦合 MCA 算法[28]。在耦合规则中,特征对(特征向量和特征值)是在耦合方程中同时估计的,收敛速度只取决于其雅可比行列式的特征值。因此,可以消除特征值对协方差矩阵的依赖性[28]。最近,已经提出了一些修改后的耦合规则[48]。Moller 提出了一些基于特殊信息标准的耦合 PCA 算法和一些耦合 MCA 算法[28]。在耦合规则中,特征对(特征向量和特征值)在耦合方程中同时估计,收敛速度只取决于其雅可比行列式的特征值。因此,可以消除特征值对协方差矩阵的依赖性[28]。最近,已经提出了一些修改后的耦合规则[48]。

众所周知,广义特征分解(GED)在各种信号处理应用中起着非常重要的作用,例如数据压缩、特征提取、去噪、天线阵列处理和分类。虽然作为 GED 问题的特例 PCA 已被广泛研究,但 GED 问题的自适应算法却很少。幸运的是,已经提出了一些可以在实时应用中应用的 GED 问题的有效在线自适应算法 [49-54]。在 [49] 中,Chaterjee 等人。提出新的自适应算法来从两个随机向量或矩阵序列中提取广义特征向量。包括[49]在内的文献中的大多数算法都是基于梯度的算法[50,51]. 这类算法的主要问题是收敛速度慢,难以选择合适的步长,这是必不可少的:值太小会导致收敛慢,值太大会导致超调和不稳定。饶等人。[51] 为 GED 开发了一种类似于快速递归最小二乘 (RLS),而不是真正的 RLS,顺序算法。在[54]中,通过构造新的成本函数并将投影逼近方法和RLS技术重新解释为无约束最小化问题,提出了基于RLS的广义特征分解并行自适应算法。在[55]中,当观察到具有未知相关矩阵的随机信号时,开发了一种基于幂法的跟踪广义特征向量的算法。Attallah 为广义对称特征值问题提出了一种新的自适应算法,该算法可以以较低的计算成本提取主要和次要广义特征向量及其对应的子空间[56]。最近,一个快速而

在[48]中提出并分析了广义厄米特特征值问题(GHEP)的数值稳定自适应算法。

PCA 的其他扩展还包括双用途算法 [57-64],其详细信息可在第 1 章中找到。5、自适应或基于神经网络的SVD奇异向量跟踪[6,65−70],其详细信息可以在第 1 章中找到。9.

机器学习代写|主成分分析作业代写PCA代考|Concept of Subspace

定义 1 如果\boldsymbol{S}=\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}\boldsymbol{S}=\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}是向量空间的向量子集在,那么集合在的所有线性组合在1,在2,…,在米被称为跨越的子空间在1,在2,…,在米,即\boldsymbol{W}=\operatorname{Span}\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}=\left{ \boldsymbol{u}: \boldsymbol{u}=\alpha_{1} \boldsymbol{u}{1}+\alpha{2} \boldsymbol{u}{2}+\cdots+\alpha{m} \boldsymbol{ u}{m}\右}\boldsymbol{W}=\operatorname{Span}\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}=\left{ \boldsymbol{u}: \boldsymbol{u}=\alpha_{1} \boldsymbol{u}{1}+\alpha{2} \boldsymbol{u}{2}+\cdots+\alpha{m} \boldsymbol{ u}{m}\右}其中每个向量在在被称为生成器在, 和集合\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}{m}\right}由所有生成元组成的称为子空间的生成集。仅包含零向量的向量子空间称为平凡子空间。如果向量集\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}_{m}\right}\left{\boldsymbol{u}{1}, \boldsymbol{u}{2}, \ldots, \boldsymbol{u}_{m}\right}是线性无关的,则称为群基在.

定义 2 子空间任意群基中的向量个数在被称为维度在,表示为暗淡(在). 如果任何组基础在不是由有限的线性无关向量组成,则在称为无限维向量子空间。

定义 3 假设一种=[一种1,一种2,…,一种n]∈C米×n是一个复矩阵,其列向量的所有线性组合构成一个子空间,称为矩阵的列空间一种并表示为科尔(一种),即

\operatorname{Col}(A)=\operatorname{Span}\left{a_{1}, a_{2}, \ldots, a_{n}\right}=\left{\boldsymbol{y} \in \boldsymbol {C}^{m}: \boldsymbol{y}=\sum_{j=1}^{n} \alpha_{j} a_{j}: \alpha_{j} \in \boldsymbol{C}\right}\operatorname{Col}(A)=\operatorname{Span}\left{a_{1}, a_{2}, \ldots, a_{n}\right}=\left{\boldsymbol{y} \in \boldsymbol {C}^{m}: \boldsymbol{y}=\sum_{j=1}^{n} \alpha_{j} a_{j}: \alpha_{j} \in \boldsymbol{C}\right}

矩阵的行空间一种可以类似定义。

机器学习代写|主成分分析作业代写PCA代考|Subspace Tracking Method

一个极端(最大或最小)特征对(特征值和特征向量)的迭代计算可以追溯到 1966 年 [72]。1980 年,Thompson 提出了一种 LMS 型自适应算法来估计特征向量,它对应于样本协方差矩阵的最小特征值,并结合 Pisarenko 的谐波估计器提供了角度/频率的自适应跟踪算法[14]。萨卡尔等人。[73] 使用共轭梯度算法跟踪慢变信号协方差矩阵的最小特征值对应的极值特征向量的变化,证明其收敛速度比 Thompson 的 LMS 型算法快得多。这些方法仅用于跟踪单个极值和特征向量,应用有限,但后来它们被扩展为特征子空间跟踪和更新方法。1990 年,Comon 和 Golub [6] 提出了跟踪极值奇异值和奇异向量的 Lanczos 方法,该方法最初是为确定一些大而稀疏的对称特征问题而设计的常用方法一种X=λX[74].

最早的特征值和特征向量更新方法是由 Golub 在 1973 年提出的[75]。后来,Bunch 等人对 Golub 的更新思想进行了扩展。[76, 77 , 其基本思想是对协方差矩阵的特征值分解在每次秩一修正后更新,然后利用交错定理去矩阵的潜在根,然后利用交错定理更新潜在根的位置迭代求解根法。因此,可以更新特征向量。后来,Schereiber [78] 引入了一种变换,将大多数复数算术运算变为实数运算,并利用 Karasalo 的子空间均值法 [79] 进一步减少了运算量。DeGroat 和

Roberts [80] 开发了一种基于互 Gram-Schmidt 正交化的数值稳定秩一特征结构更新方法。Yu [81]将秩一特征结构更新扩展到块更新,并提出了协方差矩阵的特征值分解的递归更新。

最早的自适应信号子空间跟踪方法是由 Owsley [7] 在 1978 年提出的。利用随机梯度法,Yang 和 Kaveh [18] 提出了 LMS 型子空间跟踪算法,并扩展了 Owsley 方法和 Thompson 方法。这种LMS类型的算法具有高并行结构和低计算复杂度。Karhumen [17] 通过开发一种基于计算子空间的随机逼近方法扩展了 Owsley 的想法。就像 Yang 和 Kaveh 扩展 Thompson 的想法以开发 LMS 型子空间跟踪算法一样,Fu 和 Dowling [45] 扩展了 Sarkar 的想法以开发基于共轭梯度的子空间跟踪算法。近 20 年来,特征子空间跟踪和更新一直是一个活跃的研究领域。由于本征子空间跟踪主要应用于真实信号处理,

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。