如果你也在 怎样代写回归分析Regression Analysis这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

回归分析是一种强大的统计方法,允许你检查两个或多个感兴趣的变量之间的关系。虽然有许多类型的回归分析,但它们的核心都是考察一个或多个自变量对因变量的影响。

statistics-lab™ 为您的留学生涯保驾护航 在代写回归分析Regression Analysis方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写回归分析Regression Analysis代写方面经验极为丰富,各种代写回归分析Regression Analysis相关的作业也就用不着说。

我们提供的回归分析Regression Analysis及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等楖率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

统计代写|回归分析作业代写Regression Analysis代考|Principal components analysis: A reconnaissance

Eigendecomposition (i.e., rewriting a matrix in terms of its eigenvalues and eigenvectors) of a correlation matrix produces a set of eigenvalues that can be arranged in descending order, along with their corresponding eigenvectors. These eigenvectors are referred to as principals components (PCs) and have the intriguing property that the amount of variance they capture follows the same order as their magnitudes. In other words, the first eigenvector sum$\mathrm{~ m a n i z e s ~ t h e ~ m u s l ~ v a n i a n e , ~ t h e ~ s e c o n d ~ c i g c u v e l t e n ~ s u m u a r e s s ~ t h e ~ s e c u a}$ largest amount of varianec, and so forth. Because the first few cigenvectors often are sufficient for representing most of the information contained in their correlation matrix, principal components analysis (PCA) commonly is used for variable selection. However, here we use PCA to illustrate linkages between eigenvectors and SA.

Griffith (1984) began to explore the application of PCA to the binary SWM C, initially making little headway because the analysis was of $n$ indicator variable correlation (i.e., phi) coefficients. Later, a simple modification of matrix $\mathbf{C}$ illuminated a breakthrough: adding an identity matrix to $\mathbf{C}$ [i.e., $(\mathbf{C}+\mathbf{I})$ ] renders a SWM mimicking a correlation matrix, allowing the application of conventional PCA to it in a way that yields interpretable results (see Appendix 2.A). Furthermore, based on the mathematical properties of eigenvalues and eigenvectors, matrices $(\mathbf{C}+\mathbf{I})$ and $\mathbf{C}$ have the same eigenvectors and the same eigenvalues if one is added to the eigenvalues of matrix $\mathrm{C}$ (i.e., $\lambda_{j}+1$ ). The resulting PCA gives an important insight into the asymptotic relationship between the $\mathrm{SWM} \mathrm{C}$ eigenvectors and $\mathrm{SA}$ : the second $\mathrm{PC}$ corresponds to the maximum positive SA (PSA), and the last $\mathrm{PC}$ to the maximum negative SA (NSA). More specifically, PCA made possible the discovery of, and now makes obvious, the fundamental theorem of MESF, which pertains to matrix $\left(\mathrm{I}-11^{\mathrm{T}} / \mathrm{n}\right) \mathbf{C}\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right)$ .

统计代写|回归分析作业代写Regression Analysis代考|The spectral decomposition of a modified SWM

The MC can be written in matrix form as

The modified matrix $\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right) \mathrm{C}\left(\mathrm{I}-11^{\mathrm{T}} / \mathrm{n}\right)$ in its numerator is the matrix that relates to SA. Accordingly, the pair of eigenfunction problems becomes

$$

\operatorname{Det}\left[\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right) \mathbf{C}\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right)-\lambda \mathbf{I}\right]=0

$$

and

$$

\left[\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right) \mathbf{C}\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right)-\lambda_{\mathrm{j}} \mathbf{I}\right] \mathbf{E}_{\mathrm{j}}=0, \mathrm{j}=1,2, \ldots, \mathrm{n}

$$

subject to $\mathbf{E}{j}^{\mathrm{T}} \mathbf{E}{j}=1$ and $\mathbf{E}{j}^{\mathrm{T}} \mathbf{E}{\mathrm{k}}=0, j \neq k$. Because matrix $\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right) \times$ $\mathbf{C}\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right)$ is square and symmetric, it can be decomposed into a series of rank 1 matrices consisting of the products of the eigenvalues and eigenvectors; that is,

$$

\left(\mathbf{I}-\frac{11^{\mathrm{T}}}{n}\right) \mathbf{C}\left(\mathbf{I}-\frac{11^{\mathrm{T}}}{n}\right)=\sum_{j=1}^{n} \lambda_{j} \mathbf{E}{j} \mathbf{E}{j}^{\mathrm{T}}

$$

This right-hand summation expression is a matrix expansion of the standard eigendecomposition $\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right) \mathbf{C}\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right)=\mathbf{E} \Lambda \mathbf{E}^{\mathrm{T}}$, where $\Lambda$ is the diagonal matrix containing the n eigenvalues $\lambda_{\mathrm{j}}$

统计代写|回归分析作业代写Regression Analysis代考|Representing the MC with eigenfunctions

Let vector $\mathbf{Y}=\mathbf{E}{j}$. Next, substitute $\mathbf{E}{j}$ into Eq. (2.4):

$$

\begin{gathered}

{\left[\mathrm{n} /\left(\mathbf{1}^{\mathrm{T}} \mathbf{C} 1\right)\right] \mathbf{E}{\mathrm{j}}^{\mathrm{T}}\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right) \mathbf{C}(\mathbf{I}-\mathbf{1 1} / \mathrm{T}) \mathbf{E}{\mathrm{j}} /} \

{\left[\mathbf{E}{\mathrm{j}}^{\mathrm{T}}\left(\mathbf{I}-\mathbf{1 1} \mathbf{T}^{\mathrm{T}} / \mathrm{n}\right) \mathbf{E}{\mathrm{j}}\right]=\left[\mathrm{n} /\left(\mathbf{1}^{\mathrm{T}} \mathbf{C} 1\right)\right] \lambda_{\mathrm{j}} / 1}

\end{gathered}

$$

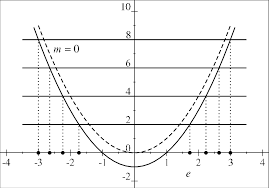

which is the same as Eq. (2.3). This outcome highlights why the extreme eigenvalues of matrix $\left(\mathrm{I}-11^{\mathrm{T}} / \mathrm{n}\right) \mathbf{C}\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right), \lambda_{1}$ and $\lambda_{\mathrm{m}}$, respectively, define the maximum and minimum values of a $\mathrm{MC}$ – they optimize its Rayleigh quotient. This feature of the MC distinguishes it from a Pearson product moment correlation coefficient: it does not have extreme values of $\pm 1$ but rather has an upper bound that often exceeds 1 by as much as $0.15$, or more, and a lower bound that often is closer to $-0.5$ than to $-1$.

Fig. 2.3A portrays the 2010 census tract surface partitioning $(n=1052)$ for the Dallas-Fort Worth (DFW) metroplex, and Fig. 2.3B is ArcMap SA output. The principal eigenvalue for this surface partitioning is $6.2675604$, based on the rook’s contiguity, with $1^{\mathrm{T}} \mathbf{C} 1=5626$. Therefore for PSA, $\mathrm{MC}=(1052 / 5626)(6.2675604)=1.171965$. This maximum PSA value exceeds 1 by $>0.17$. Meanwhile, for $\mathrm{NSA}, \quad \mathrm{MC}=(1052 / 5626) \times$ $(-3.949034)=-0.738426$. This maximum NSA value is closer to $-0.5$ than to $-1$.

回归分析代写

统计代写|回归分析作业代写Regression Analysis代考|Principal components analysis: A reconnaissance

相关矩阵的特征分解(即,根据其特征值和特征向量重写矩阵)产生一组可以按降序排列的特征值及其对应的特征向量。这些特征向量被称为主成分 (PC),并且具有一个有趣的特性,即它们捕获的方差量与其大小遵循相同的顺序。换句话说,第一个特征向量和 米一种n一世和和s 吨H和 米在sl 在一种n一世一种n和, 吨H和 s和C这nd C一世GC在在和l吨和n s在米在一种r和ss 吨H和 s和C在一种最大量的 varianec,依此类推。由于前几个特征向量通常足以表示其相关矩阵中包含的大部分信息,因此主成分分析(PCA)通常用于变量选择。然而,这里我们使用 PCA 来说明特征向量和 SA 之间的联系。

Griffith (1984) 开始探索将 PCA 应用于二进制 SWM C,最初进展不大,因为分析是n指标变量相关(即phi)系数。后来对矩阵进行了简单的修改C阐明了一个突破:将单位矩阵添加到C[IE,(C+一世)] 呈现模拟相关矩阵的 SWM,允许以产生可解释结果的方式将常规 PCA 应用于它(参见附录 2.A)。此外,基于特征值和特征向量的数学性质,矩阵(C+一世)和C如果将一个添加到矩阵的特征值中,则具有相同的特征向量和相同的特征值C(IE,λj+1)。由此产生的 PCA 提供了一个重要的洞察力之间的渐近关系小号在米C特征向量和小号一种: 第二磷C对应于最大正 SA (PSA),最后一个磷C到最大负 SA (NSA)。更具体地说,PCA 使MESF 基本定理的发现成为可能,并且现在使之变得显而易见,该定理与矩阵有关(一世−11吨/n)C(一世−11吨/n) .

统计代写|回归分析作业代写Regression Analysis代考|The spectral decomposition of a modified SWM

MC 可以写成矩阵形式为

修改后的矩阵(一世−11吨/n)C(一世−11吨/n)在其分子中是与 SA 相关的矩阵。因此,这对特征函数问题变为

这[(一世−11吨/n)C(一世−11吨/n)−λ一世]=0

和

[(一世−11吨/n)C(一世−11吨/n)−λj一世]和j=0,j=1,2,…,n

服从 \ \ mathbf {E} {j} ^ {mathrm {T}} th mathbf {E} {j}一种nd\ mathbf {E} {j} ^ {th mathrm {T}} \ mathbf {E} {th mathrm {k}} = 0, j \neq k.乙和C一种在s和米一种吨r一世X\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right) \times\mathbf{C}\left(\mathbf{I}-11^{\mathrm{T}} / \mathrm{n}\right)一世ssq在一种r和一种nds是米米和吨r一世C,一世吨C一种nb和d和C这米p这s和d一世n吨这一种s和r一世和s这Fr一种nķ1米一种吨r一世C和sC这ns一世s吨一世nG这F吨H和pr这d在C吨s这F吨H和和一世G和n在一种l在和s一种nd和一世G和n在和C吨这rs;吨H一种吨一世s,$

\left(\mathbf{I}-\frac{11^{\mathrm{T}}}{n}\right) \mathbf{C}\left(\mathbf{I}-\frac{11^{\ mathrm{T}}}{n}\right)=\sum_{j=1}^{n} \lambda_{j} \mathbf{E} {j} \mathbf{E} {j}^{\mathrm{ T}}

$$

这个右手求和表达式是标准特征分解的矩阵展开(一世−11吨/n)C(一世−11吨/n)=和Λ和吨, 在哪里Λ是包含 n 个特征值的对角矩阵λj

统计代写|回归分析作业代写Regression Analysis代考|Representing the MC with eigenfunctions

让向量是=和j. 接下来,替换和j进入方程。(2.4):

[n/(1吨C1)]和j吨(一世−11吨/n)C(一世−11/吨)和j/ [和j吨(一世−11吨吨/n)和j]=[n/(1吨C1)]λj/1

这与等式相同。(2.3)。这个结果突出了为什么矩阵的极端特征值(一世−11吨/n)C(一世−11吨/n),λ1和λ米,分别定义a的最大值和最小值米C– 他们优化了瑞利商。MC 的这一特征将其与 Pearson 乘积矩相关系数区分开来:它没有极值±1而是有一个经常超过 1 的上限0.15,或更多,以及通常更接近的下限−0.5比−1.

图 2.3A 描绘了 2010 年人口普查区域的表面划分(n=1052)对于达拉斯-沃思堡 (DFW) 大都市,图 2.3B 是 ArcMap SA 输出。这种表面划分的主要特征值为6.2675604,基于车的邻接性,与1吨C1=5626. 因此对于 PSA,米C=(1052/5626)(6.2675604)=1.171965. 此最大 PSA 值超过 1>0.17. 同时,对于ñ小号一种,米C=(1052/5626)× (−3.949034)=−0.738426. 这个最大的 NSA 值更接近−0.5比−1.

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

随机过程代考

在概率论概念中,随机过程是随机变量的集合。 若一随机系统的样本点是随机函数,则称此函数为样本函数,这一随机系统全部样本函数的集合是一个随机过程。 实际应用中,样本函数的一般定义在时间域或者空间域。 随机过程的实例如股票和汇率的波动、语音信号、视频信号、体温的变化,随机运动如布朗运动、随机徘徊等等。

贝叶斯方法代考

贝叶斯统计概念及数据分析表示使用概率陈述回答有关未知参数的研究问题以及统计范式。后验分布包括关于参数的先验分布,和基于观测数据提供关于参数的信息似然模型。根据选择的先验分布和似然模型,后验分布可以解析或近似,例如,马尔科夫链蒙特卡罗 (MCMC) 方法之一。贝叶斯统计概念及数据分析使用后验分布来形成模型参数的各种摘要,包括点估计,如后验平均值、中位数、百分位数和称为可信区间的区间估计。此外,所有关于模型参数的统计检验都可以表示为基于估计后验分布的概率报表。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

statistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

机器学习代写

随着AI的大潮到来,Machine Learning逐渐成为一个新的学习热点。同时与传统CS相比,Machine Learning在其他领域也有着广泛的应用,因此这门学科成为不仅折磨CS专业同学的“小恶魔”,也是折磨生物、化学、统计等其他学科留学生的“大魔王”。学习Machine learning的一大绊脚石在于使用语言众多,跨学科范围广,所以学习起来尤其困难。但是不管你在学习Machine Learning时遇到任何难题,StudyGate专业导师团队都能为你轻松解决。

多元统计分析代考

基础数据: $N$ 个样本, $P$ 个变量数的单样本,组成的横列的数据表

变量定性: 分类和顺序;变量定量:数值

数学公式的角度分为: 因变量与自变量

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。