如果你也在 怎样代写机器学习 machine learning这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

机器学习是一个致力于理解和建立 “学习 “方法的研究领域,也就是说,利用数据来提高某些任务的性能的方法。机器学习算法基于样本数据(称为训练数据)建立模型,以便在没有明确编程的情况下做出预测或决定。机器学习算法被广泛用于各种应用,如医学、电子邮件过滤、语音识别和计算机视觉,在这些应用中,开发传统算法来执行所需任务是困难的或不可行的。

statistics-lab™ 为您的留学生涯保驾护航 在代写机器学习 machine learning方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写机器学习 machine learning代写方面经验极为丰富,各种代写机器学习 machine learning相关的作业也就用不着说。

我们提供的机器学习 machine learning及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

计算机代写|机器学习代写machine learning代考|Explaining Kernel Methods with Random Matrix Theory

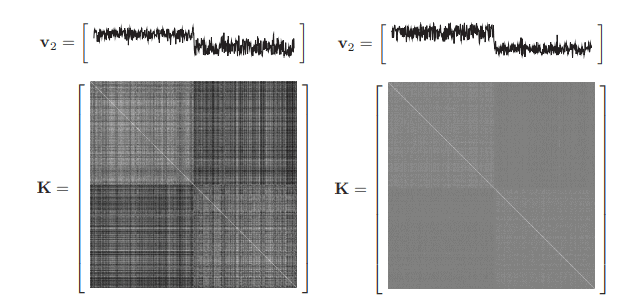

The fundamental reason behind this surprising behavior lies in the accumulated effect of the $n / 2$ small “hidden” informative terms $|\boldsymbol{\mu}|^2, \operatorname{tr} \mathbf{E}$ and $\operatorname{tr}\left(\mathbf{E}^2\right)$ in each class, which collectively “steer” the several top eigenvectors of $\mathbf{K}$. More explicitly, we shall see in the course of this book that the Gaussian kernel matrix $\mathbf{K}$ can be asymptotically expanded as

$$

\mathbf{K}=\exp (-1)\left(\mathbf{1}n \mathbf{1}_n^{\boldsymbol{\top}}+\frac{1}{p} \mathbf{Z}^{\boldsymbol{\top}} \mathbf{Z}\right)+f(\boldsymbol{\mu}, \mathbf{E}) \cdot \frac{1}{p} \mathbf{j} \mathbf{j}^{\boldsymbol{\top}}++o{|\cdot|}(1),

$$

where $\mathbf{Z}=\left[\mathbf{z}1, \ldots, \mathbf{z}_n\right] \in \mathbb{R}^{p \times n}$ is a Gaussian noise matrix, $f(\boldsymbol{\mu}, \mathbf{E})=O(1)$, and $\mathbf{j}=\left[\mathbf{1}{n / 2} ;-\mathbf{1}{n / 2}\right]$ is the class-information “label” vector (as in the setting of Figure 1.2). Here “” symbolizes extra terms of marginal importance to the present discussion, and $o{|\cdot|}(1)$ represents terms of asymptotically vanishing operator norm as $n, p \rightarrow \infty$. The important remark to be made here is that

(i) Under this description, $[\mathbf{K}]_{i j}=\exp (-1)\left(1+\mathbf{z}_i^{\top} \mathbf{z}_j / p\right) \pm f(\boldsymbol{\mu}, \mathbf{E}) / p+*$, with $f(\mu, \mathbf{E}) / p \ll \mathbf{z}_i^{\top} \mathbf{z}_j / p=O\left(p^{-1 / 2}\right)$; this is consistent with our previous discussion: The statistical information is entry-wise dominated by noise.

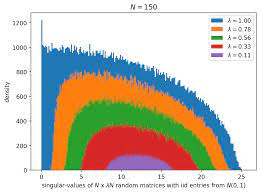

(ii) From a spectral viewpoint, $\left|\mathbf{Z}^{\top} \mathbf{Z} / p\right|=O$ (1), as per the Marčenko-Pastur theorem [Marčenko and Pastur, 1967] discussed in Section 1.1.2 and visually confirmed in Figure 1.1, while $|f(\boldsymbol{\mu}, \mathbf{E}) \cdot \mathbf{j} \mathbf{j} \mathrm{T} / p|=O(1)$ : Thus, spectrum-wise, the information stands on even ground with noise.

The mathematical magic at play here lies in $f(\boldsymbol{\mu}, \mathbf{E}) \cdot \mathbf{j} \mathbf{j} / / p$ having entries of order $O\left(p^{-1}\right)$ while being a low-rank (here unit-rank) matrix: All its “energy” concentrates in a single nonzero eigenvalue. As for $\mathbf{Z}^{\top} \mathbf{Z} / p$, with larger $O\left(p^{-1 / 2}\right)$ amplitude entries, it is composed of “essentially independent” zero-mean random variables and tends to be of full rank and spreads its energy over its $n$ eigenvalues. Spectrum-wise, both $f(\boldsymbol{\mu}, \mathbf{E}) \cdot \mathbf{j} \mathbf{j}{ }^{\top} / p$ and $\mathbf{Z}^{\top} \mathbf{Z} / p$ meet on even ground under the nontrivial classification setting of (1.7).

We shall see in Section 4 that things are actually not as clear-cut and, in particular, that not all choices of kernel functions can achieve the same nontrivial classification rates. In particular, the popular Gaussian (radial basis function [RBF]) kernel will be shown to be largely suboptimal in this respect.

计算机代写|机器学习代写machine learning代考|Random Matrix Theory as an Answer

Random matrix theory originates from the work of John Wishart [Wishart, 1928] on the study of the eigenvalues of the matrix $\mathbf{X} \mathbf{X}^{\top}$ (now referred to as a Wishart matrix) for $\mathbf{X} \in \mathbb{R}^{p \times n}$ with standard Gaussian entries $[\mathbf{X}]_{i j} \sim \mathcal{N}(0,1)$. Wishart managed to determine a closed-form expression for the joint eigenvalue distribution of $\mathbf{X X ^ { \top }}$ for every pair of $p, n$. Few progress however followed, as matrices with non-Gaussian entries are hardly amenable to similar analysis and, even if they were, the actual study of more elaborate functionals of $\mathbf{X X}^{\top}$ is at best cumbersome and often simply intractable.

The works of the physicist Eugene Wigner [Wigner, 1955] gave a new impulse to the theory. Interested in the eigenvalues of symmetric matrices $\mathbf{X} \in \mathbb{R}^{n \times n}$ with independent Bernoulli entries (particle spins in his application context), Wigner opted for an asymptotic analysis of the eigenvalue distribution, thereby initiating the important and much richer branch of large-dimensional random matrix theory. Despite this important inspiration, Wigner exploited standard asymptotic statistics tools (the method of moments) to prove that the discrete distribution of the eigenvalues of $\mathbf{X}$ has a continuous semicircle looking density in the $n \rightarrow \infty$ limit (the now popular semicircular law). This approach was particularly convenient as the limiting law is simple and could be visually anticipated (which is not the case of the next-to-come Marčenko-Pastur limiting distribution of Wishart matrices).

Only until 1967 with the tour-de-force of Marčenko and Pastur [1967] did random matrix theory take a new dimension. Marčenko and Pastur determined the limiting spectral distribution of the sample covariance matrix model $\mathbf{X} \mathbf{X}^{\top}$ of Wishart but under relaxed conditions: $[\mathbf{X}]{i j}$ are independent entries with zero mean and unit variance, and additional moment assumptions (all discarded in subsequent works). The independence (or weak dependence) property is key to their proof, which exploits the powerful Stieltjes transform $\frac{1}{p} \operatorname{tr}\left(\frac{1}{n} \mathbf{X} \mathbf{X}^{\top}-z \mathbf{I}_p\right)^{-1}=\int(\lambda-z)^{-1} \mu_p(d t)$ of the empirical spectral distribution $\mu_p \equiv \frac{1}{p} \sum{i=1}^p \delta_{\lambda_i\left(\frac{1}{n} \mathbf{X X}^{\top}\right)}$ of $\frac{1}{n} \mathbf{X} \mathbf{X}^{\top}$, a tool borrowed from operator theory in Hilbert spaces [Akhiezer and Glazman, 2013], rather than the moments $\frac{1}{p} \operatorname{tr}\left(\frac{1}{n} \mathbf{X X}^{\top}\right)^k$ (which may not converge since $\mathbb{E}\left[\mathbf{X}_{i j}^{\ell}\right]$ needs not be finite for $\ell>2$ ).

The technical approach devised by Marčenko and Pastur was then largely embraced at the turn of the twenty-first century by Bai and Silverstein who, in a series of significant breakthroughs (the most noticeable of which are [Silverstein and Bai, 1995, Bai and Silverstein, 1998]), extended the results in [Marčenko and Pastur, 1967] to an exhaustive study of sample covariance matrices.

机器学习代考

计算机代写|机器学习代写machine learning代考|Explaining Kernel Methods with Random Matrix Theory

这种令人惊讶的行为背后的根本原因在于 $n / 2$ 小的”隐藏”信息术语 $|\boldsymbol{\mu}|^2, \operatorname{tr} \mathbf{E}$ 和 $\operatorname{tr}\left(\mathbf{E}^2\right)$ 在每个类中,它 们共同“引导”了几个顶级特征向量 $\mathbf{K}$. 更明确地说,我们将在本书的课程中看到高斯核矩阵 $\mathbf{K}$ 可以渐近展 开为

$$

\mathbf{K}=\exp (-1)\left(\mathbf{1} n \mathbf{1}n^{\top}+\frac{1}{p} \mathbf{Z}^{\top} \mathbf{Z}\right)+f(\boldsymbol{\mu}, \mathbf{E}) \cdot \frac{1}{p} \mathbf{j j}^{\top}++o|\cdot|(1) $$ 在哪里 $\mathbf{Z}=\left[\mathbf{z} 1, \ldots, \mathbf{z}_n\right] \in \mathbb{R}^{p \times n}$ 是高斯㗍声矩阵, $f(\boldsymbol{\mu}, \mathbf{E})=O(1)$ ,和 $\mathbf{j}=[\mathbf{1} n / 2 ;-\mathbf{1 n} / 2]$ 是类 信息”标签”向量(如图 $1.2$ 的设置) 。这里 ${ }^{\prime \prime \prime}$ 表示对当前讨论不重要的额外术语,并且 $o|\cdot|(1)$ 将渐近消 失的算子范数的项表示为 $n, p \rightarrow \infty$. 这里要说明的重要一点是 (i) 根据这个描述, $[\mathbf{K}]{i j}=\exp (-1)\left(1+\mathbf{z}_i^{\top} \mathbf{z}_j / p\right) \pm f(\boldsymbol{\mu}, \mathbf{E}) / p+*$ , 和

$f(\mu, \mathbf{E}) / p \ll \mathbf{z}_i^{\top} \mathbf{z}_j / p=O\left(p^{-1 / 2}\right)$; 这与我们之前的讨论是一致的:统计信息在条目方面由噪声主 导。

(ii) 从光谱的角度来看, $\left|\mathbf{Z}^{\top} \mathbf{Z} / p\right|=O(1)$ ,根据 Marčenko-Pastur 定理 [Marčenko 和 Pastur,1967] 在第 1.1.2 节中讨论并在图 $1.1$ 中直观地确认,而 $|f(\boldsymbol{\mu}, \mathbf{E}) \cdot \mathbf{j j T} / p|=O(1)$ : 因此,在频谱方面,信 息与橾声持平。

这里发挥的数学魔力在于 $f(\boldsymbol{\mu}, \mathbf{E}) \cdot \mathbf{j} \mathbf{j} / / p$ 有订单条目 $O\left(p^{-1}\right)$ 作为一个低秩 (此处为单位秩) 矩阵: 它 的所有“能量”都集中在一个非零特征值中。至于 $\mathbf{Z}^{\top} \mathbf{Z} / p$ ,具有较大 $O\left(p^{-1 / 2}\right)$ 振幅条目,它由“本质上独 立的”零均值随机变量组成,并且倾向于满秩并将其能量分布在其上 $n$ 特征值。频谱方面,两者 $f(\boldsymbol{\mu}, \mathbf{E}) \cdot \mathbf{j} \mathbf{j}^{\top} / p$ 和 $\mathbf{Z}^{\top} \mathbf{Z} / p$ 在 (1.7) 的非平凡分类设置下,在平坦的地面上相遇。

我们将在第 4 节中看到,事情实际上并没有那么明确,特别是,并非所有核函数的选择都能达到相同的 非平凡分类率。特别是,流行的高斯(径向基函数 [RBF])内核在这方面将被证明在很大程度上是次优的。

计算机代写|机器学习代写machine learning代考|Random Matrix Theory as an Answer

随机矩阵理论起源于 John Wishart [Wishart, 1928] 对矩阵特征值研究的工作 $\mathbf{X X}^{\top}$ (现在称为 Wishart 矩阵) 对于 $\mathbf{X} \in \mathbb{R}^{p \times n}$ 具有标准高斯条目 $[\mathbf{X}]{i j} \sim \mathcal{N}(0,1)$. Wishart 设法确定了联合特征值分布的封闭 式表达式 $\mathbf{X X}^{\top}$ 对于每一对 $p, n$. 然而,几乎没有进展,因为具有非高斯条目的矩阵很难进行类似的分 析,即使是,对更精细泛函的实际研究 $\mathbf{X X}^{\top}$ 充其量是繁琐的,而且通常只是赖手的。 物理学家 Eugene Wigner [Wigner,1955] 的著作为该理论注入了新的活力。对对称矩阵的特征值感兴趣 $\mathbf{X} \in \mathbb{R}^{n \times n}$ 有了独立的伯努利项(在他的应用上下文中是粒子自旋),维格纳选择了特征值分布的渐近 分析,从而开创了大维随机矩阵理论的重要且更丰富的分支。尽管有这个重要的启发,维格纳还是利用标 准的渐近统计工具 (矩量法) 来证明特征值的离散分布 $\mathbf{X}$ 具有连续的半圆形外观密度 $n \rightarrow \infty$ 极限 (现在 流行的半圆定律)。这种方法特别方便,因为极限定律很简单并且可以在视觉上预期(这不是即将到来的 Wishart 矩阵的 Marčenko-Pastur 极限分布的情况)。 直到 1967 年,随着 Marčenko 和 Pastur [1967] 的杰作,随机矩阵理论才进入了一个新的维度。 Marčenko 和 Pastur 确定了样本协方差矩阵模型的极限光谱分布 $\mathbf{X X}^{\top}$ Wishart 但在宽松的条件下: $[\mathbf{X}] i j$ 是具有零均值和单位方差的独立条目,以及额外的矩假设(所有在后续工作中都被丟弃)。独立性 (或弱依赖性) 属性是他们证明的关键,它利用了强大的 Stieltjes 变换 $\frac{1}{p} \operatorname{tr}\left(\frac{1}{n} \mathbf{X} \mathbf{X}^{\top}-z \mathbf{I}_p\right)^{-1}=\int(\lambda-z)^{-1} \mu_p(d t)$ 经验光谱分布 $\mu_p \equiv \frac{1}{p} \sum i=1^p \delta{\lambda_i}\left(\frac{1}{n} \mathbf{X} \mathbf{X}^{\top}\right)^{\text {的 }}$ $\frac{1}{n} \mathbf{X X}^{\top}$ ,一种从布尔伯特空间中的算子理论借用的工具 [Akhiezer 和 Glazman,2013],而不是矩 $\frac{1}{p} \operatorname{tr}\left(\frac{1}{n} \mathbf{X X}^{\top}\right)^k$ (这可能不会收敛,因为 $\mathbb{E}\left[\mathbf{X}_{i j}^{\ell}\right]$ 不必是有限的 $\ell>2$ ).

Marčenko 和 Pastur 设计的技术方法在 21 世纪之交被 Bai 和 Silverstein 广泛接受,他们取得了一系列 重大突破 (其中最引人注目的是 [Silverstein 和 Bai, 1995,Bai 和 Silverstein,1998]), 将 [Marčenko 和 Pastur, 1967] 中的结果扩展到对样本协方差矩阵的详尽研究。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。