如果你也在 怎样代写神经网络neural networks这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

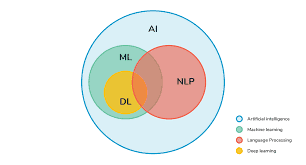

神经网络,也被称为人工神经网络(ANN)或模拟神经网络(SNN),是机器学习的一个子集,是深度学习算法的核心。它们的名称和结构受到人脑的启发,模仿了生物神经元相互之间的信号方式。

statistics-lab™ 为您的留学生涯保驾护航 在代写神经网络neural networks方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写神经网络neural networks代写方面经验极为丰富,各种代写神经网络neural networks相关的作业也就用不着说。

我们提供的神经网络neural networks及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

计算机代写|神经网络代写neural networks代考|Representation Learning for Speech Recognition

Nowadays, speech interfaces or systems have become widely developed and integrated into various real-life applications and devices. Services like Siri ${ }^{1}$, Cortana ${ }^{2}$, and Google Voice Search ${ }^{3}$ have become a part of our daily life and are used by millions of users. The exploration in speech recognition and analysis has always been motivated by a desire to enable machines to participate in verbal human-machine interactions. The research goals of enabling machines to understand human speech, identify speakers, and detect human emotion have attracted researchers’ attention for more than sixty years across several distinct research areas, including but not limited to Automatic Speech Recognition (ASR), Speaker Recognition (SR), and Speaker Emotion Recognition (SER).

Analyzing and processing speech has been a key application of machine learning (ML) algorithms. Research on speech recognition has traditionally considered the task of designing hand-crafted acoustic features as a separate distinct problem from the task of designing efficient models to accomplish prediction and classification decisions. There are two main drawbacks of this approach: First, the feature engineering is cumbersome and requires human knowledge as introduced above; and second, the designed features might not be the best for the specific speech recognition tasks at hand. This has motivated the adoption of recent trends in the speech community towards the utilization of representation learning techniques, which can learn an intermediate representation of the input signal automatically that better fits into the task at hand and hence lead to improved performance. Among all these successes, deep learning-based speech representations play an important role. One of the major reasons for the utilization of representation learning techniques in speech technology is that speech data is fundamentally different from two-dimensional image data. Images can be analyzed as a whole or in patches, but speech has to be formatted sequentially to capture temporal dependency and patterns.

计算机代写|神经网络代写neural networks代考|Representation Learning for Natural Language Processing

Besides speech recognition, there are many other Natural Language Processing (NLP) applications of representation learning, such as the text representation learning. For example, Google’s image search exploits huge quantities of data to map images and queries in the same space (Weston et al, 2010) based on NLP techniques. In general, there are two types of applications of representation learning in $\mathrm{NLP}$. In one type, the semantic representation, such as the word embedding, is trained in a pre-training task (or directly designed by human experts) and is transferred to the model for the target task. It is trained by using language modeling objective and is taken as inputs for other down-stream NLP models. In the other type, the semantic representation lies within the hidden states of the deep learning model and directly aims for better performance of the target tasks in an end-to-end fashion. For example, many NLP tasks want to semantically compose sentence or document representation, such as tasks like sentiment classification, natural language inference, and relation extraction, which require sentence representation.

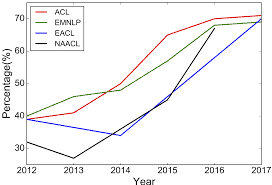

Conventional NLP tasks heavily rely on feature engineering, which requires careful design and considerable expertise. Recently, representation learning, especially deep learning-based representation learning is emerging as the most important technique for NLP. First, NLP is typically concerned with multiple levels of language entries, including but not limited to characters, words, phrases, sentences, paragraphs, and documents. Representation learning is able to represent the semantics of these multi-level language entries in a unified semantic space, and model complex semantic dependence among these language entries. Second, there are various NLP tasks that can be conducted on the same input. For example, given a sentence, we can perform multiple tasks such as word segmentation, named entity recognition, relation extraction, co-reference linking, and machine translation. In this case, it will be more efficient and robust to build a unified representation space of inputs for multiple tasks. Last, natural language texts may be collected from multiple domains, including but not limited to news articles, scientific articles, literary works, advertisement and online user-generated content such as product reviews and social media. Moreover, texts can also be collected from different languages, such as English, Chinese, Spanish, Japanese, etc. Compared to conventional NLP systems which have to design specific feature extraction algorithms for each domain according to its characteristics, representation learning enables us to build representations automatically from large-scale domain data and even add bridges among these languages from different domains. Given these advantages of representation learning for NLP in the feature engineering reduction and performance improvement, many researchers have developed efficient algorithms on representation learning, especially deep learning-based approaches, for NLP.

神经网络代写

计算机代写|神经网络代写neural networks代考|Representation Learning for Speech Recognition

如今,语音接口或系统已得到广泛开发并集成到各种现实生活中的应用程序和设备中。Siri 等服务1, 小娜2和谷歌语音搜索3已成为我们日常生活的一部分,并被数百万用户使用。语音识别和分析的探索一直是由希望机器参与人机交互的愿望所推动的。60 多年来,使机器能够理解人类语音、识别说话者和检测人类情感的研究目标在多个不同的研究领域吸引了研究人员的关注,包括但不限于自动语音识别 (ASR)、说话人识别 (SR) ) 和说话者情绪识别 (SER)。

分析和处理语音一直是机器学习 (ML) 算法的关键应用。语音识别研究传统上认为设计手工声学特征的任务与设计有效模型以完成预测和分类决策的任务是分开的不同问题。这种方法有两个主要缺点:首先,特征工程很麻烦,需要上面介绍的人类知识;其次,设计的功能可能不是手头特定语音识别任务的最佳选择。这推动了语音社区采用表示学习技术的最新趋势,它可以自动学习输入信号的中间表示,以更好地适应手头的任务,从而提高性能。在所有这些成功中,基于深度学习的语音表示起着重要作用。在语音技术中使用表示学习技术的主要原因之一是语音数据与二维图像数据有根本的不同。图像可以作为一个整体或块进行分析,但语音必须按顺序格式化以捕获时间依赖性和模式。在语音技术中使用表示学习技术的主要原因之一是语音数据与二维图像数据有根本的不同。图像可以作为一个整体或块进行分析,但语音必须按顺序格式化以捕获时间依赖性和模式。在语音技术中使用表示学习技术的主要原因之一是语音数据与二维图像数据有根本的不同。图像可以作为一个整体或块进行分析,但语音必须按顺序格式化以捕获时间依赖性和模式。

计算机代写|神经网络代写neural networks代考|Representation Learning for Natural Language Processing

除了语音识别之外,表示学习还有许多其他自然语言处理 (NLP) 应用,例如文本表示学习。例如,Google 的图像搜索利用大量数据基于 NLP 技术在同一空间中映射图像和查询(Weston 等,2010)。一般来说,表示学习有两种类型的应用:ñ大号磷. 在一种类型中,语义表示,例如词嵌入,在预训练任务中进行训练(或由人类专家直接设计),然后转移到目标任务的模型中。它通过使用语言建模目标进行训练,并作为其他下游 NLP 模型的输入。在另一种类型中,语义表示位于深度学习模型的隐藏状态中,直接旨在以端到端的方式更好地执行目标任务。例如,许多 NLP 任务想要在语义上组成句子或文档表示,例如情感分类、自然语言推理和关系提取等任务,这些任务都需要句子表示。

传统的 NLP 任务严重依赖于特征工程,这需要仔细的设计和丰富的专业知识。最近,表示学习,尤其是基于深度学习的表示学习正在成为 NLP 最重要的技术。首先,NLP 通常关注多层次的语言条目,包括但不限于字符、单词、短语、句子、段落和文档。表示学习能够在统一的语义空间中表示这些多级语言条目的语义,并对这些语言条目之间的复杂语义依赖关系进行建模。其次,可以在相同的输入上执行各种 NLP 任务。例如,给定一个句子,我们可以执行分词、命名实体识别、关系提取、共指链接等多项任务,和机器翻译。在这种情况下,为多个任务构建一个统一的输入表示空间将更加高效和稳健。最后,可以从多个领域收集自然语言文本,包括但不限于新闻文章、科学文章、文学作品、广告和在线用户生成的内容,例如产品评论和社交媒体。此外,还可以从不同的语言中收集文本,例如英语、中文、西班牙语、日语等。与传统的 NLP 系统必须根据每个领域的特征设计特定的特征提取算法相比,表示学习使我们能够构建从大规模域数据中自动表示,甚至在来自不同域的这些语言之间添加桥梁。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。