数学代写|信息论代写information theory代考|ECE4042

如果你也在 怎样代写信息论information theory这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

信息论是对数字信息的量化、存储和通信的科学研究。该领域从根本上是由哈里-奈奎斯特和拉尔夫-哈特利在20世纪20年代以及克劳德-香农在20世纪40年代的作品所确立的。

statistics-lab™ 为您的留学生涯保驾护航 在代写信息论information theory方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写信息论information theory代写方面经验极为丰富,各种代写信息论information theory相关的作业也就用不着说。

我们提供的信息论information theory及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

数学代写|信息论代写information theory代考|Definition of entropy of a continuous random variable

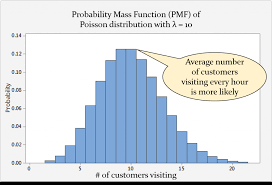

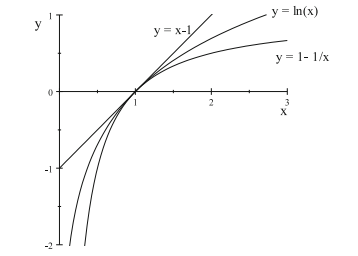

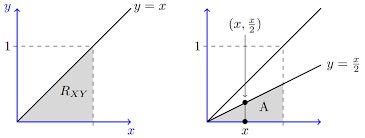

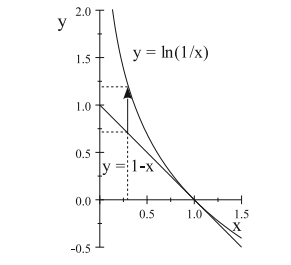

Up to now we have assumed that a random variable $\xi$, with entropy $H_{\xi}$, can take values from some discrete space consisting of either a finite or a countable number of elements, for instance, messages, symbols, etc. However, continuous variables are also widespread in engineering, i.e. variables (scalar or vector), which can take values from a continuous space $X$, most often from the space of real numbers. Such a random variable $\xi$ is described by the probability density function $p(\xi)$ that assigns the probability

$$

\Delta P=\int_{\xi \varepsilon \Delta X} p(\xi) d \xi \approx p(A) \Delta V \quad(A \in \Delta X)

$$

of $\xi$ appearing in region $\Delta X$ of the specified space $X$ with volume $\Delta V(d \xi=d V$ is a differential of the volume).

How can we define entropy $H_{\xi}$ for such a random variable? One of many possible formal ways is the following: In the formula

$$

H_{\xi}=-\sum_{\xi} P \xi \ln P(\xi)=-\mathbb{E}[\ln P(\xi)]

$$

appropriate for a discrete variable we formally replace probabilities $P(\xi)$ in the argument of the logarithm by the probability density and, thereby, consider the expression

$$

H_{\xi}=-\mathbb{E}[\ln p(\xi)]=-\int_{x} p(\xi) \ln p(\xi) d \xi .

$$

This way of defining entropy is not well justified. It remains unclear how to define entropy in the combined case, when a continuous distribution in a continuous space coexists with concentrations of probability at single points, i.e. the probability density contains delta-shaped singularities. Entropy (1.6.2) also suffers from the drawback that it is not invariant, i.e. it changes under a non-degenerate transformation of variables $\eta=f(\xi)$ in contrast to entropy (1.6.1), which remains invariant under such transformations.

数学代写|信息论代写information theory代考|Properties of entropy in the generalized version

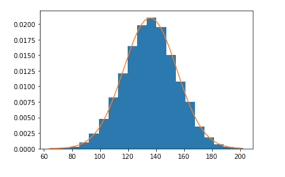

Entropy (1.6.13), (1.6.16) defined in the previous section possesses a set of properties, which are analogous to the properties of an entropy of a discrete random variable considered earlier. Such an analogy is quite natural if we take into account the interpretation of entropy (1.6.13) (provided in Section 1.6) as an asymptotic case (for large $N$ ) of entropy (1.6.1) of a discrete random variable.

The non-negativity property of entropy, which was discussed in Theorem $1.1$, is not always satisfied for entropy (1.6.13), (1.6.16) but holds true for sufficiently large $N$. The constraint

$$

H_{\xi}^{P / Q} \leqslant \ln N

$$

results in non-negativity of entropy $H_{\xi}$.

Now we move on to Theorem $1.2$, which considered the maximum value of entropy. In the case of entropy (1.6.13), when comparing different distributions $P$ we need to keep measure $v$ fixed. As it was mentioned, quantity (1.6.17) is non-negative and, thus, (1.6.16) entails the inequality

$$

H_{\xi} \leqslant \ln N .

$$

At the same time, if we suppose $P=Q$, then, evidently, we will have

$$

H_{\xi}=\ln N .

$$

This proves the following statement that is an analog of Theorem $1.2$.

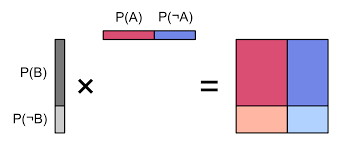

数学代写|信息论代写information theory代考|Encoding of discrete information

The definition of the amount of information, given in Chapter 1, is justified when we deal with a transformation of information from one kind into another, i.e. when considering encoding of information. It is essential that the law of conservation of information amount holds under such a transformation. It is very useful to draw an analogy with the law of conservation of energy. The latter is the main argument for introducing the notion of energy. Of course, the law of conservation of information is more complex than the law of conservation of energy in two respects. The law of conservation of energy establishes an exact equality of energies, when one type of energy is transformed into another. However, in transforming information we have a more complex relation, namely ‘not greater’ $(\leqslant)$, i.e. the amount of information cannot increase. The equality sign corresponds to optimal encoding. Thus, when formulating the law of conservation of information, we have to point out that there possibly exists such an encoding, for which the equality of the amounts of information occurs.

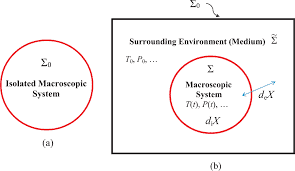

The second complication is that the equality is not exact. It is approximate, asymptotic, valid for complex (large) messages and for composite random variables. The larger a system of messages is, the more exact such a relation becomes. The exact equality sign takes place only in the limiting case. In this respect, there is an analogy with the laws of statistical thermodynamics, which are valid for large thermodynamic systems consisting of a large number (of the order of the Avogadro number) of molecules.

When conducting encoding, we assume that a long sequence of messages $\xi_{1}, \xi_{2}$, … is given together with their probabilities, i.e. a sequence of random variables. Therefore, the amount of information (entropy $H$ ) corresponding to this sequence can be calculated. This information can be recorded and transmitted by different realizations of the sequence. If $M$ is the number of such realizations, then the law of conservation of information can be expressed by the equality $H=\ln M$, which is complicated by the two above-mentioned factors (i.e. actually. $H \leqslant \ln M$ ).

Two different approaches may be used for solving the encoding problem. One can perform encoding of an infinite sequence of messages, i.e. online (or ‘sliding’) encoding. The inverse procedure, i.e. decoding, will be performed analogously.

信息论代考

数学代写|信息论代写information theory代考|Definition of entropy of a continuous random variable

到目前为止,我们假设一个随机变量 $\xi$, 有樀 $H_{\xi}$ ,可以从由有限或可数个元素组成的离散空间中取值,例如消息、

符号等。但是,连续变量在工程中也很普遍,即变量 (标量或向量),它可以取来自连续空间的值 $X$ ,通常来自实 数空间。这样的随机变量 $\xi$ 由概率密度函数描述 $p(\xi)$ 分配概率

$$

\Delta P=\int_{\xi \varepsilon \Delta X} p(\xi) d \xi \approx p(A) \Delta V \quad(A \in \Delta X)

$$

的 $\xi$ 出现在地区 $\Delta X$ 指定空间的 $X$ 有音量 $\Delta V(d \xi=d V$ 是体积的微分 $)$ 。

我们如何定义嫡 $H_{\xi}$ 对于这样一个随机变量? 许多可能的正式方式之一如下:在公式中

$$

H_{\xi}=-\sum_{\xi} P \xi \ln P(\xi)=-\mathbb{E}[\ln P(\xi)]

$$

适用于离散变量,我们正式替换概率 $P(\xi)$ 在概率密度的对数参数中,因此,考虑表达式

$$

H_{\xi}=-\mathbb{E}[\ln p(\xi)]=-\int_{x} p(\xi) \ln p(\xi) d \xi

$$

这种定义樀的方式是不合理的。目前尚不清楚如何在组合情况下定义熵,当连续空间中的连续分布与单个点的概率 集中共存时,即概率密度包含三角形奇点。熵 (1.6.2) 也有一个缺点,即它不是不变的,即它在变量的非退化变换 下变化 $\eta=f(\xi)$ 与熵 $(1.6 .1)$ 相反,熵在这种变换下保持不变。

数学代写|信息论代写information theory代考|Properties of entropy in the generalized version

上节定义的熵(1.6.13)、(1.6.16)具有一组性质,类似于前面考虑的离散随机变量的熵的性质。如果我们考虑将樀 (1.6.13) (在 $1.6$ 节中提供) 解释为渐近情况 (对于大 $N$ ) 的离散随机变量的嫡 (1.6.1)。

樀的非负性,在定理中讨论过 $1.1$ ,对于樀 (1.6.13), (1.6.16) 并不总是满足,但对于足够大的樀也成立 $N$. 约束

$$

H_{\xi}^{P / Q} \leqslant \ln N

$$

导致嫡的非负性 $H_{\xi}$.

现在我们继续讨论定理 $1.2$ ,它考虑了嫡的最大值。在熵 (1.6.13) 的情况下,当比较不同的分布时 $P$ 我们需要保 持测量 $v$ 固定的。如前所述,数量 (1.6.17) 是非负的,因此,(1.6.16) 包含不等式

$$

H_{\xi} \leqslant \ln N \text {. }

$$

同时,如果我们假设 $P=Q$ ,那么,显然,我们将有

$$

H_{\xi}=\ln N .

$$

这证明了以下与定理类似的陈述 $1.2$.

数学代写|信息论代写information theory代考|Encoding of discrete information

第 1 章中给出的信息量定义在我们处理信息从一种类型到另一种类型的转换时是合理的,即在考虑信息编码时。在 这种转变下,信息量守恒定律必须成立。与能量守恒定律进行类比是非常有用的。后者是引入能量概念的主要论 据。当然,信息守恒定律在两个方面比能量守恒定律更复杂。当一种能量转化为另一种能量时,能量守恒定律确立 了能量的精确相等性。然而,在转换信息时,我们有一个更复杂的关系,即“不是更大” $(\leqslant)$ ,即信息量不能增加。 等号对应于最佳编码。因此,在制定信息守恒定律时,我们必须指出,可能存在这样一种编码,其信息量相等。

第二个复杂因素是等式并不精确。它是近似的、渐近的,对复杂 (大) 消息和复合随机变量有效。消息系统越大, 这种关系就越精确。确切的等号仅在极限情况下出现。在这方面,与统计热力学定律有一个类比,该定律适用于由 大量 (阿伏伽德罗数级) 分子组成的大型热力学系统。

在进行编码时,我们假设一长串消息 $\xi_{1}, \xi_{2}, \ldots$ 连同它们的概率一起给出,即一系列随机变量。因此,信息量(樀 $H)$ 对应这个序列可以计算出来。该信息可以通过序列的不同实现来记录和传输。如果 $M$ 是这种实现的数量,则信 息守恒定律可以表示为等式 $H=\ln M$ ,这因上述两个因素而变得复杂(即实际上。 $H \leqslant \ln M$ ).

可以使用两种不同的方法来解决编码问题。可以对无限的消息序列进行编码,即在线 (或”滑动”) 编码。将类似地 执行相反的过程,即解码。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。