计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|AEM4060

如果你也在 怎样代写蒙特卡洛树搜索Monte Carlo tree search这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

蒙特卡洛树搜索是一种用于某些决策过程的启发式搜索算法,最引人注目的是在游戏中的使用。

statistics-lab™ 为您的留学生涯保驾护航 在代写蒙特卡洛树搜索Monte Carlo tree search方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写蒙特卡洛树搜索Monte Carlo tree search代写方面经验极为丰富,各种代写蒙特卡洛树搜索Monte Carlo tree search相关的作业也就用不着说。

我们提供的蒙特卡洛树搜索Monte Carlo tree search及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|MCTS for Go

The game of Go has proved to be one of the biggest challenges for AI due to its complexity and the effect that moves have on long term success of the game [6]. The application to more sophisticated MCTS algorithms like UCT to games like Go have greatly improved the rankings of Go systems to the top of the amateur level [6].

Recently in 2015, Google’s AlphaGo program was the first program to defeat a 9-dan (i.e. top-ranked) professional in a game without handicaps. That version of AlphaGo, named AlphaGo Fan, was fairly complicated and used multiple neural networks trained on expert play to guide decision making. Afterwards, AlphaGo Lee was created that used a similar design as that of AlphaGo Fan, but depended more on data generated from self-play to learn the value functions of states. AlphaGo Lee was the most famous iteration of AlphaGo since it was the one that beat the European champion Lee Sedol in 2016. In 2017, Google released an AI on an online Go server that was able to beat top human players 60-0 named AlphaGo Master. Google published their final design AlphaGo Zero which shared many similarities to AlphaGo Master but removed some complications relating to evaluating states. This final version, AlphaGo Zero, learned the strategies of the game of Go exclusively from games of self-play and using a single neural network to do so.

This section will have no theoretical results but serve rather as an exposition on how to specialize MCTS to be successful in a specific application.

AlphaGo Zero is a specific instantiation of the general MCTS algorithm that uses a neural network learned using reinforcement learning to help guide the decision making process. One of the most important things about this system is that it is trained only by playing against itself and improving from there; it learned the strategy of how to play Go from no prior background. To understand how AlphaGo Zero works, we first specify how its decision process fits in the general MCTS framework and then we will describe how it is trained. This entire section uses [7] as a reference so further citations will be omitted.

计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|AlphaGo Zero MCTS

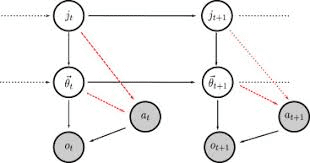

MCTS for AlphaGo works very similarly to how it works in UCT and the terminology is referenced heavily from there. While the computational budget hasn’t been exceeded, episodes are played out to iteratively builds up a game tree from a start state $s$ in order to estimate which action is optimal from from s. During each episode, a game is played out by using a Tree Policy to decide a path down the known tree, a leaf node is expanded and it’s value estimated using a trained netural network, and that information is percolated back up the tree.

Because the game alternates between two players on each turn, each level of the tree models a different player just like a minimax tree. The algorithm stays the same at each level of the tree but just makes decision to make the current player win. This makes sense for games like Go because it’s a perfect information game and you can use the same estimation technique to approximate how the opponent will play optimally with an approximation that improves with computation time.

Phase One: Play-out iterations to build tree The Tree Policy that determines the path down the tree on each episode that the algorithm is rum is:

$$

a_t=\underset{a \in \mathcal{A}}{\arg \max } Q\left(s_t, a\right)+U\left(s_t, a\right)

$$

This is very similar to UCT because $Q\left(s_t, a\right)$ represents an empirical average of the value of taking action $a$ from state $s_t . U\left(s_t, a\right)$ is a an additional term to encourage exploration when the value estimates lack high-confidence and favors actions that have a higher prior-probability. Each episode $i$ ends the tree policy at a leaf node $s_L^i$. After $n$ episodes in total, we define the terms above as

$$

\begin{aligned}

& N(s, a)=\sum_{i=1}^n \mathbb{1}(s, a, i) \

& Q(s, a)=\frac{1}{N(s, a)} \sum_{i=1}^n \mathbb{1}(s, a, i) V\left(s_L^i\right) \

& U(s, a)=c P(s, a) \frac{\sqrt{\sum_{b \in \mathcal{A}} N(s, b)}}{1+N(s, a)}

\end{aligned}

$$

where $\mathbb{1}(s, a, i)$ is an indicator that action $a$ was chosen from state $s$ on iteration $i$, $V\left(s_L^i\right)$ is an estimate of the value of a state (in the case of games it is an indication of how likely it is that the current player will win), and $P(s, a)$ is a prior probability of selecting action $a$ from state $s$. These $Q$ and $V$ functions are exactly estimates of the Q-values and V-values of the game.

蒙特卡洛树搜索代考

计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|MCTS for Go

围棋游戏已被证明是人工智能面临的最大挑战之一,因为它的复杂性和移动对游戏的长期成功的影响 [6]。将 UCT 等更复杂的 MCTS 算法应用到围棋等游戏中,极大地提高了围棋系统的排名,达到业余水平 [6]。

最近在 2015 年,Google 的 AlphaGo 程序是第一个在无让分的比赛中击败 9 段(即顶级)职业选手的程序。那个版本的 AlphaGo,名为 AlphaGo Fan,相当复杂,并使用多个经过专家对弈训练的神经网络来指导决策制定。之后,AlphaGo Lee 的诞生采用了与 AlphaGo Fan 类似的设计,但更多地依赖于自我对弈产生的数据来学习状态的价值函数。AlphaGo Lee 是最著名的 AlphaGo 迭代,因为它在 2016 年击败了欧洲冠军李世石。2017 年,谷歌在在线围棋服务器上发布了一个人工智能,该人工智能能够以 60-0 击败顶级人类棋手,名为 AlphaGo Master . 谷歌发布了他们的最终设计 AlphaGo Zero,它与 AlphaGo Master 有许多相似之处,但删除了一些与评估状态相关的复杂性。这个最终版本,AlphaGo Zero,完全从自我对弈的游戏中学习了围棋游戏的策略,并使用单个神经网络来这样做。

本节将没有理论结果,而是作为对如何专业化 MCTS 以在特定应用程序中取得成功的阐述。

AlphaGo Zero 是通用 MCTS 算法的特定实例,它使用通过强化学习学习的神经网络来帮助指导决策过程。这个系统最重要的事情之一是它只能通过与自己对战并从那里改进来训练;它从没有任何先验背景的情况下学习了如何下围棋的策略。为了解 AlphaGo Zero 的工作原理,我们首先说明它的决策过程如何适应通用 MCTS 框架,然后我们将描述它是如何训练的。整个部分使用 [7] 作为参考,因此将省略进一步的引用。

计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|AlphaGo Zero MCTS

AlphaGo 的 MCTS 的工作方式与它在 UCT 中的工作方式非常相似,并且大量引用了那里的术语。虽然没 有超过计算预算,但会播放剧集以从开始状态迭代地构建游戏树 $s$ 为了从 $\mathrm{s}$ 估计哪个动作是最优的。在每 一集中,通过使用 Tree Policy 来决定沿着已知树的路径进行游戏,扩展叶节点并使用训练有素的神经网 络估计其值,并将该信息向上渗透到树中。

因为游戏在每一轮都在两个玩家之间交替,所以树的每个级别都为不同的玩家建模,就像极小极大树一 样。该算法在树的每个级别都保持不变,但只是做出让当前玩家获胜的决定。这对于像围棋这样的游戏来 说是有意义的,因为它是一个完美的信息游戏,您可以使用相同的估计技术来估计对手将如何最佳下棋, 这种近似会随着计算时间的增加而提高。

第一阶段:播放迭代以构建树树策略确定算法是朗姆酒的每一集的树下路径是:

$$

a_t=\underset{a \in \mathcal{A}}{\arg \max } Q\left(s_t, a\right)+U\left(s_t, a\right)

$$

这与 UCT 非常相似,因为 $Q\left(s_t, a\right)$ 表示采取行动的价值的经验平均值 $a$ 来自州 $s_t . U\left(s_t, a\right)$ 是一个附加 术语,用于在价值估计缺乏高置信度并支持具有更高先验概率的行动时鼓励探索。每集 $i$ 在叶节点处结束 树策略 $s_L^i$. 后 $n$ 总的剧集,我们将上面的术语定义为

$$

N(s, a)=\sum_{i=1}^n 1(s, a, i) \quad Q(s, a)=\frac{1}{N(s, a)} \sum_{i=1}^n 1(s, a, i) V\left(s_L^i\right) U(s, a)=c P(s, a) \frac{\sqrt{\sum_b}}{1+}

$$

在哪里 $1(s, a, i)$ 是行动的指标 $a$ 被选出州 $s$ 在迭代中 $i, V\left(s_L^i\right)$ 是对状态值的估计(在游戏的情况下,它表 示当前玩家获胜的可能性),并且 $P(s, a)$ 是选择动作的先验概率 $a$ 来自州 $s$. 这些 $Q$ 和 $V$ 函数正是对游戏 $Q$ 值和 $V$ 值的估计。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。