如果你也在 怎样代写蒙特卡洛树搜索Monte Carlo tree search这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

蒙特卡洛树搜索是一种用于某些决策过程的启发式搜索算法,最引人注目的是在游戏中的使用。

statistics-lab™ 为您的留学生涯保驾护航 在代写蒙特卡洛树搜索Monte Carlo tree search方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写蒙特卡洛树搜索Monte Carlo tree search代写方面经验极为丰富,各种代写蒙特卡洛树搜索Monte Carlo tree search相关的作业也就用不着说。

我们提供的蒙特卡洛树搜索Monte Carlo tree search及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

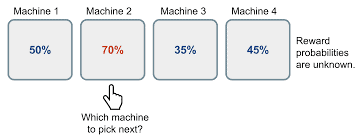

计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|Multi-armed Bandits

It has been shown that the best possible policy $\pi(t)$ has a regret bounded by $\Omega(\ln n)$, and any policy that is within a constant factor of this is considered to balance the exploration-exploitation trade-off in the tree policy well. One such algorithm is UCB1. [3]

The high level concept of UCB1 is simple: pick the arm with the highest confidence bound on its mean reward. To facilitate this, UCB1 tracks the empirical average of each arm’s rewards $\bar{X}{i, T_c(t-1)}$ up to time $t$. As a result, when incorporating UCB into MCTS, it becomes necessary to track empirical average reward in MCTS. The policy is outlined in Equation 2, where $c{t, s}$ is a bias sequence over time $t$ and sample size $s$, picked such that both Equation 3 and Equation 4 are satisfied.

$$

\begin{aligned}

\mathrm{UCB} 1(t)= & \arg \max \left{\bar{X}{i, T_i(t-1)}+c{t-1, T_i(t-1)}\right} \

& \mathbb{P}\left(\bar{X}{i, s} \geq \mu_i+c{t, s}\right) \leq t^{-4} \

& \mathbb{P}\left(\bar{X}{i, s} \leq \mu_i-c{t, s}\right) \leq t^{-4}

\end{aligned}

$$

For standard multi-armed bandits, the bias sequence $c_{t, s}=\sqrt{\frac{2 \ln t}{s}}$ is appropriate. Note that the bias sequence is proportional to time and inversely proportional to sample size. It is designed so that confidence bounds expand slowly over time, but contract quickly as we gather more data.

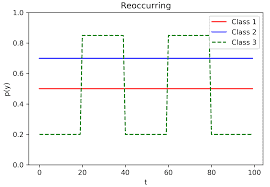

计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|Drifting Multi-armed Bandits

For more detail on any of the theorems discussed in this section, please refer to [5]. In order to understand UCT, we must first relax the restraints on $K$-armed bandits to allow each arm’s mean $\mu_i$ to change over time t. While we can no longer rely on the assumption that the mean of each arm is fixed from $t=1$ onward, we can assume that the expected value of the empirical averages converge. We let $\bar{X}{i, n}=\frac{1}{n} \sum{t=1}^n X_{i, t}$ be the empirical average of arm $i$ at time $n$, and $\mu_{i, n}=\mathbb{E}\left[\tilde{X}{i, n}\right]$ be its expected value. Therefore, we now have a sequence of expected means for each arm $i$, namely $\mu{i, n}$. We assume that these expected means eventually converge to one final mean $\mu_i=\lim {n \rightarrow \infty} \mu{i, n}$. We further define a sequence of offsets for each arm as $\delta_{i, n}=\mu_{i, n}-\mu_i$. We also make the following assumptions about the reward sequence:

Assumption 1. Fix $1 \leq i \leq K$. Let $\left{\mathcal{F}{i, t}\right}_t$ be a fultration such that $\left{X{i, t}\right}_t$ is $\left{\mathcal{F}{i, t}\right}$-adapted and $X{i, t}$ is conditionally independent of $\mathcal{F}{i, t+1}, \mathcal{F}{i, t+2}, \ldots$ given $\mathcal{F}{i, t-1}{ }^1$. Then $0 \leq X{i, t} \leq 1$ and the limit of $\mu_{i, n}=\mathbb{E}\left[\bar{X}{i n}\right]$ exists. Further, we assume that there exist a constant $C_p>0$ and an integer $N_p$ such that for $n \geq N_p$. for any $\delta>0, \Delta_n(\delta)=C_p \sqrt{n \ln (1 / \delta)}$, the following bounds hold: $$ \begin{aligned} & \mathbb{P}\left(n \bar{X}{i, n} \geq n \mathbb{E}\left[\bar{X}{i, n}\right]+\Delta_n(\delta)\right) \leq \delta \ & \mathbb{P}\left(n \bar{X}{i, n} \leq n \mathbb{E}\left[\bar{X}{i, n}\right]-\Delta_n(\delta)\right) \leq \delta \end{aligned} $$ This assumption allows us to define a bias sequence $c{t, s}$ for time $t$ and sample size $s$ which satisfies Equation 3 and Equation 4. This sequence is as follows:

$$

c_{t, s}=2 C_p \sqrt{\frac{\ln t}{s}}

$$

We define $\Delta_i=\mu^-\mu_i$ to be the loss of arm $i$. Recall that since the expected mean of each arm converges, the mean offset $\delta_{i, t}$ converges to zero. Therefore, there exists a time $N_0(\epsilon)$ at which the uncertainty of the true mean rewards are guaranteed to be within a factor $\epsilon$ of their distance from the optimal mean, and the uncertainty of the optimal mean is guaranteed to be within the same factor $\epsilon$ of its distance to to closest suboptimal mean. Therefore, even though we still have some uncertainty as to what the true means really are, we have enough information to know which is probably the best, as $\mu_{N_0(c)}$ is closer to $\mu^$ than it is to any $\mu_{i, N_0(\epsilon)}$. More formally, $N_0(\epsilon): \mathbb{R} \rightarrow \mathbb{N}$ is a function which returns the minimum $t$ for which $2\left|\delta_{i, t}\right| \leq \epsilon \Delta_i$ for all arms $i$, and $2\left|\delta_{j^*, t}\right| \leq \epsilon \min _i \Delta_i$. Under Assumption 1, and using the preceding definitions, we can upper bound the expected number of times that a suboptimal arm will be played by UCB1 when the means are allowed to drift.

蒙特卡洛树搜索代考

计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|Multi-armed Bandits

事实证明,最好的政策 $\pi(t)$ 有一个遗憾的界限 $\Omega(\ln n)$ ,并且任何在这个常数因子内的策略都被认为可以 很好地平衡树策略中的探索-开发权衡。一种这样的算法是 UCB1。[3]

UCB1 的高级概念很简单: 选择对其平均奖励具有最高置信度的手臂。为了促进这一点, UCB1 跟踪每个 手臂奖励的经验平均值 $\bar{X} i, T_c(t-1)$ 及时 $t$. 因此,将 UCB 纳入 MCTS 时,有必要跟踪 MCTS 中的经验 平均奖励。公式 2 概述了该策略,其中 $c t, s$ 是随时间变化的偏置序列 $t$ 和样本量 $s$ ,被选中使得方程 3 和方 程 4 都得到满足。

Ibegin{aligned $} \backslash \operatorname{mathrm}{U C B} 1(\mathrm{t})=\& \backslash \arg \backslash \max \backslash \mathrm{left}\left{\backslash b a r{X}\left{\mathrm{i}, T_{-} \mathrm{i}(\mathrm{t}-1)\right}+c\left{\mathrm{t}-1, T_{-} \mathrm{i}(\mathrm{t}-1)\right} \backslash r i g h t\right} \backslash \& \backslash \operatorname{mathbb}{\mathrm{P}} \backslash \mathrm{ft}(\mathbf{x}$

对于标准的多臂老虎机,偏置序列 $c_{t, s}=\sqrt{\frac{2 \ln t}{s}}$ 是合适的。请注意,偏差序列与时间成正比,与样本量 成反比。它的设计使置信界限随着时间的推移缓慢扩大,但随看我们收集更多数据而迅速收缩。

计算机代写|蒙特卡洛树搜索代写Monte Carlo tree search代考|Drifting Multi-armed Bandits

有关本节中讨论的任何定理的更多详细信息,请参阅 [5]。为了理解UCT,我们必须首先放松对 $K$-武装土 罒允许每只手臂的意思 $\mu_i$ 随时间 $\mathrm{t}$ 变化。虽然我们不能再依赖这样的假设,即每只手臂的平均值是固定的 $t=1$ 向前,我们可以假设经验平均值的期望值收敛。我们让 $\bar{X} i, n=\frac{1}{n} \sum t=1^n X_{i, t}$ 是 arm 的经验 平均值 $i$ 在时间 $n$ ,和 $\mu_{i, n}=\mathbb{E}[\tilde{X} i, n]$ 是它的期望值。因此,我们现在对每只手臂都有一系列预期均值 $i$, 即 $\mu i, n$. 我们假设这些预期均值最终会收敛到一个最终均值 $\mu_i=\lim n \rightarrow \infty \mu i, n$. 我们进一步定义 每个臂的偏移序列为 $\delta_{i, n}=\mu_{i, n}-\mu_i$. 我们还对奖励序列做出以下假设:

假设 1 . 修复 $1 \leq i \leq K$. 让 Veft{\mathcal{F}{i, $t} \backslash r i g h t}_{-} t$ 是这样的 Veft ${X{i, t} \backslash r i g h t}_{-} t$ 是

Veft{\mathcal{F}{i, t}\right } } \text { -改编和 } X i , t \text { 有条件地独立于 } \mathcal { F } i , t + 1 , \mathcal { F } i , t + 2 , \ldots \text { 给予 } \mathcal { F } i , t – 1 ^ { 1 } \text { . 然后 } $0 \leq X i, t \leq 1$ 和极限 $\mu_{i, n}=\mathbb{E}[\bar{X} i n]$ 存在。此外,我们假设存在一个常数 $C_p>0$ 和一个整数 $N_p$ 这样 对于 $n \geq N_p$. 对于任何 $\delta>0, \Delta_n(\delta)=C_p \sqrt{n \ln (1 / \delta)}$ ,以下界限成立:

$$

\mathbb{P}\left(n \bar{X} i, n \geq n \mathbb{E}[\bar{X} i, n]+\Delta_n(\delta)\right) \leq \delta \quad \mathbb{P}\left(n \bar{X} i, n \leq n \mathbb{E}[\bar{X} i, n]-\Delta_n(\delta)\right) \leq \delta

$$

这个假设允许我们定义偏置序列 $c t, s$ 时间 $t$ 和样本量 $s$ 满足公式 3 和公式 4。此序列如下:

$$

c_{t, s}=2 C_p \sqrt{\frac{\ln t}{s}}

$$

我们定义 $\Delta_i=\mu^{-} \mu_i$ 失去手臂 $i$. 回想一下,由于每个臂的预期均值收敛,所以均值偏移量 $\delta_{i, t}$ 收敛于 零。因此,存在一个时间 $N_0(\epsilon)$ 保证真实平均奖励的不确定性在一个因素内 $\epsilon$ 它们与最优均值的距离,并 且最优均值的不确定性保证在同一因子内 $\epsilon$ 它到最接近的次优均值的距离。因此,尽管我们仍然不确定真 正的方法到底是什么,但我们有足够的信息来知道哪个可能是最好的,因为 $\mu_{N_0(c)}$ 更接近 $\backslash$ 亩^比对任何 人 $\mu_{i, N_0(\epsilon)}$. 更正式地说, $N_0(\epsilon): \mathbb{R} \rightarrow \mathbb{N}$ 是一个返回最小值的函数 $t$ 为了哪个 $2\left|\delta_{i, t}\right| \leq \epsilon \Delta_i$ 对于所有武 器 $i$ ,和 $2\left|\delta_{j^*, t}\right| \leq \epsilon \min _i \Delta_i$. 在假设 1 下,并使用前面的定义,我们可以设定在允许均值漂移时 UCB1 将使用次优臂的预期次数上限。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。