澳洲代写 随机过程Stochastic process代考2023

如果你也在随机过程Stochastic process这个学科遇到相关的难题,请随时添加vx号联系我们的代写客服。我们会为你提供专业的服务。

statistics-lab™ 长期致力于留学生网课服务,涵盖各个网络学科课程:金融学Finance,经济学Economics,数学Mathematics,会计Accounting,文学Literature,艺术Arts等等。除了网课全程托管外,statistics-lab™ 也可接受单独网课任务。无论遇到了什么网课困难,都能帮你完美解决!

statistics-lab™ 为您的留学生涯保驾护航 在代写代考随机过程Stochastic process方面已经树立了自己的口碑, 保证靠谱, 高质量且原创的统计Statistics和数学Math代写服务。我们的专家在代考随机过程Stochastic process相关的作业也就用不着说。

随机过程Stochastic process代考

在数学中,更确切地说,在概率论中,随机过程(或随机过程)是动态系统概念的概率版本。随机过程是某个参数(通常是时间)的实函数的有序集合,具有某些统计特性。一般来说,可以将这一过程确定为实数随机变量 $X(t)$ 的单参数族,代表从初始状态到一定时间 $t$ 之后的状态的变换。更精确地说,这是基于实数极限上的随机变量(如 $\mathbb{R}^n$,或函数空间,或实数的连续)。当时间参数也被考虑在内时,随机过程就是随机变量概念的扩展。

随机过程Stochastic process包含几个不同的主题,列举如下:

泛函分析Functional analysis代写代考

函数分析(也写作函数分析,Analyse fonctionnelle,法语。 也称拓扑分析)。 是数学(尤其是分析)的一个分支,起源于对傅立叶变换、微分方程和积分方程的研究。 它研究函数空间的结构,为由某类函数组成的向量空间定义了某种拓扑结构,并研究由其公理化得到的线性拓扑空间。 主要兴趣在于通过各种函数空间上由积分和微分定义的线性算子的行为,对积分和微分方程进行线性代数处理,这通常被视为无穷维向量空间上的线性代数。 它也可被视为无穷维空间上的微分和积分微积分,因为它涉及无穷维空间上的导数(如弗雷谢特导数)。

傅立叶分析Fourier analysis代写代考

在数学分析中,傅里叶分析,也称为调和分析,是一个研究分支,始于让·巴蒂斯特·约瑟夫·傅里叶的研究,他在十九世纪初成功地用数学方法证明了如何将任何周期函数分解为无限“适当”正弦函数或分量(正弦和余弦)的总和,称为谐波。 从这一观察中诞生了将复杂函数分解为一系列函数(称为傅里叶级数)的想法,使它们的分析更简单、更有利。 傅里叶变换的概念以及相关的频域概念也源自傅里叶级数的数学概念。

其他相关科目课程代写:

- 数学模型Mathematical model

- 线性代数Linear algebra

- 概率学Probability

随机过程Stochastic process定义

随机或随机过程可以定义为由某个数学集合索引的随机变量集合,这意味着随机过程中的每个随机变量都与集合中的某个元素唯一相关。从历史上看,索引集是实线的某个子集,如自然数,这就赋予了索引集时间的解释[1]。例如,状态空间可以是整数、实线或……。n 维欧几里得空间]。增量是随机过程在两个指数值之间的变化量,通常被解释为两个时间点。由于随机性,随机过程可以有很多结果,随机过程的单一结果被称为样本函数或实现。

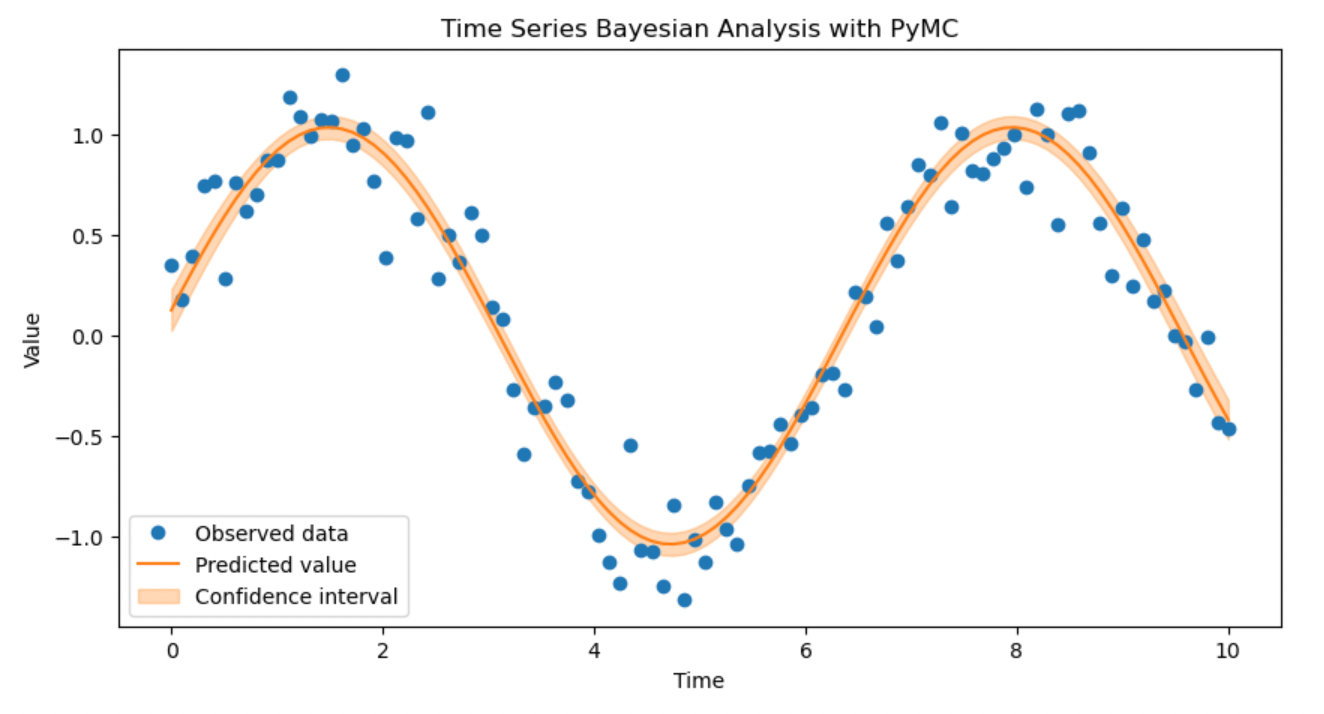

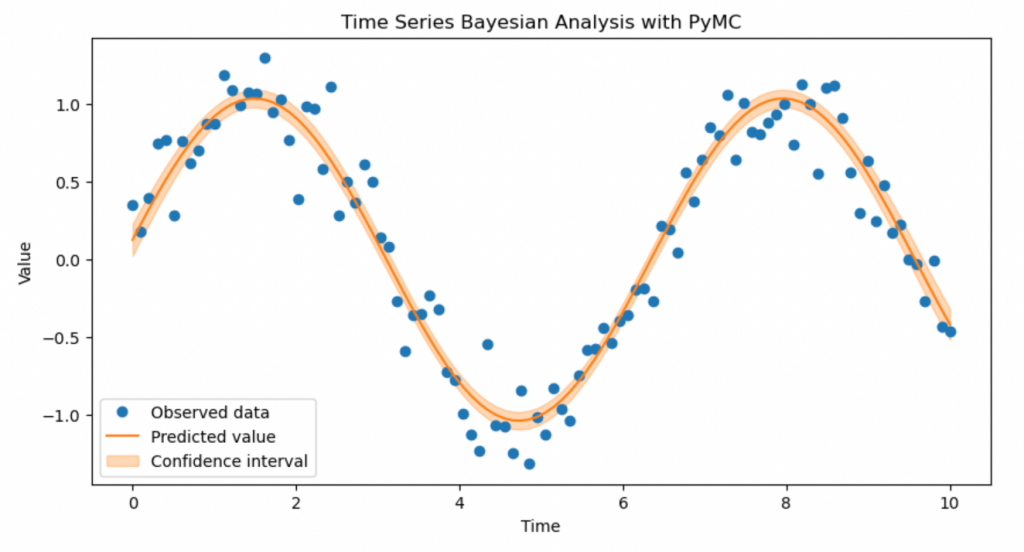

许多领域使用观测值作为时间的函数(或者,更罕见的是,空间变量)。 在最简单的情况下,这些观察结果会产生一条明确的曲线。 事实上,从地球科学到人文学科,观测或多或少都会出现不稳定的情况。 因此,对这些观察结果的解释存在一定的不确定性,这可能反映在使用概率来表示它们上。

随机过程概括了概率中使用的随机变量的概念。 它被定义为与所有值 t ∈ T(通常是时间)相关的一系列随机变量 X(t)。

从统计的角度来看,我们将所有可用的观测值x(t)视为过程的实现,这会带来一定的困难。 第一个问题涉及以下事实:构建过程的持续时间通常是无限的,而实现则涵盖有限的持续时间。 因此,不可能完美地再现现实。 第二个更严重的困难是,与随机变量问题不同,有关过程的可用信息通常被简化为单个实现。

A stochastic or stochastic process can be defined as a collection of random variables indexed by some mathematical set, which means that each random variable in the stochastic process is uniquely related to some element in the set. Historically, the index set was some subset of the real lines, such as the natural numbers, which gave the index set a temporal interpretation. For example, the state space can be integers, solid lines, or… n-dimensional Euclidean space]. An increment is the amount of change of a random process between two exponential values, usually interpreted as two points in time. Due to randomness, a random process can have many outcomes, and a single outcome of a random process is called a sample function or realization.

Many fields use observations as functions of time (or, more rarely, spatial variables). In the simplest case, these observations yield a well-defined curve. In fact, from the earth sciences to the humanities, observations are more or less unstable. Therefore, there is a certain uncertainty in the interpretation of these observations, which may be reflected in the use of probabilities to express them.

Stochastic processes generalize the concept of random variables used in probability. It is defined as a sequence of random variables X(t) related to all values t ∈ T (usually time).

From a statistical perspective, we treat all available observations x(t) as realizations of the process, which creates certain difficulties. The first problem concerns the fact that the duration of the build process is usually infinite, whereas the implementation covers a finite duration. Therefore, it is impossible to perfectly reproduce reality. A second, more serious difficulty is that, unlike random variable problems, the available information about the process is often reduced to a single realization.

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

随机过程Stochastic process的重难点

什么是伯努利过程Bernoulli process?

每个单一随机变量 $X_{mathrm{i}}$ 只能提供两种结果:成功 (1) 或失败 $(0)$,概率分别为 $p$ 和 $q=1$ – $p$ :

$p$ e $q=1$ – $p$ :

$$

\begin{aligned}

& P\left(X_i=1\right)=p ; \

& P\left(X_i=0\right)=q=1-p .

\end{aligned}

$$

遵循二项式定律 $B(n,p)$,概率为

$$

P\left(S_n=k\right)=\left(\begin{array}{l}

n \

k

\end{array}\right) p^k q^{n-k}

$$

等于$k$成功和$n-k$失败的序列数乘以其中任何一个出现的概率。

获得一次成功所需的投掷次数由随机变量 $N$ 给出,该随机变量遵循几何比率定律 $q$。

$$

P(N=n)=P\left(S_{n-1}=0\right) \cdot P\left(X_n=1\right)=q^n \frac{p}{q} .

$$

更一般地说,获得 $k$ 成功所需的投掷次数由随机变量 $N_k$ 给出,其规律为

$P\left(N_k=n\right)=P\left(S_{n-1}=k-1\right) \cdot P\left(X_n=1\right)=\left(\begin{array}{c}n-1 \ k-1\end{array}\right) p^k q^{n-k}$

特别是,失败的次数由帕斯卡定律(或负二项式)的随机变量 $P_k=N_k-n$ $P(p, k)$ 给出

$$

P\left(P_k=r\right)=P\left(N_k=r+k\right)=\left(\begin{array}{c}

r+k-1 \

k-1

\end{array}\right) p^k q^r=(-1)^k\left(\begin{array}{c}

-r \

k

\end{array}\right) p^k q^r

$$

Applicazioni

[ modifica | modifica wikitesto ]

什么是随机漫步Random walk?

在一维随机游走中,研究了被约束在两个允许方向上沿直线移动的点粒子的运动。 每次移动时,它都会(随机)向右移动一步(以固定概率 $p$)或以概率 $1-p$ 向左移动,并且每一步长度相等且彼此独立。 我们的目标是计算在 $\mathrm{N}$ 运动后粒子将返回(如果它返回的话!)到起点的概率。 我们引入以下随机变量 $X(N)$,它提供 $N$ 运动后向左迈出的步数; 特别是,它模拟了经过适当操纵的硬币投掷 $N$ 后出现的正面的数量。 显然这是一个二项式分布的离散随机变量。 我们还注意到,事件“返回原点”相当于在 $2 N$ 总步数中向左精确走了 $N$ 步; 因此,所寻求的概率相当于 $P{X=N}$,其中二项式 $X$ 的参数为 $n=2 N, k=N, p$ 因此

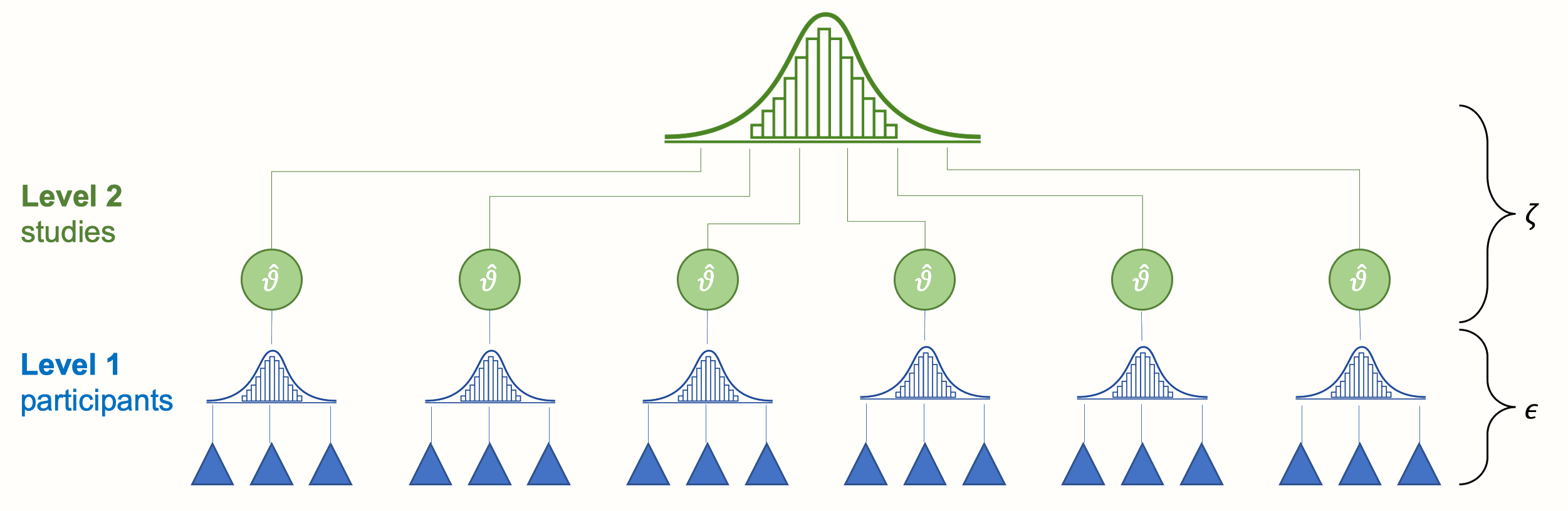

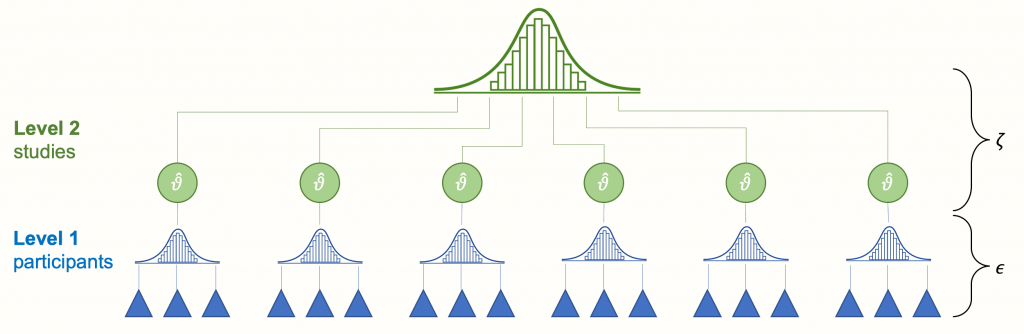

什么是因子分析Factor analysis?

该模型试图用一组 $k$ 的公共因子 $\left(f_{i, j}\right)$ 来解释 $n$ 个体中每个个体的 $p$ 观察值,其中每个单位的因子数量少于每个单位的观察值 $(k<p)$。每个个体都有自己的 $k$ 共同因子,这些因子通过因子载荷矩阵 $(left(L)(in\mathbb{R}^{p\times k}\right)$与观测值相关,对于单个观测值,根据

$$

P{X=N}=\frac{(2 N) !}{N !(2 N-N) !} p^N(1-p)^N=\left(\begin{array}{c}

2 N \

N

\end{array}\right)\left(p-p^2\right)^N .

$$

例如,如果粒子在每一步 $(p=1 / 2)$ 向左或向右移动的机会均等,则在 $2 N$ 步骤后返回原点的概率为

$$

P{X=N}=\left(\begin{array}{c}

2 N \

N

\end{array}\right)\left(\frac{1}{2}\right)^{2 N} \approx \frac{1}{\sqrt{N \pi}},

$$我们对足够大的 $N$ 应用斯特林近似,

$$

N ! \sim \sqrt{2 \pi N}\left(\frac{N}{e}\right)^N .

$$现在记住随机变量的期望值由下式给出

$$

E[X]=\sum_{n=0}^{\infty} n P(n)

$$

随机过程Stochastic process的相关课后作业范例

这是一篇关于多元统计分析Multivariate Statistical Analysis的作业

Show that in successive tosses of a fair die indefinitely, the probability of obtaining no 6 is 0 .

Solution: For $n \geq 1$, let $E_n$ be the event of at least one 6 in the first $n$ tosses of the die. Clearly,

$$

E_1 \subseteq E_2 \subseteq \cdots \subseteq E_n \subseteq E_{n+1} \subseteq \cdots .

$$

Therefore, $E_n$ ‘s form an increasing sequence of events. Note that $\lim {n \rightarrow \infty} E_n=\bigcup{i=1}^{\infty} E_i$ is the event that in successive tosses of the die indefinitely, eventually a 6 will occur. By the Continuity of the Probability Function (Theorem 1.8), we have

$$

P\left(\lim {n \rightarrow \infty} E_n\right)=\lim {n \rightarrow \infty} P\left(E_n\right)=\lim {n \rightarrow \infty}\left[1-\left(\frac{5}{6}\right)^n\right]=1-\lim {n \rightarrow \infty}\left(\frac{5}{6}\right)^n=1-0=1 .

$$

This shows that, with probability 1 , eventually a 6 will occur. Therefore, the probability of no 6 ever is 0 .

通过对随机过程Stochastic process各方面的介绍,想必您对这门课有了初步的认识。如果你仍然不确定或对这方面感到困难,你仍然可以依靠我们的代写和辅导服务。我们拥有各个领域、具有丰富经验的专家。他们将保证你的 essay、assignment或者作业都完全符合要求、100%原创、无抄袭、并一定能获得高分。需要如何学术帮助的话,随时联系我们的客服。