如果你也在 怎样代写博弈论Game theory 这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。博弈论Game theory在20世纪50年代被许多学者广泛地发展。它在20世纪70年代被明确地应用于进化论,尽管类似的发展至少可以追溯到20世纪30年代。博弈论已被广泛认为是许多领域的重要工具。截至2020年,随着诺贝尔经济学纪念奖被授予博弈理论家保罗-米尔格伦和罗伯特-B-威尔逊,已有15位博弈理论家获得了诺贝尔经济学奖。约翰-梅纳德-史密斯因其对进化博弈论的应用而被授予克拉福德奖。

博弈论Game theory是对理性主体之间战略互动的数学模型的研究。它在社会科学的所有领域,以及逻辑学、系统科学和计算机科学中都有应用。最初,它针对的是两人的零和博弈,其中每个参与者的收益或损失都与其他参与者的收益或损失完全平衡。在21世纪,博弈论适用于广泛的行为关系;它现在是人类、动物以及计算机的逻辑决策科学的一个总称。

statistics-lab™ 为您的留学生涯保驾护航 在代写博弈论Game Theory方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写博弈论Game Theory代写方面经验极为丰富,各种代写博弈论Game Theory相关的作业也就用不着说。

经济代写|博弈论代写Game Theory代考|Backward Induction and Subgame Perfection

Io verify that a strategy profile of a multi-stage game with observed actions is subgame perfect, it suffices to check whether there are any historics $h^t$ where some player $i$ can gain by deviating from the actions prescribed by $s_i$ at $h^t$ and conforming to $s_i$ thereafter. Since this “one-stagc-deviation principle” is essentially the principle of optimality of dynamic programming, which is based on backward induction, it helps illustrate how sub game perfection extends the idea of backward induction. We split the observation into two parts, corresponding to finite- and infinite-horizon games; some readers may prefer to read the first proof and take the second one on faith, although both are quite simple. For notational simplicity, we state the principle for pure strategies; the mixcd-strategy counterpart is straightforward.

Theorem 4.1 (one-stage-deviation principle for finite-horizon games) In a finite multi-stage game with observed actions, strategy profile $s$ is subgame perfect if and only if it satisfies the one-stage-deviation condition that no player $i$ can gain by deviating from $s$ in a single stage and conforming to $s$ thereafter. More precisely, profile $s$ is subgame perfect if and only if there is no player $i$ and no strategy $\hat{s}i$ that agrees with $s_i$ except at a single $t$ and $h^t$, and such that $\hat{s}_i$ is a better response to $s{-i}$ than $s_i$ conditional on history $h^t$ being reached. ${ }^1$

Proof The necessity of the one-stage-deviation condition (“only if”) follows from the definition of subgame perfection. (Note that the one-stagedeviation condition is not necessary for Nash equilibrium, as a Nashequilibrium profile may prescribe suboptimal responses at histories that do not occur when the profile is played.) To see that the one-stage-deviation condition is sufficient, suppose to the contrary that profile $s$ satisfies the condition but is not subgame perfect. Then there is a stage $t$ and a history $h^t$ such that some player $i$ has a strategy $\hat{s}i$ that is a better response to $s{-i}$ than $s_i$ is in the subgame starting at $h^t$. Let $t$ be the largest $t^{\prime}$ such that, for some $h^{\prime}, \hat{s}_i\left(h^{\prime}\right) \neq s_i\left(h^{\prime}\right)$. The one-stage-deviation condition implies $\hat{t}>t$, and since the game is finite, $\hat{t}$ is finite as well. Now consider an alternative strategy $\tilde{s}_i$ that agrees with $\hat{s}_i$ at all $t<\hat{t}$ and follows $s_i$ from stage $\hat{t}$ on. Since $\hat{s}_i$ agrees with $s_i$ from $\hat{t}+1$ on, the one-stage-deviation condition implies that $\hat{s}_i$ is as good a response as $\hat{s}_i$ in every subgame starting at $\hat{t}$, so $\tilde{s}_i$ is as good a response as $\hat{S}_i$ in the subgame starting at $t$ with history $h^t$. If $\hat{t}=t+1$, then $\tilde{s}_i=s_i$, which contradicts the hypothesis that $\hat{s}_i$ improves on $s_i$. If $\hat{t}>t+1$, we construct a strategy that agrees with $\hat{s}_i$ until $\hat{t}-2$. and argue that it is as good a response as $\hat{s}_i$, and so on: The alleged sequence of improving deviations unravels from its endpoint.

经济代写|博弈论代写Game Theory代考|The Repeated Prisoner’s Dilemma

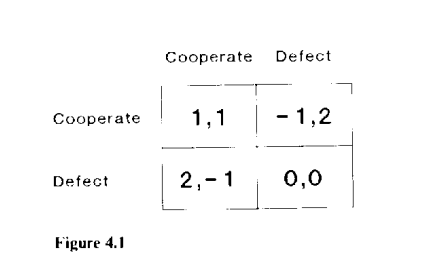

This section discusses the way in which repeated play introduces new equilibria by allowing players to condition their actions on the way their opponents played in previous periods. We begin with what is probably the best-known example of a repeated game: the celebrated “prisoner’s dilemma,” whose static version we discussed in chapter 1 . Suppose that the per-period payoffs depend only on current actions $\left(g_i\left(a^t\right)\right)$ and are as shown in figure 4.1 , and suppose that the players discount future payoffs with a common discount factor $\delta$. We will wish to consider how the equilibrium payoffs vary with the horizon $T$. To make the payoffs for different horizons comparable, we normalize to express them all in the units used for the per-period payoffs, so that the utility of a sequence $\left{a^0, \ldots, a^T\right}$ is

$$

\begin{gathered}

1-\delta \

1 \

\delta^{T+1}

\end{gathered} \sum_{i=0}^T \delta^t y_i\left(a^t\right) .

$$

This is called the “average discounted payoff.” Since the normalization is simply a rescaling, the normalized and present-value formulations represent the same preferences. The normalized versions makc it easier to see what happens as the discount factor and the time horizon vary, by measuring all payoffs in terms of per-period averages. For example, the present value of a flow of 1 per period from date 0 to date $T$ is $\left(1-\delta^{T+1}\right) /(1-\delta)$; the average discounted value of this flow is simply 1 .

We begin with the case in which the game is played only once. Then cooperating is strongly dominated, and the unique equilibrium is for both players to defect. If the game is repeated a finite number of times, subgame perfection requires both players to defect in the last period, and backward induction implies that the unique subgame-perfect equilibrium is for both players to defect in every period. $^2$

博弈论代考

经济代写|博弈论代写Game Theory代考|Backward Induction and Subgame Perfection

为了验证带有观察到的行动的多阶段游戏的策略配置文件是子游戏完美的,它足以检查是否存在任何历史$h^t$,其中一些玩家$i$可以通过在$h^t$偏离$s_i$规定的行动并遵循$s_i$而获得收益。由于这种“一阶段偏差原则”本质上是基于逆向归纳法的动态规划的最优性原则,因此它有助于说明子博弈完美性如何扩展逆向归纳法的思想。我们将观察结果分成两部分,分别对应于有限视界和无限视界游戏;有些读者可能更喜欢读第一个证明,而相信第二个证明,尽管这两个证明都很简单。为了简化符号,我们陈述了纯策略的原则;混合策略的对应物很简单。

定理4.1(有限视界博弈的一阶段偏差原理)在一个有限的多阶段博弈中,当且仅当策略剖面$s$满足一阶段偏差条件,即任何参与者$i$都不能在某一阶段偏离$s$而随后服从$s$而获得收益。更准确地说,配置文件$s$是子博弈完美的,当且仅当没有玩家$i$,也没有策略$\hat{s}i$与$s_i$一致,除了$t$和$h^t$,并且$\hat{s}_i$是$s{-i}$比$s_i$更好的响应,条件是$h^t$已经到达。 ${ }^1$

单阶段偏差条件(“只有当”)的必要性从子博弈完美性的定义出发。(请注意,一级偏差条件对于纳什均衡来说是不必要的,因为纳什均衡剖面可能会规定在历史上的次优响应,而这些响应在剖面播放时不会发生。)为了证明一级偏差条件是充分的,假设曲线相反 $s$ 满足条件,但不是完美的子博弈。然后是一个舞台 $t$ 还有一段历史 $h^t$ 这样一些玩家 $i$ 有策略 $\hat{s}i$ 这是一个更好的回应 $s{-i}$ 比 $s_i$ 是在子游戏开始的时候 $h^t$. 让 $t$ 做最大的 $t^{\prime}$ 这样,对一些人来说 $h^{\prime}, \hat{s}_i\left(h^{\prime}\right) \neq s_i\left(h^{\prime}\right)$. 一级偏差条件表示 $\hat{t}>t$,由于这个博弈是有限的, $\hat{t}$ 也是有限的。现在考虑另一种策略 $\tilde{s}_i$ 这与 $\hat{s}_i$ 一点也不 $t<\hat{t}$ 然后是 $s_i$ 舞台上 $\hat{t}$ 继续。自从 $\hat{s}_i$ 同意 $s_i$ 从 $\hat{t}+1$ On,一级偏差条件意味着 $\hat{s}_i$ 是一个好的回应吗 $\hat{s}_i$ 在每一个子游戏中 $\hat{t}$所以 $\tilde{s}_i$ 是一个好的回应吗 $\hat{S}_i$ 在子游戏开始于 $t$ 有历史 $h^t$. 如果 $\hat{t}=t+1$那么, $\tilde{s}_i=s_i$,这与假设相矛盾 $\hat{s}_i$ 改进于 $s_i$. 如果 $\hat{t}>t+1$,我们就会制定一个与之一致的策略 $\hat{s}_i$ 直到 $\hat{t}-2$. 并认为这是一个很好的回应 $\hat{s}_i$等等:所谓的改进偏差序列从它的端点开始解开。

经济代写|博弈论代写Game Theory代考|The Repeated Prisoner’s Dilemma

这一部分讨论了重复游戏如何通过允许玩家根据对手在前一阶段的行为来调整自己的行为,从而引入新的平衡。我们从重复博弈中最著名的例子开始:著名的“囚徒困境”,我们在第一章中讨论过它的静态版本。假设每个时期的收益只取决于当前的行为$\left(g_i\left(a^t\right)\right)$,如图4.1所示,并假设参与者用一个共同的贴现因子$\delta$来贴现未来的收益。我们希望考虑均衡收益如何随视界变化$T$。为了使不同层次的收益具有可比性,我们将它们归一化,用每个周期收益的单位来表示它们,因此序列$\left{a^0, \ldots, a^T\right}$的效用是

$$

\begin{gathered}

1-\delta \

1 \

\delta^{T+1}

\end{gathered} \sum_{i=0}^T \delta^t y_i\left(a^t\right) .

$$

这被称为“平均贴现收益”。由于归一化只是简单的重新缩放,因此归一化和现值公式表示相同的偏好。标准化的版本可以更容易地看到贴现因子和时间范围的变化,通过衡量每个时期的平均值的所有收益。例如,从日期0到日期$T$的每个期间1的流量的现值为$\left(1-\delta^{T+1}\right) /(1-\delta)$;这个流的平均折现值是1。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。