如果你也在 怎样代写信息论information theory这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

信息论是对数字信息的量化、存储和通信的科学研究。该领域从根本上是由哈里-奈奎斯特和拉尔夫-哈特利在20世纪20年代以及克劳德-香农在20世纪40年代的作品所确立的。

statistics-lab™ 为您的留学生涯保驾护航 在代写信息论information theory方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写信息论information theory代写方面经验极为丰富,各种代写信息论information theory相关的作业也就用不着说。

我们提供的信息论information theory及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

数学代写|信息论代写information theory代考|Definition of information and entropy in the absence of noise

In modern science, engineering and public life, a big role is played by information and operations associated with it: information reception, information transmission, information processing, storing information and so on. The significance of information has seemingly outgrown the significance of the other important factor, which used to play a dominant role in the previous century, namely, energy.

In the future, in view of a complexification of science, engineering, economics and other fields, the significance of correct control in these areas will grow and, therefore, the importance of information will increase as well.

What is information? Is a theory of information possible? Are there any general laws for information independent of its content that can be quite diverse? Answers to these questions are far from obvious. Information appears to be a more difficult concept to formalize than, say, energy, which has a certain, long established place in physics.

There are two sides of information: quantitative and qualitative. Sometimes it is the total amount of information that is important, while other times it is its quality, its specific content. Besides, a transformation of information from one format into another is technically a more difficult problem than, say, transformation of energy from one form into another. All this complicates the development of information theory and its usage. It is quite possible that the general information theory will not bring any benefit to some practical problems, and they have to be tackled by independent engineering methods.

Nevertheless, general information theoory exists, and so dō standärd situations and problems, in which the laws of general information theory play the main role. Therefore, information theory is important from a practical standpoint, as well as in fundamental science, philosophy and expanding the horizons of a researcher.

From this introduction one can gauge how difficult it was to discover the laws of information theory. In this regard, the most important milestone was the work of Claude Shannon $[44,45]$ published in 1948-1949 (the respective English originals are $[38,39]$ ). His formulation of the problem and results were both perceived as a surprise. However, on closer investigation one can see that the new theory extends and develops former ideas, specifically, the ideas of statistical thermodynamics due to Boltzmann. The deep mathematical similarities between these two directions are not accidental. It is evidenced in the use of the same formulae (for instance, for entropy of a discrete random variable). Besides that, a logarithmic measure for the amount of information, which is fundamental in Shannon’s theory, was proposed for problems of communication as early as 1928 in the work of R. Hartley [19] (the English original is [18]).

In the present chapter, we introduce the logarithmic measure of the amount of information and state a number of important properties of information, which follow from that measure, such as the additivity property.

The notion of the amount of information is closely related to the notion of entropy, which is a measure of uncertainty. Acquisition of information is accompanied by a decrease in uncertainty, so that the amount of information can be measured by the amount of uncertainty or entropy that has disappeared.

In the case of a discrete message, i.e. a discrete random variable, entropy is defined by the Boltzmann formula

$$

H_{\xi}=-\sum_{\xi} P(\xi) \ln P(\xi),

$$

where $\xi$ is a random variable, and $P(\xi)$ is its probability distribution.

数学代写|信息论代写information theory代考|Definition of entropy in the case of equiprobable outcomes

Suppose we have $M$ equiprobable outcomes of an experiment. For example, when we roll a standard die, $M=6$. Of course, we cannot always perform the formalization of conditions so easily and accurately as in the case of a die. We assume though that the formalization has been performed and, indeed, one of $M$ outcomes is realized, and they are equivalent in probabilistic terms. Then there is a priori uncertainty directly connected with $M$ (i.e. the greater the $M$ is, the higher the uncertainty is). The quantity measuring the above uncertainty is called entropy and is denoted by $H:$

$$

H=f(M),

$$

where $f(\cdot)$ is some increasing non-negative function defined at least for natural numbers.

When rolling a dice and observing the outcome number, we obtain information whose amount is denoted by $I$. After that (i.e. a posteriori) there is no uncertainty left: the a posteriori number of outcomes is $M=1$ and we must have $H_{\mathrm{ps}}=f(1)=0$. It is natural to measure the amount of information received by the value of disappeared uncertainty:

$$

I=H_{\mathrm{pr}}-H_{\mathrm{ps}} .

$$

Here, the subscript ‘pr’ means ‘a priori’, whereas ‘ps’ means ‘a posteriori’.

We see that the amount of received information $I$ coincides with the initial entropy. In other cases (in particular, for formula (1.2.3) given below) a message having entropy $H$ can also transmit the amount of information $I$ equal to $H$.

In order to determine the form of function $f(\cdot)$ in (1.1.1) we employ very natural additivity principle. In the case of a die it reads: the entropy of two throws of a die is twice as large as the entropy of one throw, the entropy of three throws of a die is three times as large as the entropy of one throw, etc. Applying the additivity principle to other cases means that the entropy of several independent systems is equal to the sum of the entropies of individual systems. However, the number $M$ of outcomes for a complex system is equal to the product of the numbers $m$ of outcomes for each one of the ‘simple’ (relative to the total system) subsystems. For two throws of dice, the number of various pairs $\left(\xi_{1}, \xi_{2}\right)$ (where $\xi_{1}$ and $\xi_{2}$ both take one out of six values) equals to $36=6^{2}$. Generally, for $n$ throws the number of equivalent outcomes is $6^{n}$. Applying formula (1.1.1) for this number, we obtain entropy $f\left(6^{n}\right)$. According to the additivity principle, we find that

$$

f\left(6^{n}\right)=n f(6)

$$

数学代写|信息论代写information theory代考|Entropy and its properties in the case of non-equiprobable outcomes

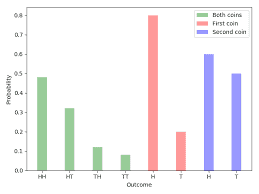

- Suppose now the probabilities of different outcomes are unequal. If, as earlier, the number of outcomes equals to $M$, then we can consider a random variable $\xi$, which takes one of $M$ values. Considering an index of the corresponding outcome as $\xi$, we obtain that those values are nothing else but $1, \ldots, M$. Probabilities $P(\xi)$ of those values are non-negative and satisfy the normalization constraint: $\sum_{\xi} P(\xi)=1$.

If we formally apply equality (1.1.8) to this case, then each $\xi$ should have its own entropy

$$

H(\xi)=-\ln P(\xi) .

$$

Thus, we attribute a certain value of entropy to each realization of the variable $\xi$. Since $\xi$ is a random variable, we can also regard this entropy as a random variable.

As in Section 1.1, the a posteriori entropy, which remains after the realization of $\xi$ becomes known, is equal to zero. That is why the information we obtain once the realization is known is numerically equal to the initial entropy

$$

I(\xi)=H(\xi)=-\ln P(\xi)

$$

Similar to entropy $H(\xi)$, information $I$ depends on the actual realization (on the value of $\xi$ ), i.e., it is a random variable. One can see from the latter formula that information and entropy are both large when a posteriori probability of the given realization is small and vice versa. This observation is quite consistent with intuitive ideas.

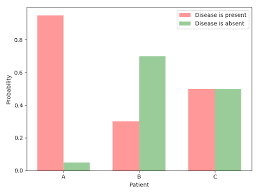

Example 1.1. Suppose we would like to know whether a certain student has passed an exam or not. Let the probabilities of these two events be

$$

P(\text { pass })=7 / 8, \quad P(\text { fail })=1 / 8

$$

One can see from these probabilities that the student is quite strong. If we were informed that the student had passed the exam, then we could say: ‘Your message has not given me a lot of information. I have already expected that the student passed the exam’. According to formula (1.2.2) the information of this message is quantitatively equal to

$$

I(\text { pass })=\log {2}(8 / 7)=0.193 \text { bits. } $$ If we were informed that the student had failed, then we would say ‘Really?’ and would feel that we have improved our knowledge to a greater extent. The amount of information of such a message is equal to $$ I(\text { fail })=\log {2}(8)=3 \text { bits. }

$$

信息论代考

数学代写|信息论代写information theory代考|Definition of information and entropy in the absence of noise

在现代科学、工程和公共生活中,信息及其相关操作发挥着重要作用:信息接收、信息传输、信息处理、信息存储等。 信息的重要性似乎已经超过了另一个重要因溸的重要性,后者在上个世纪曾占据主导地位,即能源。

末来,随着科学、工程、经济等领域的笪杂化,这些领域的正确控制的意义将越来越大,因此信息的重要性也将越来越 大o

什么是信息? 信息理论可能吗? 是否有任何独立于其内容的信息的一般规律,可以是非常多样化的? 这些问题的答案远 非显而易见。与能量相比,信息似乎是一个更难形式化的概念,能量在物理学中具有一定的、长期确立的地位。

信息有两个方面:定量和定性。有时重要的是信息的总量,而有时则是它的质量,它的具体内容。此外,从一种形式到 另一种形式的信息转换在技术上比从一种形式到另一种形式的能量转换更困难。所有这些都使信息论的发展及其使用变 得复杂。一般信息论很可能对一些实际问题没有任何好处,必须通过独立的工程方法来解决。

但是,一般信息论是存在的,标准的情况和问题也是存在的,其中一般信息论的规律起主要作用。因此,从实践的角度 来看,信息论以及在基础科学、哲学和扩展研究人员的视野方面都很重要。

从这个介绍可以看出发现信息论定律有多么困难。在这方面,最重要的里程碑是克劳德自农的工作 $[44,45]$ 出版于 19481949 年(各自的英文原件是 $[38,39]$ )。他对问题的表述和结果都被认为是一个掠喜。然而,通过更深入的研究,我们] 可以看到新理论扩展和发展了以前的思想,特别是玻尔兹曼的统计热力学思想。䢒两个方向之间在数学上的深刻相似性 并非偶然。使用相同的公式就证明了这一点(例如,对于离散随机六量的熵)。除此之外,早在 1928 年,R. Hartley [19] (英文原版为 [18]) 就提出了用于解决通信问题的信息量的对数度量,这是香农理论中的基础。

在本章中,我们介绍了信息量的对数度量,并说明了信息的一些重要属性,这些属性是从该度量得出的,例如可加性。

信息量的概念与熵的概念密切相关,熵是不确定性的度量。信息的获取伴随着不确定性的减少,因此信息量可以通过已 经消失的不确定性或熵的量来衡量。

在离散消息的情况下,即禽散随机变量,熵由玻尔兹曼公式定义

$$

H_{\xi}=-\sum_{\xi} P(\xi) \ln P(\xi)

$$

在哪里 $\xi$ 是一个随机变量,并且 $P(\xi)$ 是它的概率分布。

数学代写|信息论代写information theory代考|Definition of entropy in the case of equiprobable outcomes

假设我们有 $M$ 实验的等概率结果。例如,当我们烪出一个标准㱿子时, $M=6$. 当然,我们不能总是像在骰子的情况下 那样容易和准确地执行条件的形式化。我们假设虽然形式化已经执行,并且实际上,其中之一 $M$ 结果是实现的,并且它 们在概率方面是等价的。那么有一个先验的不确定性直接与 $M$ (即越大 $M$ 是,不确定性越高) 。测量上述不确定性的量 称为熵,表示为 $H$ :

$$

H=f(M),

$$

在哪里 $f(\cdot)$ 是至少为自然数定义的一些递增的非负函数。

当掷骰子并观崇结果数时,我们获得的信息量表示为 $I$. 在那之后(即后验),就没有不确定性了:结果的后验数量是 $M=1$ 我们必须有 $H_{\mathrm{ps}}=f(1)=0$. 通过消失的不确定性的值来衡量接收到的信息量是很自然的:

$$

I=H_{\mathrm{pr}}-H_{\mathrm{ps}} .

$$

这里,下标”pr”表示”先验”,而“ps”表示”后验”。

我们看到接收到的信息量 $I$ 与初始熵一致。在其他情况下(特别是对于下面给出的公式 (1.2.3) )具有熵的消自 $H$ 还可 以传递信息量 $I$ 等于 $H$.

为了确定函数的形式 $f(\cdot)$ 在 (1.1.1) 中,我们采用了非常自然的可加性原理。在䁊子的情况下,它读作:两次掷骰子的 熵是一次掷骰子的熵的两倍,三次掷猒子的熵是一次掷刕子的熵的三倍,等等。将可加性原理应用于其他情况意味着几 个独立系统的熵等于各个系统的熵之和。然而,数 $M$ 复杂系统的结果等于数字的乘积 $m$ 每个”简单”(相对于整个系统) 子系统的结果。对于两次掷骰子,各种对的数量 $\left(\xi_{1}, \xi_{2}\right)$ (在哪里 $\xi_{1}$ 和 $\xi_{2}$ 都取六个值中的一个) 等于 $36=6^{2}$. 一般来 说,对于 $n$ 抛出等效结果的数量是 $6^{n}$. 对这个数应用公式 (1.1.1),我们得到熵 $f\left(6^{n}\right)$. 根据可加性原理,我们发现

$$

f\left(6^{n}\right)=n f(6)

$$

数学代写|信息论代写information theory代考|Entropy and its properties in the case of non-equiprobable outcomes

- 假设现在不同结果的概率不相等。如果如前所述,结果的数量等于 $M$ ,那么我们可以考虑一个随机变量 $\xi$ ,它需要 一个 $M$ 价值观。将相应结果的索引视为 $\xi$ ,我们得到这些值只不过是 $1, \ldots, M$. 概率 $P(\xi)$ 这些值中的一个是非负 的并且满足规范化约束: $\sum_{\xi} P(\xi)=1$.

如果我们正式将等式 (1.1.8) 应用于这种情况,那么每个 $\xi$ 应该有自己的熵

$$

H(\xi)=-\ln P(\xi) .

$$

因此,我们将某个熵值赋予变量的每个实现 $\xi$. 自从 $\xi$ 是一个随机变量,我们也可以把这个熵看作一个随机变量。 与第 $1.1$ 节一样,后验樀在实现 $\xi$ 变得已知,等于零。这就是为什么我们在实现已知后获得的信息在数值上等于初始樀

$$

I(\xi)=H(\xi)=-\ln P(\xi)

$$

类似于樀 $H(\xi)$ ,信自 $I$ 取决于实际实现(在价值 $\xi$ ,即它是一个随机变量。从后一个公式可以看出,当给定实现的后验 概率很小时,信息和樀都很大,反之亦然。这种观眎与直觉的想法是相当一致的。

例 1.1。假设我们想知道某个学生是否通过了考试。让这两个事件的概率为

$$

P(\text { pass })=7 / 8, \quad P(\text { fail })=1 / 8

$$

从这些概率可以看出,学生的实力相当强。如果我们被告知学生通过了考试,那么我们可以说:’你的消自没有给我很多 信息。我已经预料到学生会通过考试。”根据公式 (1.2.2),这条消息的信息量等于

$$

I(\text { pass })=\log 2(8 / 7)=0.193 \text { bits. }

$$

如果殘们被告知学生失败了,那么我们会说“真的吗? “并且会觉得我们在更大程度上提高了我们的知识。这样一条消息 的信息量等于

$$

I(\text { fail })=\log 2(8)=3 \text { bits. }

$$

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。