如果你也在 怎样代写计算机视觉Computer Vision这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

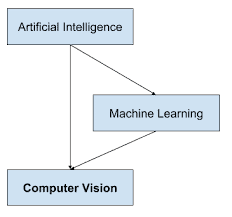

计算机视觉是人工智能(AI)的一个领域,使计算机和系统能够从数字图像、视频和其他视觉输入中获得有意义的信息–并根据这些信息采取行动或提出建议。

statistics-lab™ 为您的留学生涯保驾护航 在代写计算机视觉Computer Vision方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写计算机视觉Computer Vision方面经验极为丰富,各种代写计算机视觉Computer Vision相关的作业也就用不着说。

我们提供的计算机视觉Computer Vision及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等楖率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

计算机代写|计算机视觉代写Computer Vision代考|What is computer vision

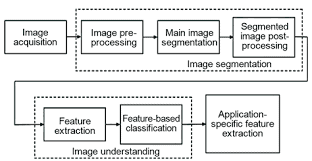

As humans, we perceive the three-dimensional structure of the world around us with apparent ease. Think of how vivid the three-dimensional percept is when you look at a vase of flowers sitting on the table next to you. You can tell the shape and translucency of each petal through the subtle patterns of light and shading that play across its surface and effortlessly segment each flower from the background of the scene (Figure 1.1). Looking at a framed group portrait, you can easily count and name all of the people in the picture and even guess at their emotions from their facial expressions (Figure 1.2a). Perceptual psychologists have spent decades trying to understand how the visual system works and, even though they can devise optical illusions ${ }^1$ to tease apart some of its principles (Figure 1.3), a complete solution to this puzzle remains elusive (Marr 1982; Wandell 1995; Palmer 1999; Livingstone 2008; Frisby and Stone 2010).

Researchers in computer vision have been developing, in parallel, mathematical techniques for recovering the three-dimensional shape and appearance of objects in imagery. Here, the progress in the last two decades has been rapid. We now have reliable techniques for accurately computing a 3D model of an environment from thousands of partially overlapping photographs (Figure 1.2c). Given a large enough set of views of a particular object or façade, we can create accurate dense 3D surface models using stereo matching (Figure 1.2d). We can even, with moderate success, delineate most of the people and objects in a photograph (Figure 1.2a). However, despite all of these advances, the dream of having a computer explain an image at the same level of detail and causality as a two-year old remains elusive.

Why is vision so difficult? In part, it is because it is an inverse problem, in which we seek to recover some unknowns given insufficient information to fully specify the solution. We must therefore resort to physics-based and probabilistic models, or machine learning from large sets of examples, to disambiguate between potential solutions. However, modeling the visual world in all of its rich complexity is far more difficult than, say, modeling the vocal tract that produces spoken sounds.

The forward models that we use in computer vision are usually developed in physics (radiometry, optics, and sensor design) and in computer graphics. Both of these fields model how objects move and animate, how light reflects off their surfaces, is scattered by the atmosphere, refracted through camera lenses (or human eyes), and finally projected onto a flat (or curved) image plane. While computer graphics are not yet perfect, in many domains, such as rendering a still scene composed of everyday objects or animating extinct creatures such as dinosaurs, the illusion of reality is essentially there.

In computer vision, we are trying to do the inverse, i.e., to describe the world that we see in one or more images and to reconstruct its properties, such as shape, illumination, and color distributions. It is amazing that humans and animals do this so effortlessly, while computer vision algorithms are so error prone. People who have not worked in the field often underestimate the difficulty of the problem. This misperception that vision should be easy dates back to the early days of artificial intelligence (see Section 1.2), when it was initially believed that the cognitive (logic proving and planning) parts of intelligence were intrinsically more difficult than the perceptual components (Boden 2006).

计算机代写|计算机视觉代写Computer Vision代考|A brief history

In this section, I provide a brief personal synopsis of the main developments in computer vision over the last fifty years (Figure 1.6) with a focus on advances I find personally interesting and that have stood the test of time. Readers not interested in the provenance of various ideas and the evolution of this field should skip ahead to the book overview in Section 1.3.

1970s. When computer vision first started out in the early $1970 \mathrm{~s}$, it was viewed as the visual perception component of an ambitious agenda to mimic human intelligence and to endow robots with intelligent behavior. At the time, it was believed by some of the early pioneers of artificial intelligence and robotics (at places such as MIT, Stanford, and CMU) that solving the “visual input” problem would be an easy step along the path to solving more difficult problems such as higher-level reasoning and planning. According to one well-known story, in 1966, Marvin Minsky at MIT asked his undergraduate student Gerald Jay Sussman to “spend the summer linking a camera to a computer and getting the computer to describe what it saw” (Boden 2006, p. 781). ${ }^5$ We now know that the problem is slightly more difficult than that. ${ }^6$

What distinguished computer vision from the already existing field of digital image processing (Rosenfeld and Pfaltz 1966; Rosenfeld and Kak 1976) was a desire to recover the three-dimensional

structure of the world from images and to use this as a stepping stone towards full scene understanding. Winston (1975) and Hanson and Riseman (1978) provide two nice collections of classic papers from this early period.

Early attempts at scene understanding involved extracting edges and then inferring the 3D structure of an object or a “blocks world” from the topological structure of the 2D lines (Roberts 1965). Several line labeling algorithms (Figure 1.7a) were developed at that time (Huffman 1971; Clowes 1971; Waltz 1975; Rosenfeld, Hummel, and Zucker 1976; Kanade 1980). Nalwa (1993) gives a nice review of this area. The topic of edge detection was also an active area of research; a nice survey of contemporaneous work can be found in (Davis 1975).

Three-dimensional modeling of non-polyhedral objects was also being studied (Baumgart 1974; Baker 1977). One popular approach used generalized cylinders, i.e., solids of revolution and swept closed curves (Agin and Binford 1976; Nevatia and Binford 1977), often arranged into parts relationships ${ }^7$ (Hinton 1977; Marr 1982) (Figure 1.7c). Fischler and Elschlager (1973) called such elastic arrangements of parts pictorial structures (Figure 1.7b).

A qualitative approach to understanding intensities and shading variations and explaining them by the effects of image formation phenomena, such as surface orientation and shadows, was championed by Barrow and Tenenbaum (1981) in their paper on intrinsic images (Figure 1.7d), along with the related $21 / 2$-D sketch ideas of Marr (1982). This approach has seen periodic revivals, e.g., in the work of Tappen, Freeman, and Adelson (2005) and Barron and Malik (2012).

More quantitative approaches to computer vision were also developed at the time, including the first of many feature-based stereo correspondence algorithms (Figure 1.7e) (Dev 1974; Marr and Poggio 1976, 1979; Barnard and Fischler 1982; Ohta and Kanade 1985; Grimson 1985; Pollard, Mayhew, and Frisby 1985) and intensity-based optical flow algorithms (Figure 1.7f) (Horn and Schunck 1981; Huang 1981; Lucas and Kanade 1981; Nagel 1986). The early work in simultaneously recovering $3 \mathrm{D}$ structure and camera motion (see Chapter 11) also began around this time (Ullman 1979; Longuet-Higgins 1981).

计算机视觉代考

计算机代写|计算机视觉代写Computer Vision代考|What is computer vision

作为人类,我们显然很容易感知周围世界的三维结构。想一想当您看着坐在您旁边的桌子上的一瓶花时,三维感知是多么生动。您可以通过花瓣表面微妙的光线和阴影图案来分辨每个花瓣的形状和半透明度,并毫不费力地将每朵花从场景背景中分割出来(图 1.1)。看着带框的集体照,你可以很容易地数出照片中所有人的名字,甚至可以从他们的面部表情猜测他们的情绪(图 1.2a)。知觉心理学家花了数十年时间试图了解视觉系统是如何工作的,尽管他们可以设计视觉错觉1为了梳理它的一些原则(图 1.3),这个难题的完整解决方案仍然难以捉摸(Marr 1982;Wandell 1995;Palmer 1999;Livingstone 2008;Frisby 和 Stone 2010)。

计算机视觉研究人员一直在开发用于恢复图像中物体的三维形状和外观的数学技术。在这方面,过去二十年的进展非常迅速。我们现在拥有可靠的技术,可以从数千张部分重叠的照片中准确计算环境的 3D 模型(图 1.2c)。给定一个特定对象或外观的足够大的视图集,我们可以使用立体匹配创建精确的密集 3D 表面模型(图 1.2d)。我们甚至可以在一定程度上成功地勾勒出照片中的大部分人物和物体(图 1.2a)。然而,尽管取得了所有这些进步,但让计算机以与两岁儿童相同的细节和因果关系水平解释图像的梦想仍然遥不可及。

为什么视力这么难?部分原因是因为它是一个逆向问题,在没有足够的信息来完全指定解决方案的情况下,我们试图恢复一些未知数。因此,我们必须求助于基于物理和概率的模型,或从大量示例中进行机器学习,以消除潜在解决方案之间的歧义。然而,对复杂的视觉世界进行建模比对产生语音的声道进行建模要困难得多。

我们在计算机视觉中使用的正向模型通常是在物理学(辐射测量学、光学和传感器设计)和计算机图形学中开发的。这两个领域都模拟了物体如何移动和动画,光如何从其表面反射,被大气散射,通过相机镜头(或人眼)折射,最后投射到平面(或弯曲)图像平面上。虽然计算机图形学还不完美,但在许多领域,例如渲染由日常物体组成的静止场景或为恐龙等灭绝生物制作动画,现实的幻觉本质上是存在的。

在计算机视觉中,我们试图做相反的事情,即描述我们在一幅或多幅图像中看到的世界,并重建它的属性,例如形状、光照和颜色分布。令人惊奇的是,人类和动物如此毫不费力地做到这一点,而计算机视觉算法却如此容易出错。没有在该领域工作过的人往往会低估问题的难度。这种视觉应该很容易的误解可以追溯到人工智能的早期(见第 1.2 节),当时人们最初认为智能的认知(逻辑证明和规划)部分本质上比感知部分更难(Boden 2006 ).

计算机代写|计算机视觉代写Computer Vision代考|A brief history

在本节中,我简要介绍了过去 50 年来计算机视觉的主要发展(图 1.6),重点是我个人认为有趣并且经受住了时间考验的进步。对各种想法的来源和该领域的发展不感兴趣的读者可以跳到第 1.3 节中的本书概述。

70 年代。当计算机视觉在早期开始时1970 秒,它被视为模仿人类智能并赋予机器人智能行为的雄心勃勃议程的视觉感知组成部分。当时,人工智能和机器人技术的一些早期先驱(在麻省理工学院、斯坦福大学和卡内基梅隆大学)认为,解决“视觉输入”问题将是解决更困难的道路上的一个简单步骤高级推理和规划等问题。根据一个众所周知的故事,1966 年,麻省理工学院的马文·明斯基 (Marvin Minsky) 要求他的本科生杰拉尔德·杰伊·萨斯曼 (Gerald Jay Sussman) “用整个夏天将相机连接到计算机,并让计算机描述它所看到的内容”(Boden 2006,第 781 页) ).5我们现在知道这个问题比那个稍微难一点。6

计算机视觉与现有的数字图像处理领域(Rosenfeld 和 Pfaltz 1966;Rosenfeld 和 Kak 1976)的区别在于希望恢复三维

从图像中了解世界的结构,并将其用作理解全场景的垫脚石。Winston (1975) 以及 Hanson 和 Riseman (1978) 提供了两个很好的早期经典论文集。

早期的场景理解尝试涉及提取边缘,然后从 2D 线的拓扑结构推断对象或“块世界”的 3D 结构 (Roberts 1965)。当时开发了几种线标记算法(图 1.7a)(Huffman 1971;Clowes 1971;Waltz 1975;Rosenfeld、Hummel 和 Zucker 1976;Kanade 1980)。Nalwa (1993) 对这一领域进行了很好的评论。边缘检测也是一个活跃的研究领域;可以在 (Davis 1975) 中找到对同期工作的一个很好的调查。

非多面体物体的三维建模也在研究中(Baumgart 1974;Baker 1977)。一种流行的方法使用广义圆柱体,即旋转实体和扫掠闭合曲线(Agin 和 Binford 1976;Nevatia 和 Binford 1977),通常安排成零件关系7(Hinton 1977;Marr 1982)(图 1.7c)。Fischler 和 Elschlager (1973) 将这种弹性排列的部件称为图形结构(图 1.7b)。

Barrow 和 Tenenbaum (1981) 在他们关于固有图像的论文(图 1.7d)中提倡采用定性方法来理解强度和阴影变化并通过图像形成现象(例如表面方向和阴影)的影响来解释它们,以及相关的21/2-D 素描 Marr (1982) 的想法。这种方法已经周期性地复兴,例如,在 Tappen、Freeman 和 Adelson(2005 年)以及 Barron 和 Malik(2012 年)的工作中。

当时还开发了更多的计算机视觉定量方法,包括许多基于特征的立体对应算法中的第一个(图 1.7e)(Dev 1974;Marr 和 Poggio 1976、1979;Barnard 和 Fischler 1982;Ohta 和 Kanade 1985; Grimson 1985;Pollard、Mayhew 和 Frisby 1985)和基于强度的光流算法(图 1.7f)(Horn 和 Schunck 1981;Huang 1981;Lucas 和 Kanade 1981;Nagel 1986)。同时恢复的早期工作3丁结构和相机运动(见第 11 章)也大约在这个时候开始(Ullman 1979;Longuet-Higgins 1981)。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。统计代写|python代写代考

随机过程代考

在概率论概念中,随机过程是随机变量的集合。 若一随机系统的样本点是随机函数,则称此函数为样本函数,这一随机系统全部样本函数的集合是一个随机过程。 实际应用中,样本函数的一般定义在时间域或者空间域。 随机过程的实例如股票和汇率的波动、语音信号、视频信号、体温的变化,随机运动如布朗运动、随机徘徊等等。

贝叶斯方法代考

贝叶斯统计概念及数据分析表示使用概率陈述回答有关未知参数的研究问题以及统计范式。后验分布包括关于参数的先验分布,和基于观测数据提供关于参数的信息似然模型。根据选择的先验分布和似然模型,后验分布可以解析或近似,例如,马尔科夫链蒙特卡罗 (MCMC) 方法之一。贝叶斯统计概念及数据分析使用后验分布来形成模型参数的各种摘要,包括点估计,如后验平均值、中位数、百分位数和称为可信区间的区间估计。此外,所有关于模型参数的统计检验都可以表示为基于估计后验分布的概率报表。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

statistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

机器学习代写

随着AI的大潮到来,Machine Learning逐渐成为一个新的学习热点。同时与传统CS相比,Machine Learning在其他领域也有着广泛的应用,因此这门学科成为不仅折磨CS专业同学的“小恶魔”,也是折磨生物、化学、统计等其他学科留学生的“大魔王”。学习Machine learning的一大绊脚石在于使用语言众多,跨学科范围广,所以学习起来尤其困难。但是不管你在学习Machine Learning时遇到任何难题,StudyGate专业导师团队都能为你轻松解决。

多元统计分析代考

基础数据: $N$ 个样本, $P$ 个变量数的单样本,组成的横列的数据表

变量定性: 分类和顺序;变量定量:数值

数学公式的角度分为: 因变量与自变量

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。