如果你也在 怎样代写线性回归分析linear regression analysis这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

回归分析是一种强大的统计方法,允许你检查两个或多个感兴趣的变量之间的关系。虽然有许多类型的回归分析,但它们的核心都是考察一个或多个自变量对因变量的影响。

statistics-lab™ 为您的留学生涯保驾护航 在代写线性回归分析linear regression analysis方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写线性回归分析linear regression analysis代写方面经验极为丰富,各种代写线性回归分析linear regression analysis相关的作业也就用不着说。

我们提供的线性回归分析linear regression analysis及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等楖率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

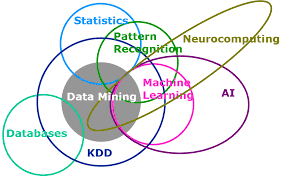

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

统计代写|线性回归分析代写linear regression analysis代考|Vectors of Random Variables

Matrices and vectors are denoted by boldface letters $\mathbf{A}$ and $\mathbf{a}$, respectively, and scalars by italics. Random variables are represented by capital letters and their values by lowercase letters (e.g., $Y$ and $y$, respectively). This use of capitals for random variables, which seems to be widely accepted, is particularly useful in regression when distinguishing between fixed and random regressor (independent) variables. However, it does cause problems because a vector of random variables, Y, say, then looks like a matrix. Occasionally, because of a shortage of letters, a boldface lowercase letter represents a vector of random variables.

If $X$ and $Y$ are random variables, then the symbols $E[Y], \operatorname{var}[Y], \operatorname{cov}[X, Y]$, and $E[X \mid Y=y]$ (or, more briefly, $E[X \mid Y]$ ) represent expectation, variance, covariance, and conditional expectation, respectively.

The $n \times n$ matrix with diagonal elements $d_1, d_2, \ldots, d_n$ and zeros elsewhere is denoted by $\operatorname{diag}\left(d_1, d_2, \ldots, d_n\right)$, and when all the $d_i$ ‘s are unity we have the identity matrix $\mathbf{I}_n$.

If $\mathbf{a}$ is an $n \times 1$ column vector with elements $a_1, a_2, \ldots, a_n$, we write $\mathbf{a}=\left(a_i\right)$, and the length or norm of $\mathbf{a}$ is denoted by $|\mathbf{a}|$. Thus

$$

|\mathbf{a}|=\sqrt{\mathbf{a}^{\prime} \mathbf{a}}=\left(a_1^2+a_2^2+\cdots+a_n^2\right)^{1 / 2} .

$$

The vector with elements all equal to unity is represented by $\mathbf{1}_n$, and the set of all vectors having $n$ elements is denoted by $\Re_n$.

If the $m \times n$ matrix $\mathbf{A}$ has elements $a_{i j}$, we write $\mathbf{A}=\left(a_{i j}\right)$, and the sum of the diagonal elements, called the trace of $\mathbf{A}$, is denoted by $\operatorname{tr}(\mathbf{A})$ $\left(=a_{11}+a_{22}+\cdots+a_{k h}\right.$, where $k$ is the smaller of $m$ and $\left.n\right)$. The transpose of $\mathbf{A}$ is represented by $\mathbf{A}^{\prime}=\left(a_{i j}^{\prime}\right)$, where $a_{i j}^{\prime}=a_{j i}$. If $\mathbf{A}$ is square, its determinant is written $\operatorname{det}(\mathbf{A})$, and if $\mathbf{A}$ is nonsingular its inverse is denoted by $\mathbf{A}^{-1}$. The space spanned by the columns of $\mathbf{A}$, called the column space of $\mathbf{A}$, is denoted by $\mathcal{C}(\mathbf{A})$. The null space or kernel of $\mathbf{A}(={x: \mathbf{A x}=0})$ is denoted by $\mathcal{N}(\mathbf{A})$

We say that $Y \sim N\left(\theta, \sigma^2\right)$ if $Y$ is normally distributed with mean $\theta$ and variance $\sigma^2: Y$ has a standard normal distribution if $\theta=0$ and $\sigma^2=1$. The $t$ – and chi-square distributions with $k$ degrees of freedom are denoted by $t_k$ and $\chi_k^2$, respectively, and the $F$-distribution with $m$ and $n$ degrees of freedom is denoted by $F_{m, n}$.

Finally we mention the dot and bar notation, representing sum and average, respectively; for example,

$$

a_i .=\sum_{j=1}^J a_{i j} \quad \text { and } \quad \bar{a}{i .}=\frac{a{i .} .}{J} .

$$

In the case of a single subscript, we omit the dot.

Some knowledge of linear algebra by the reader is assumed, and for a short review course several books are available (see, e.g., Harville [1997]). However, a number of matrix results are included in Appendices $\mathrm{A}$ and $\mathrm{B}$ at the end of this book, and references to these appendices are denoted by, e.g., A.2.3.

统计代写|线性回归分析代写linear regression analysis代考|STATISTICAL MODELS

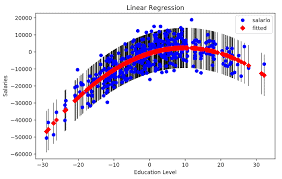

A major activity in statistics is the building of statistical models that hopefully reflect the important aspects of the object of study with some degree of realism. In particular, the aim of regression analysis is to construct mathematical models which describe or explain relationships that may exist between variables. The simplest case is when there are just two variables, such as height and weight, income and intelligence quotient (IQ), ages of husband and wife at marriage, population size and time, length and breadth of leaves, temperature and pressure of a certain volume of gas, and so on. If we have $n$ pairs of observations $\left(x_i, y_i\right)(i=1,2, \ldots, n)$, we can plot these points, giving a scatter diagram, and endeavor to fit a smooth curve through the points in such a way that the points are as close to the curve as possible. Clearly, we would not expect an exact fit, as at least one of the variables is subject to chance fluctuations due to factors outside our control. Even if there is an “exact” relationship between such variables as temperature and pressure, fluctuations would still show up in the scatter diagram because of errors of measurement. The simplest two-variable regression model is the straight line, and it is assumed that the reader has already come across the fitting of such a model.

Statistical models are fitted for a variety of reasons. One important reason is that of trying to uncover causes by studying relationships between vari-ables. Usually, we are interested in just one variable, called the response (or predicted or dependent) variable, and we want to study how it depends on a set of variables called the explanatory variables (or regressors or independent variables). For example, our response variable might be the risk of heart attack, and the explanatory variables could include blood pressure, age, gender, cholesterol level, and so on. We know that statistical relationships do not necessarily imply causal relationships, but the presence of any statistical relationship does give us a starting point for further research. Once we are confident that a statistical relationship exists, we can then try to model this relationship mathematically and then use the model for prediction. For a given person, we can use their values of the explanatory variables to predict their risk of a heart attack. We need, however, to be careful when making predictions outside the usual ranges of the explanatory variables, as the model may not be valid there.

A second reason for fitting models, over and above prediction and explanation, is to examine and test scientific hypotheses, as in the following simple examples.

线性回归分析代写

统计代写|线性回归分析代写linear regression analysis代考|Vectors of Random Variables

矩阵和向量用粗体字母表示 $\mathbf{A}$ 和 $\mathbf{a}$, 和斜体标量。随机变量用大写字母表示,它们的值用小写字母表示 (例如, $Y$ 和 $y$ ,分别) 。这种似乎被广泛接受的随机变量大写的使用在区分固定和随机回归变量 (独立) 变量时在回归 中特别有用。但是,它确实会引起问题,因为随机变量向量 Y看起来像一个矩阵。有时,由于缺少字母,粗体小 写字母表示随机变量的向量。

如果 $X$ 和 $Y$ 是随机变量,那么符号 $E[Y], \operatorname{var}[Y], \operatorname{cov}[X, Y]$ ,和 $E[X \mid Y=y]$ (或者,更简单地说, $E[X \mid Y]$ ) 分别表示期望、方差、协方差和条件期望。

这 $n \times n$ 具有对角元素的矩阵 $d_1, d_2, \ldots, d_n$ 其他地方的零表示为 $\operatorname{diag}\left(d_1, d_2, \ldots, d_n\right)$ ,并且当所有 $d_i$ 是统 一的,我们有单位矩阵 $\mathbf{I}n$. 如果 $\mathbf{a}$ 是一个 $n \times 1$ 带有元素的列向量 $a_1, a_2, \ldots, a_n$ ,我们写 $\mathbf{a}=\left(a_i\right)$ , 以及的长度或范数 $\mathbf{a}$ 表示为 $|\mathbf{a}|$. 因此 $$ |\mathbf{a}|=\sqrt{\mathbf{a}^{\prime} \mathbf{a}}=\left(a_1^2+a_2^2+\cdots+a_n^2\right)^{1 / 2} . $$ 元素都等于 1 的向量表示为 $\mathbf{1}_n$ ,并且所有向量的集合具有 $n$ 元素表示为 $\Re_n$. 如果 $m \times n$ 矩阵 $\mathbf{A}$ 有元素 $a{i j}$ ,我们写 $\mathbf{A}=\left(a_{i j}\right)$ ,以及对角线元素的总和,称为 $\mathbf{A}$ ,表示为 $\operatorname{tr}(\mathbf{A})$ $\left(=a_{11}+a_{22}+\cdots+a_{k h}\right.$ ,在哪里 $k$ 是较小的 $m$ 和 $\left.n\right)$. 的转置 $\mathbf{A}$ 表示为 $\mathbf{A}^{\prime}=\left(a_{i j}^{\prime}\right)$ ,在哪里 $a_{i j}^{\prime}=a_{j i}$. 如 果 $\mathbf{A}$ 是正方形,它的行列式写成 $\operatorname{det}(\mathbf{A})$ ,而如果 $\mathbf{A}$ 是非奇异的,它的逆表示为 $\mathbf{A}^{-1}$. 列所跨越的空间 $\mathbf{A}$ ,称为 列空间 $\mathbf{A}$, 表示为 $\mathcal{C}(\mathbf{A})$. 零空间或内核 $\mathbf{A}(=x: \mathbf{A} \mathbf{x}=0)$ 表示为 $\mathcal{N}(\mathbf{A})$

我们说 $Y \sim N\left(\theta, \sigma^2\right)$ 如果 $Y$ 正态分布,均值 $\theta$ 和方差 $\sigma^2: Y$ 具有标准正态分布,如果 $\theta=0$ 和 $\sigma^2=1$. 这 $t-$ 和卡方分布 $k$ 自由度表示为 $t_k$ 和 $\chi_k^2$ ,分别和 $F$-分布与 $m$ 和 $n$ 自由度表示为 $F_{m, n}$.

最后我们提到点和条符号,分别代表总和和平均值;例如,

$$

a_i .=\sum_{j=1}^J a_{i j} \quad \text { and } \quad \bar{a} i .=\frac{a i . .}{J} .

$$

在单个下标的情况下,我们省略了点。

假定读者对线性代数有一定的了解,并且对于简短的复习课程,有几本书可用 (例如,参见 Harville [1997])。 但是,附录中包含了一些矩阵结果A和B在本书的末尾,对这些附录的引用由例如 A.2.3 表示。

统计代写|线性回归分析代写linear regression analysis代考|STATISTICAL MODELS

统计学的一项主要活动是建立统计模型,希望能在一定程度上反映研究对象的重要方面。特别是,回归分析的目的是构建描述或解释变量之间可能存在的关系的数学模型。最简单的情况是当只有两个变量,例如身高和体重、收入和智商(IQ)、结婚时夫妻的年龄、人口规模和时间、树叶的长度和宽度、某个人的温度和压力气体量等。如果我们有n成对的观察(X一世,是一世)(一世=1,2,…,n),我们可以绘制这些点,给出一个散点图,并努力通过这些点拟合一条平滑的曲线,使这些点尽可能靠近曲线。显然,我们不会期望完全匹配,因为至少有一个变量会由于我们无法控制的因素而受到偶然波动的影响。即使温度和压力等变量之间存在“精确”关系,由于测量误差,波动仍然会出现在散点图中。最简单的二元回归模型是直线,假设读者已经遇到过这种模型的拟合。

出于各种原因拟合统计模型。一个重要的原因是试图通过研究变量之间的关系来发现原因。通常,我们只对一个变量感兴趣,称为响应(或预测或因)变量,我们想研究它如何依赖于一组称为解释变量(或回归变量或自变量)的变量。例如,我们的响应变量可能是心脏病发作的风险,解释变量可能包括血压、年龄、性别、胆固醇水平等。我们知道统计关系并不一定意味着因果关系,但任何统计关系的存在确实为我们提供了进一步研究的起点。一旦我们确信存在统计关系,然后我们可以尝试对这种关系进行数学建模,然后使用该模型进行预测。对于给定的人,我们可以使用他们的解释变量值来预测他们心脏病发作的风险。然而,在解释变量的通常范围之外进行预测时,我们需要小心,因为模型在那里可能无效。

除了预测和解释之外,拟合模型的第二个原因是检查和检验科学假设,如下面的简单示例所示。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

随机过程代考

在概率论概念中,随机过程是随机变量的集合。 若一随机系统的样本点是随机函数,则称此函数为样本函数,这一随机系统全部样本函数的集合是一个随机过程。 实际应用中,样本函数的一般定义在时间域或者空间域。 随机过程的实例如股票和汇率的波动、语音信号、视频信号、体温的变化,随机运动如布朗运动、随机徘徊等等。

贝叶斯方法代考

贝叶斯统计概念及数据分析表示使用概率陈述回答有关未知参数的研究问题以及统计范式。后验分布包括关于参数的先验分布,和基于观测数据提供关于参数的信息似然模型。根据选择的先验分布和似然模型,后验分布可以解析或近似,例如,马尔科夫链蒙特卡罗 (MCMC) 方法之一。贝叶斯统计概念及数据分析使用后验分布来形成模型参数的各种摘要,包括点估计,如后验平均值、中位数、百分位数和称为可信区间的区间估计。此外,所有关于模型参数的统计检验都可以表示为基于估计后验分布的概率报表。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

statistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

机器学习代写

随着AI的大潮到来,Machine Learning逐渐成为一个新的学习热点。同时与传统CS相比,Machine Learning在其他领域也有着广泛的应用,因此这门学科成为不仅折磨CS专业同学的“小恶魔”,也是折磨生物、化学、统计等其他学科留学生的“大魔王”。学习Machine learning的一大绊脚石在于使用语言众多,跨学科范围广,所以学习起来尤其困难。但是不管你在学习Machine Learning时遇到任何难题,StudyGate专业导师团队都能为你轻松解决。

多元统计分析代考

基础数据: $N$ 个样本, $P$ 个变量数的单样本,组成的横列的数据表

变量定性: 分类和顺序;变量定量:数值

数学公式的角度分为: 因变量与自变量

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。