如果你也在 怎样代写流形学习manifold data learning这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

流形学习是机器学习的一个流行且快速发展的子领域,它基于一个假设,即一个人的观察数据位于嵌入高维空间的低维流形上。本文介绍了流形学习的数学观点,深入探讨了核学习、谱图理论和微分几何的交叉点。重点放在图和流形之间的显著相互作用上,这构成了流形正则化技术的广泛使用的基础。

statistics-lab™ 为您的留学生涯保驾护航 在代写流形学习manifold data learning方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写流形学习manifold data learning代写方面经验极为丰富,各种代写流形学习manifold data learning相关的作业也就用不着说。

我们提供的流形学习manifold data learning及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

机器学习代写|流形学习代写manifold data learning代考|Dimensionality Reduction and Manifold Learning

Feature extraction is also referred to as dimensionality reduction, manifold learning [12], subspace learning, submanifold learning, manifold unfolding, embedding, encoding, and representation learning [7, 70]. This book uses manifold learning and dimensionality reduction interchangeably for feature extraction. Manifold learning techniques can be used in a variety of ways, including:

- Data dimensionality reduction: Produce a compact (compressed) lowdimensional encoding of a given high-dimensional dataset.

- Data visualization: Provide an interpretation of a given dataset in terms of intrinsic degrees of freedom, usually as a byproduct of data dimensionality reduction.

- Preprocessing for supervised learning: Simplify, reduce, and clean the data for subsequent supervised training.

In dimensionality reduction, the data points are mapped to a lower-dimensional subspace either linearly or nonlinearly. Dimensionality reduction methods can be grouped into three categories-spectral dimensionality reduction, probabilistic dimensionality reduction, and (artificial) neural network-based dimensionality reduction [19] (see Fig.1.3). These categories are introduced in the following subsections.

Consider several points in a three-dimensional Euclidean space. Assume these points lie on a nonlinear submanifold with a local dimensionality of two, as illustrated in Fig. 1.4a. This means that there is no need to have three features to represent each of these points. Rather, two features can represent most of the data points’ information if the two features demonstrate the 2D coordinates on the submanifold. A nonlinear dimensionality reduction method can unfold this manifold correctly, as depicted in Fig. 1.4b. However, a linear dimensionality reduction method cannot properly find a correct underlying $2 \mathrm{D}$ representation of the data points. Figure $1.4 \mathrm{c}$ demonstrates that a linear method ruins the relative structure of the data points. This is because a linear method uses the Euclidean distances between the points, while a nonlinear method considers the geodesic distances along the nonlinear submanifold. If the submanifold is linear, the linear method is able to obtain the lower-dimensional structure of the data. Spectral dimensionality reduction methods typically have a geometric perspective and attempt to find the linear or nonlinear submanifold of the data. These methods are often reduced to a generalized eigenvalue problem [20].

机器学习代写|流形学习代写manifold data learning代考|History of Spectral Dimensionality Reduction

Principal Component Analysis (PCA) [34] was first proposed by Pearson in 1901 [47]. It was the first spectral dimensionality reduction method and one of the first methods in linear subspace learning. It is unsupervised, meaning that it does not use any class labels. Fisher Discriminant Analysis (FDA) [16], proposed by Fisher in 1936 [15], was the first supervised spectral dimensionality reduction method. PCA and FDA are based on the scatter, i.e., variance of the data. A proper subspace preserves either the relative similarity or relative dissimilarity of the data points after transformation of data from the input space to the subspace. This was the goal of Multidimensional Scaling (MDS) [13], which preserves the relative similarities of data points in its subspace. In later MDS approaches, the cost function was changed to preserve the distances between points [37], which developed into Sammon mapping [52]. Sammon mapping is considered to be the first nonlinear dimensionality reduction method.

Figure $1.4$ demonstrates that a linear algorithm cannot perform well on nonlinear data. For nonlinear data, two approaches can be used:

- a nonlinear algorithm should be designed to handle nonlinear data, or

- the nonlinear data should be modified to become linear. In this case, the data should be transformed to another space to become linearly separable in that space. Then, the transformed data, which now have a linear pattern, will be able to use a linear approach. This approach is called kernelization in machine learning.

The kernel PCA $[54,55]$ uses the PCA and the kernel trick [32] to transform data to a high-dimensional space so that it becomes roughly linear within that space. Kernel FDA $[44,45]$ was also proposed to manipulate nonlinear data in a supervised manner using representation theory [3]. Representation theory can be used for kernelization; it will be introduced in Chap. 3 .

流形学习代写

机器学习代写|流形学习代写manifold data learning代考|Dimensionality Reduction and Manifold Learning

特征提取也称为降维、流形学习 [12]、子空间学习、子流形学习、流形展开、嵌入、编码和表示学习 [7, 70]。本书交替使用流形学习和降维来进行特征提取。流形学习技术可以以多种方式使用,包括:

- 数据降维:为给定的高维数据集生成紧凑(压缩)的低维编码。

- 数据可视化:根据内在自由度提供给定数据集的解释,通常作为数据降维的副产品。

- Preprocessing for supervised learning:简化、减少和清洗数据,用于后续的监督训练。

在降维中,数据点被线性或非线性映射到低维子空间。降维方法可以分为三类——谱降维、概率降维和基于(人工)神经网络的降维[19](见图1.3)。这些类别在以下小节中介绍。

考虑三维欧几里德空间中的几个点。假设这些点位于局部维数为 2 的非线性子流形上,如图 1.4a 所示。这意味着不需要三个特征来表示这些点中的每一个。相反,如果这两个特征展示了子流形上的二维坐标,则这两个特征可以表示大部分数据点的信息。如图 1.4b 所示,非线性降维方法可以正确展开该流形。然而,线性降维方法无法正确找到正确的底层2丁数据点的表示。数字1.4C表明线性方法破坏了数据点的相对结构。这是因为线性方法使用点之间的欧几里得距离,而非线性方法考虑沿非线性子流形的测地线距离。如果子流形是线性的,则线性方法能够获得数据的低维结构。谱降维方法通常具有几何视角,并试图找到数据的线性或非线性子流形。这些方法通常被简化为广义特征值问题 [20]。

机器学习代写|流形学习代写manifold data learning代考|History of Spectral Dimensionality Reduction

主成分分析(PCA)[34]最早由 Pearson 于 1901 年提出[47]。它是第一个谱降维方法,也是线性子空间学习中最早的方法之一。它是无监督的,这意味着它不使用任何类别标签。Fisher判别分析(FDA)[16]是由Fisher于1936年[15]提出的,是第一个有监督的谱降维方法。PCA 和 FDA 基于散点,即数据的方差。在将数据从输入空间转换到子空间之后,适当的子空间保留数据点的相对相似性或相对不相似性。这是多维缩放 (MDS) [13] 的目标,它保留了其子空间中数据点的相对相似性。在后来的 MDS 方法中,更改成本函数以保留点之间的距离 [37],这发展成 Sammon 映射 [52]。Sammon映射被认为是第一个非线性降维方法。

数字1.4表明线性算法不能很好地处理非线性数据。对于非线性数据,可以使用两种方法:

- 应该设计一个非线性算法来处理非线性数据,或者

- 非线性数据应修改为线性。在这种情况下,应该将数据转换到另一个空间,使其在该空间中线性可分。然后,现在具有线性模式的转换数据将能够使用线性方法。这种方法在机器学习中称为内核化。

内核PCA[54,55]使用 PCA 和内核技巧 [32] 将数据转换到高维空间,使其在该空间内大致呈线性。内核FDA[44,45]还提出了使用表示论 [3] 以监督方式操纵非线性数据。表示论可用于核化;将在第 1 章介绍。3.

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

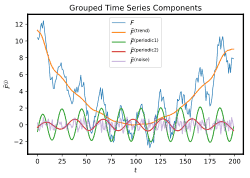

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。