计算机代写|机器学习代写machine learning代考|COMP5318

如果你也在 怎样代写机器学习 machine learning这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

机器学习是一个致力于理解和建立 “学习 “方法的研究领域,也就是说,利用数据来提高某些任务的性能的方法。机器学习算法基于样本数据(称为训练数据)建立模型,以便在没有明确编程的情况下做出预测或决定。机器学习算法被广泛用于各种应用,如医学、电子邮件过滤、语音识别和计算机视觉,在这些应用中,开发传统算法来执行所需任务是困难的或不可行的。

statistics-lab™ 为您的留学生涯保驾护航 在代写机器学习 machine learning方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写机器学习 machine learning代写方面经验极为丰富,各种代写机器学习 machine learning相关的作业也就用不着说。

我们提供的机器学习 machine learning及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

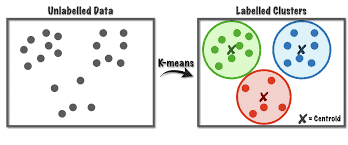

计算机代写|机器学习代写machine learning代考|Vector quantization

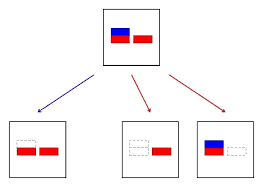

Suppose we want to perform lossy compression of some real-valued vectors, $\boldsymbol{x}n \in \mathbb{R}^D$. A very simple approach to this is to use vector quantization or VQ. The basic idea is to replace each real-valued vector $\boldsymbol{x}_n \in \mathbb{R}^D$ with a discrete symbol $z_n \in{1, \ldots, K}$, which is an index into a codebook of $K$ prototypes, $\boldsymbol{\mu}_k \in \mathbb{R}^D$. Each data vector is encoded by using the index of the most similar prototype, where similarity is measured in terms of Euclidean distance: $$ \operatorname{encode}\left(\boldsymbol{x}_n\right)=\arg \min _k\left|\boldsymbol{x}_n-\boldsymbol{\mu}_k\right|^2 $$ We can define a cost function that measures the quality of a codebook by computing the reconstruction error or distortion it induces: $$ J \triangleq \frac{1}{N} \sum{n=1}^N\left|\boldsymbol{x}n-\operatorname{decode}\left(\operatorname{encode}\left(\boldsymbol{x}_n\right)\right)\right|^2=\frac{1}{N} \sum{n=1}^N\left|\boldsymbol{x}n-\boldsymbol{\mu}{z_n}\right|^2

$$

where decode $(k)=\boldsymbol{\mu}_k$. This is exactly the cost function that is minimized by the K-means algorithm. Of course, we can achieve zero distortion if we assign one prototype to every data vector, by using $K=N$ and assigning $\boldsymbol{\mu}_n=\boldsymbol{x}_n$. However, this does not compress the data at all. In particular, it takes $O(N D B)$ bits, where $N$ is the number of real-valued data vectors, each of length $D$, and $B$ is the number of bits needed to represent a real-valued scalar (the quantization accuracy to represent each $\left.\boldsymbol{x}_n\right)$

We can do better by detecting similar vectors in the data, creating prototypes or centroids for them, and then representing the data as deviations from these prototypes. This reduces the space requirement to $O\left(N \log _2 K+K D B\right)$ bits. The $O\left(N \log _2 K\right)$ term arises because each of the $N$ data vectors needs to specify which of the $K$ codewords it is using; and the $O(K D B)$ term arises because we have to store each codebook entry, each of which is a $D$-dimensional vector. When $N$ is large, the first term dominates the second, so we can approximate the rate of the encoding scheme (number of bits needed per object) as $O\left(\log _2 K\right)$, which is typically much less than $O(D B)$.

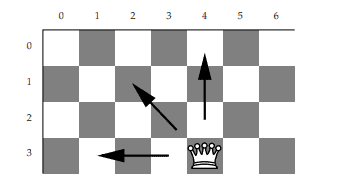

One application of VQ is to image compression. Consider the $200 \times 320$ pixel image in Figure $21.9$; we will treat this as a set of $N=64,000$ scalars. If we use one byte to represent each pixel (a gray-scale intensity of 0 to 255 ), then $B=8$, so we need $N B=512,000$ bits to represent the image in uncompressed form. For the compressed image, we need $O\left(N \log _2 K\right)$ bits. For $K=4$, this is about $128 \mathrm{~kb}$, a factor of 4 compression, yet it results in negligible perceptual loss (see Figure 21.9(b)). Greater compression could be achieved if we modeled spatial correlation between the pixels, e.g., if we encoded $5 \times 5$ blocks (as used by JPEG). This is because the residual errors (differences from the connection between data compression and density estimation. See the sequel to this book, [Mur22], for more information.

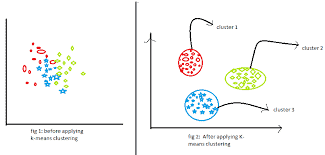

计算机代写|机器学习代写machine learning代考|The K-means++ algorithm

K-means is optimizing a non-convex objective, and hence needs to be initialized carefully. A simple approach is to pick $K$ data points at random, and to use these as the initial values for $\boldsymbol{\mu}_k$. We can improve on this by using multiple restarts, i.e., we run the algorithm multiple times from different random starting points, and then pick the best solution. However, this can be slow.

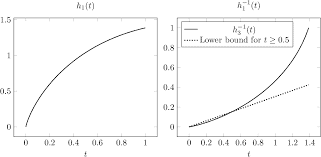

A better approach is to pick the centers sequentially so as to try to “cover” the data. That is, we pick the initial point uniformly at random, and then each subsequent point is picked from the remaining points, with probability proportional to its squared distance to the point’s closest cluster center. That is, at iteration $t$, we pick the next cluster center to be $\boldsymbol{x}n$ with probability $$ p\left(\boldsymbol{\mu}_t=\boldsymbol{x}_n\right)=\frac{D{t-1}\left(\boldsymbol{x}n\right)}{\sum{n^{\prime}=1}^N D_{t-1}\left(\boldsymbol{x}{n^{\prime}}\right)} $$ where $$ D_t(\boldsymbol{x})=\min {k=1}^{t-1}\left|\boldsymbol{x}-\boldsymbol{\mu}_k\right|_2^2

$$

is the squared distance of $\boldsymbol{x}$ to the closest existing centroid. Thus points that are far away from a centroid are more likely to be picked, thus reducing the distortion. This is known as farthest point clustering [Gon85], or K-means++ [AV07; Bah+12; Bac+16; BLK17; LS19a]. Surprisingly, this simple trick can be shown to guarantee that the recontruction error is never more than $O(\log K)$ worse than optimal [AV07].

机器学习代考

计算机代写|机器学习代写machine learning代考|Vector quantization

假设我们要对一些实值向量进行有损压缩, $x n \in \mathbb{R}^D$.一种非常简单的方法是使用矢量量化或 $V Q_{\text {。 基本思想是 }}$ 替换每个实值向量 $\boldsymbol{x}_n \in \mathbb{R}^D$ 带有离散符号 $z_n \in 1, \ldots, K$ ,这是一个密码本的索引 $K$ 原型, $\boldsymbol{\mu}_k \in \mathbb{R}^D$. 每个数 据向量都使用最相似原型的索引进行编码,其中相似性根据欧氏距离来衡量:

$$

\operatorname{encode}\left(\boldsymbol{x}_n\right)=\arg \min _k\left|\boldsymbol{x}_n-\boldsymbol{\mu}_k\right|^2

$$

我们可以定义一个成本函数,通过计算它引起的重构误差或失真来衡量码本的质量:

$$

J \triangleq \frac{1}{N} \sum n=1^N\left|\boldsymbol{x} n-\operatorname{decode}\left(\operatorname{encode}\left(\boldsymbol{x}_n\right)\right)\right|^2=\frac{1}{N} \sum n=1^N\left|\boldsymbol{x} n-\boldsymbol{\mu} z_n\right|^2

$$

在哪里解码 $(k)=\boldsymbol{\mu}_k$. 这正是 K-means 算法最小化的成本函数。当然,如果我们为每个数据向量分配一个原 型,我们可以实现零失真,通过使用 $K=N$ 并分配 $\boldsymbol{\mu}_n=\boldsymbol{x}_n$. 但是,这根本不会压缩数据。特别是,它需要 $O(N D B)$ 位,其中 $N$ 是实值数据向量的数量,每个向量的长度 $D$ ,和 $B$ 是表示实数值标量所需的位数(表示 每个标量的量化精度 $\left.\boldsymbol{x}_n\right)$

我们可以通过检测数据中的相似向量,为它们创建原型或质心,然后将数据表示为与这些原型的偏差来做得更 好。这减少了空间需求 $O\left(N \log _2 K+K D B\right)$ 位。这 $O\left(N \log _2 K\right)$ 术语出现是因为每个 $N$ 数据向量需要指 定哪一个 $K$ 它正在使用的代码字;和 $O(K D B)$ 出现术语是因为我们必须存储每个密码本条目,每个条目都是一 个 $D$ 维向量。什么时候 $N$ 很大,第一项支配第二项,因此我们可以将编码方案的速率 (每个对象所需的位数) 近似为 $O\left(\log _2 K\right)$ ,这通常远小于 $O(D B)$.

VQ 的一个应用是图像压缩。考虑 $200 \times 320$ 图中的像素图像 $21.9$; 我们将把它当作一组 $N=64,000$ 标量。如 果我们用一个字节来表示每个像素 (灰度强度为 0 到 255 ) ,那么 $B=8$ ,所以我们需要 $N B=512,000$ 以末 压缩形式表示图像的位。对于压缩图像,我们需要 $O\left(N \log _2 K\right)$ 位。为了 $K=4$ ,这是关于 $128 \mathrm{~kb}$ ,一个 4 倍的压缩因子,但它导致的感知损失可以忽略不计(见图 $21.9$ (b) ) 。如果我们对像素之间的空间相关性进行 建模,例如,如果我们编码,则可以实现更大的压缩 $5 \times 5$ 块(由JPEG 使用)。这是因为残差 (不同于数据压 缩和密度估计之间的联系。有关更多信息,请参阅本书的续集 [Mur22]。

计算机代写|机器学习代写machine learning代考|The K-means++ algorithm

K-means 正在优化一个非凸目标,因此需要仔细初始化。一个简单的方法是选择 $K$ 随机数据点,并使用这些作 为初始值 $\boldsymbol{\mu}k$. 我们可以通过使用多次重新启动来改进这一点,即我们从不同的随机起点多次运行算法,然后选择 最佳解决方案。但是,这可能很慢。 更好的方法是按顺序选择中心以尝试”覆盖”数据。也就是说,我们随机均匀地选择初始点,然后从剩余的点中选 择每个后续点,概率与其到该点最近的聚类中心的距离的平方成正比。也就是说,在迭代 $t$ ,我们选择下一个聚 类中心 $\boldsymbol{x} n$ 有概率 $$ p\left(\boldsymbol{\mu}_t=\boldsymbol{x}_n\right)=\frac{D t-1(\boldsymbol{x} n)}{\sum n^{\prime}=1^N D{t-1}\left(\boldsymbol{x} n^{\prime}\right)}

$$

在哪里

$$

D_t(\boldsymbol{x})=\min k=1^{t-1}\left|\boldsymbol{x}-\boldsymbol{\mu}_k\right|_2^2

$$

是的平方距离 $\boldsymbol{x}$ 到最近的现有质心。因此远离质心的点更有可能被拾取,从而减少失真。这被称为最远点聚类 [Gon85],或 K-means++ [AV07;呸+12;背+16;BLK17;LS19a]。令人惊讶的是,这个简单的技巧可以保证 重构误差永远不会超过 $O(\log K)$ 比最优 [AV07] 更差。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

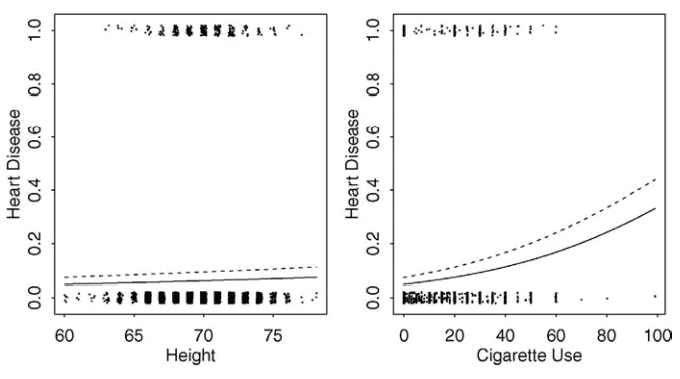

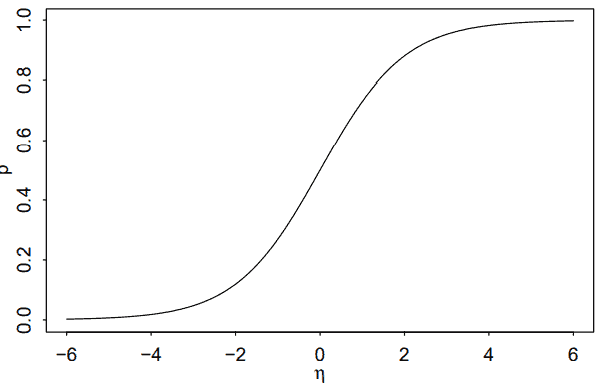

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。