计算机代写|机器学习代写machine learning代考|COMP5318

如果你也在 怎样代写机器学习 machine learning这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

机器学习是一个致力于理解和建立 “学习 “方法的研究领域,也就是说,利用数据来提高某些任务的性能的方法。机器学习算法基于样本数据(称为训练数据)建立模型,以便在没有明确编程的情况下做出预测或决定。机器学习算法被广泛用于各种应用,如医学、电子邮件过滤、语音识别和计算机视觉,在这些应用中,开发传统算法来执行所需任务是困难的或不可行的。

statistics-lab™ 为您的留学生涯保驾护航 在代写机器学习 machine learning方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写机器学习 machine learning代写方面经验极为丰富,各种代写机器学习 machine learning相关的作业也就用不着说。

我们提供的机器学习 machine learning及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等概率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

计算机代写|机器学习代写machine learning代考|The Pitfalls of Large-Dimensional Statistics

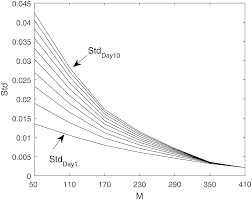

The big data revolution comes along with the challenging needs to parse, mine, and compress a large amount of large-dimensional and possibly heterogeneous data. In many applications, the dimension $p$ of the observations is as large as $-$ if not much larger than – their number $n$. In array processing and wireless communications, the number of antennas required for fine localization resolution or increased communication throughput may be as large (today in the order of hundreds) as the number of available independent signal observations [Li and Stoica, 2007, Lu et al., 2014]. In genomics, the identification of correlations among hundreds of thousands of genes based on a limited number of independent (and expensive) samples induces an even larger ratio $\mathrm{p} / \mathrm{n}$ [Arnold et al., 1994]. In statistical finance, portfolio optimization relies on the need to invest on a large number $p$ of assets to reduce volatility but at the same time to estimate the current (rather than past) asset statistics from a relatively small number $n$ of asset return records [Laloux et al., 2000].

As we shall demonstrate in the following section, the fact that in these problems $n$ is not much larger than $p$ annihilates most of the results from standard asymptotic statistics that assume $n$ alone is large [Vaart, 2000]. As a rule of thumb, by “much larger” we mean here that $n$ must be at least 100 times larger than $p$ for standard asymptotic statistics to be of practical convenience (see our argument in Section 1.1.2). Many algorithms in statistics, signal processing, and machine learning are precisely derived from this $n \gg p$ assumption that is no longer appropriate today. A major objective of this book is to cast some light on the resulting biases and problems incurred and to provide a systematic random matrix framework to improve these algorithms.

Possibly more importantly, we will see in this book that (small $p$ ) small-dimensional intuitions at the core of many machine learning algorithms (starting with spectral clustering [Ng et al., 2002, Luxburg, 2007]) may strikingly fail when applied in a simultaneously large $n, p$ setting. A compelling example lies in the notion of “distance” between vectors. Most classification methods in machine learning are rooted in the observation that random data vectors arising from a mixture distribution (say Gaussian) gather in “groups” of close-by vectors in the Euclidean norm. When dealing with large-dimensional data, however, concentration phenomena arise that make Euclidean distances useless, if not counterproductive: Vectors from the same mixture class may be further away in Euclidean distance than vectors arising from different classes. While classification may still be doable, it works in a rather different way from our small-dimensional intuition. The book intends to prepare the reader for the multiple traps caused by this “curse of dimensionality.”

计算机代写|机器学习代写machine learning代考|Sample Covariance Matrices in the Large n,p Regime

Let us consider the following example that illustrates a first elementary, yet counterintuitive, result: For simultaneously large $n, p$, the sample covariance matrix $\hat{\mathbf{C}} \in \mathbb{R}^{p \times p}$ based on $n$ samples $\mathbf{x}i \sim \mathcal{N}(\mathbf{0}, \mathbf{C})$ is an entry-wise consistent estimator of the population covariance $\mathbf{C} \in \mathbb{R}^{p \times p}$ (i.e., $|\hat{\mathbf{C}}-\mathbf{C}|{\infty} \rightarrow 0$ as $p, n \rightarrow \infty$ for $|\mathbf{A}|_{\infty} \equiv \max {i j}\left|\mathbf{A}{i j}\right|$ ) while overall being an extremely poor estimator in a (more practical) operator norm sense (i.e., $|\hat{\mathbf{C}}-\mathbf{C}| \nrightarrow 0$, with $|\cdot|$ being the operator norm here). Matrix norms are, in particular, not equivalent in the large $n, p$ scenario.

Let us detail this claim, in the simplest case where $\mathbf{C}=\mathbf{I}p$. Consider a dataset $\mathbf{X}=\left[\mathbf{x}_1, \ldots, \mathbf{x}_n\right] \in \mathbb{R}^{p \times n}$ of $n$ independent and identically distributed (i.i.d.) observations from a $p$-dimensional standard Gaussian distribution, that is, $\mathbf{x}_i \sim \mathcal{N}\left(\mathbf{0}, \mathbf{I}_p\right)$ for $i \in{1, \ldots, n}$. We wish to estimate the population covariance matrix $\mathbf{C}=\mathbf{I}_p$ from the $n$ available samples. The maximum likelihood estimator in this zero-mean Gaussian setting is the sample covariance matrix $\hat{\mathbf{C}}$ defined by $$ \hat{\mathbf{C}}=\frac{1}{n} \sum{i=1}^n \mathbf{x}_i \mathbf{x}_i^{\top}=\frac{1}{n} \mathbf{X} \mathbf{X}^{\top}

$$

By the strong law of large numbers, for fixed $p, \hat{\mathbf{C}} \rightarrow \mathbf{I}_p$ almost surely as $n \rightarrow \infty$, so that $\left|\hat{\mathbf{C}}-\mathbf{I}_p\right| \stackrel{\text { a.s. }}{\longrightarrow} 0$ holds for any standard matrix norm and in particular for the operator norm.

One must be more careful when dealing with the case $n, p \rightarrow \infty$ with the ratio $p / n \rightarrow$ $c \in(0, \infty)$ (or, from a practical standpoint, $n$ is not much larger than $p$ ). First, note that the entry-wise convergence still holds since, invoking the law of large numbers again,

$$

[\hat{\mathbf{C}}]{i j}=\frac{1}{n} \sum{l=1}^n[\mathbf{X}]{i l}[\mathbf{X}]{j l} \stackrel{\text { a.s. }}{\longrightarrow} \begin{cases}1, & i=j \ 0, & i \neq j .\end{cases}

$$

Besides, by a concentration inequality argument, it can even be shown that

$$

\max {1 \leq i, j \leq p}\left|\left[\hat{\mathbf{C}}-\mathbf{I}_p\right]{i j}\right| \stackrel{\text { a.s. }}{\longrightarrow} 0

$$

which holds as long as $p$ is no larger than a polynomial function of $n$, and thus:

$$

\left|\hat{\mathbf{C}}-\mathbf{I}p\right|{\infty} \stackrel{\text { a.s. }}{\longrightarrow} 0 \text {. }

$$

Consider now the case $p>n$. Since $\hat{\mathbf{C}}=\frac{1}{n} \sum_{i=1}^n \mathbf{x}_i \mathbf{x}_i^{\top}$ is the sum of $n$ rank-one matrices, the rank of $\hat{\mathbf{C}}$ is at most equal to $n$ and thus, being a $p \times p$ matrix with $p>n$, the sample covariance matrix $\hat{\mathbf{C}}$ must be a singular matrix having at least $p-n>0$ null eigenvalues. As a consequence,

$$

\left|\hat{\mathbf{C}}-\mathbf{I}_p\right| \not \neg

$$

for $|\cdot|$ the matrix operator (or spectral) norm.

机器学习代考

计算机代写|机器学习代写machine learning代考|The Pitfalls of Large-Dimensional Statistics

大数据革命伴随着解析、挖掘和压缩大量大维和可能异构数据的挑战性需求。在许多应用中,维度p的意见是一样大−如果不大于 – 他们的数量n. 在阵列处理和无线通信中,精细定位分辨率或增加通信吞吐量所需的天线数量可能与可用的独立信号观测数量一样大(如今约为数百个)[Li and Stoica, 2007, Lu et al ., 2014]。在基因组学中,基于有限数量的独立(且昂贵)样本识别数十万个基因之间的相关性会导致更大的比率p/n[阿诺德等人,1994 年]。在统计金融中,投资组合优化依赖于大量投资的需要p的资产以减少波动性,但同时从相对较小的数量估计当前(而不是过去)的资产统计数据n资产回报记录 [Laloux et al., 2000]。

正如我们将在下一节中证明的那样,在这些问题中n不比p消除了假设的标准渐近统计的大部分结果n单独很大 [Vaart, 2000]。根据经验,我们这里所说的“大得多”是指n必须至少大于 100 倍p为了使标准渐近统计具有实际便利性(请参阅我们在第 1.1.2 节中的论点)。统计学、信号处理和机器学习中的许多算法正是源自于此n≫p今天不再适用的假设。本书的一个主要目标是阐明由此产生的偏差和产生的问题,并提供一个系统的随机矩阵框架来改进这些算法。

可能更重要的是,我们将在本书中看到(小p) 作为许多机器学习算法核心的小维直觉(从谱聚类开始 [Ng 等人,2002 年,Luxburg,2007 年])在同时应用于大n,p环境。一个引人注目的例子是向量之间的“距离”概念。机器学习中的大多数分类方法都基于这样的观察,即混合分布(例如高斯分布)产生的随机数据向量聚集在欧几里得范数中的邻近向量“组”中。然而,在处理大维数据时,会出现集中现象,这使得欧氏距离即使不会适得其反也毫无用处:来自同一混合类的向量在欧氏距离上可能比来自不同类的向量更远。虽然分类可能仍然可行,但它的工作方式与我们的小维度直觉截然不同。本书旨在让读者为这种“维度灾难”造成的多重陷阱做好准备。

计算机代写|机器学习代写machine learning代考|Sample Covariance Matrices in the Large n,p Regime

让我们考虑以下示例,该示例说明了第一个基本但违反直觉的结果:同时大 $n, p$ ,样本协方差矩阵 $\hat{\mathbf{C}} \in \mathbb{R}^{p \times p}$ 基于 $n$ 样本 $\mathbf{x} i \sim \mathcal{N}(\mathbf{0}, \mathbf{C})$ 是总体协方差的逐项一致估计量 $\mathbf{C} \in \mathbb{R}^{p \times p}$ (IE, $|\hat{\mathbf{C}}-\mathbf{C}| \infty \rightarrow 0$ 作为 $p, n \rightarrow \infty$ 为了 $|\mathbf{A}|{\infty} \equiv \max i j|\mathbf{A} i j|$ ) 而在 (更实际的) 操作员范数意义上总 体上是一个极差的估计器(即, $|\hat{\mathbf{C}}-\mathbf{C}| \nrightarrow 0$ ,和 $|\cdot|$ 在这里成为运营商规范)。特别是,矩阵范数在 大 $n, p$ 设想。 让我们详细说明这个说法,在最简单的情况下 $\mathbf{C}=\mathbf{I} p$. 考虑一个数据集 $\mathbf{X}=\left[\mathbf{x}_1, \ldots, \mathbf{x}_n\right] \in \mathbb{R}^{p \times n}$ 的 $n$ 来自 $\mathrm{a}$ 的独立同分布 (iid) 观察 $p$ 维标准高斯分布,即 $\mathbf{x}_i \sim \mathcal{N}\left(\mathbf{0}, \mathbf{I}_p\right)$ 为了 $i \in 1, \ldots, n$. 我们布望估计 总体协方差矩阵 $\mathbf{C}=\mathbf{I}_p$ 来自 $n$ 可用样品。此零均值高斯设置中的最大似然估计量是样本协方差矩阵 $\hat{\mathbf{C}}^{\text {被 }}$ 定义为 $$ \hat{\mathbf{C}}=\frac{1}{n} \sum i=1^n \mathbf{x}_i \mathbf{x}_i^{\top}=\frac{1}{n} \mathbf{X X}^{\top} $$ 由大数定律,对于固定的 $p, \hat{\mathbf{C}} \rightarrow \mathbf{I}_p$ 几乎肯定是 $n \rightarrow \infty$ ,以便 $\left|\hat{\mathbf{C}}-\mathbf{I}_p\right| \stackrel{\text { a.s. }}{\longrightarrow} 0$ 适用于任何标准矩阵 范数,尤其适用于算子范数。 办案更要慎重 $n, p \rightarrow \infty$ 与比率 $p / n \rightarrow c \in(0, \infty)$ (或者,从实际的角度来看, $n$ 不比 $p$ ). 首先,请注 意入口方向的收敛仍然成立,因为再次调用大数定律, $$ [\hat{\mathbf{C}}] i j=\frac{1}{n} \sum l=1^n[\mathbf{X}] i l[\mathbf{X}] j l \stackrel{\text { a.s. }}{\longrightarrow}{1, \quad i=j 0, \quad i \neq j . $$ 此外,通过集中不等式的论证,甚至可以证明 $$ \max 1 \leq i, j \leq p\left|\left[\hat{\mathbf{C}}-\mathbf{I}_p\right] i j\right| \stackrel{\text { a.s. }}{\longrightarrow} 0 $$ 只要 $p$ 不大于的多项式函数 $n$ ,因此: $$ |\hat{\mathbf{C}}-\mathbf{I} p| \infty \stackrel{\text { a.s. }}{\longrightarrow} 0 . $$ 考虑现在的情况 $p>n$. 自从 $\hat{\mathbf{C}}=\frac{1}{n} \sum{i=1}^n \mathbf{x}_i \mathbf{x}_i^{\top}$ 是总和 $n$ 秩 矩阵,秩为 $\hat{\mathbf{C}}$ 至多等于 $n$ 因此,作为一个 $p \times p$ 矩阵与 $p>n$ ,样本协方差矩阵 $\hat{\mathbf{C}}$ 必须是奇异矩阵至少有 $p-n>0$ 空特征值。作为结果,

$$

\left|\hat{\mathbf{C}}-\mathbf{I}_p\right| \not

$$

为了 $|\cdot|$ 矩阵运算符 (或谱) 范数。

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。

金融工程代写

金融工程是使用数学技术来解决金融问题。金融工程使用计算机科学、统计学、经济学和应用数学领域的工具和知识来解决当前的金融问题,以及设计新的和创新的金融产品。

非参数统计代写

非参数统计指的是一种统计方法,其中不假设数据来自于由少数参数决定的规定模型;这种模型的例子包括正态分布模型和线性回归模型。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

术语 广义线性模型(GLM)通常是指给定连续和/或分类预测因素的连续响应变量的常规线性回归模型。它包括多元线性回归,以及方差分析和方差分析(仅含固定效应)。

有限元方法代写

有限元方法(FEM)是一种流行的方法,用于数值解决工程和数学建模中出现的微分方程。典型的问题领域包括结构分析、传热、流体流动、质量运输和电磁势等传统领域。

有限元是一种通用的数值方法,用于解决两个或三个空间变量的偏微分方程(即一些边界值问题)。为了解决一个问题,有限元将一个大系统细分为更小、更简单的部分,称为有限元。这是通过在空间维度上的特定空间离散化来实现的,它是通过构建对象的网格来实现的:用于求解的数值域,它有有限数量的点。边界值问题的有限元方法表述最终导致一个代数方程组。该方法在域上对未知函数进行逼近。[1] 然后将模拟这些有限元的简单方程组合成一个更大的方程系统,以模拟整个问题。然后,有限元通过变化微积分使相关的误差函数最小化来逼近一个解决方案。

tatistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

随机分析代写

随机微积分是数学的一个分支,对随机过程进行操作。它允许为随机过程的积分定义一个关于随机过程的一致的积分理论。这个领域是由日本数学家伊藤清在第二次世界大战期间创建并开始的。

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。