如果你也在 怎样代写机器学习Machine Learning这个学科遇到相关的难题,请随时右上角联系我们的24/7代写客服。

机器学习是人工智能(AI)和计算机科学的一个分支,主要是利用数据和算法来模仿人类的学习方式,逐步提高其准确性。

机器学习是不断增长的数据科学领域的一个重要组成部分。通过使用统计方法,算法被训练来进行分类或预测,在数据挖掘项目中发现关键的洞察力。这些洞察力随后推动了应用程序和业务的决策,最好是影响关键的增长指标。随着大数据的不断扩大和增长,市场对数据科学家的需求将增加,需要他们协助确定最相关的业务问题,随后提供数据来回答这些问题。

statistics-lab™ 为您的留学生涯保驾护航 在代写机器学习Machine Learning方面已经树立了自己的口碑, 保证靠谱, 高质且原创的统计Statistics代写服务。我们的专家在代写机器学习方面经验极为丰富,各种代写机器学习Machine Learning相关的作业也就用不着说。

我们提供的机器学习Machine Learning及其相关学科的代写,服务范围广, 其中包括但不限于:

- Statistical Inference 统计推断

- Statistical Computing 统计计算

- Advanced Probability Theory 高等楖率论

- Advanced Mathematical Statistics 高等数理统计学

- (Generalized) Linear Models 广义线性模型

- Statistical Machine Learning 统计机器学习

- Longitudinal Data Analysis 纵向数据分析

- Foundations of Data Science 数据科学基础

统计代写|机器学习作业代写Machine Learning代考|Deep Learning

Desp Learning has recently become a buzzword for some good rcasons though the attempt to improve deep learning practices are not the first of it kind. However, it is quite understandable why deep learning has been appreciated for nearly two decades. Deep learning is an abstract concept, which makes it hard to define in a couple of words.

Differently from neural network, deep learning has more complex structure and hidden layers define the complexity. Therefore, some researchers use

number of hidden layer as a comparison benchmark to distinguish the neural network and deep learning, it is useful but not a rigorous way to make this separation. So, a decent definition makes thing clear.

At a high level, deep learning can be defined as:

Deep-learning methods are representation-learningfootnote:

[Representation learning helps us to define a concept in a unique way. For instance, if the task is to detect whether or not it is a circle, then edges play a key role as circle has no edge. So, using color, shape, size, we can create a representation for an object. In essence, this is how human brain works and we know that deep learning structure inspires from the functioning of it.] methods with multiple levels of representation, obtained by composing simple but non-linear modules that each transform the representation at one level (starting with the raw input) into a representation at a higher, slightly more abstract level.

-Le Cunn et al. (2015)

Applications of deep learning dates back to 1940 s in which Cybernetics is published and then Connectivist thinking dominates the years between 1980s and 1990s.Finally, recent development in deep learning such as backpropagation and neural network has created the field as we know as deep learning. Well, basically we are talking about three waves of deep learning and now, it is tempting to ask why deep learning is living its heyday? Goodfellow et al. (2016) list some plausible reasons, which are:

- Increasing Data Sizes

- Increasing Model Sizes

- Increasing Accuracy, Complexity, and Real World Impact

It seems like modern technology and data availability pave the way for deep learning era in which new data-driven methods are proposed so that we are able to model time series using unconventional models. This development has given rise a new wave of Deep Learning. In Deep Learning, two methods stand out with their ability to include longer time periods: “Recurrent Neural Network” (RNN) and “Long Short-Term Memory” (LSTM).

统计代写|机器学习作业代写Machine Learning代考|Recurrent Neural Network

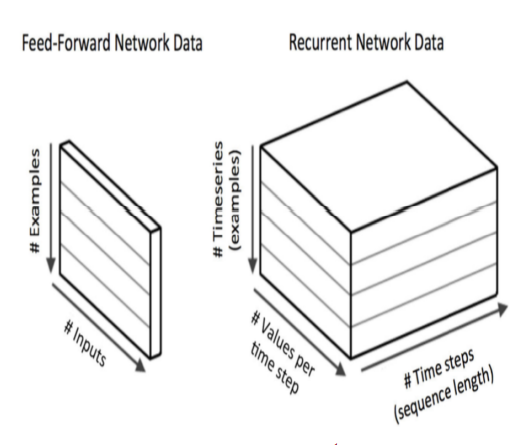

Recurrent Neural Network has a neural network structure with at least one feedback connection so that network can learn sequences. Feedback connection results in a loop enabling us unveil the non-linear characteristics. This type of connection brings us a new and quite useful property: Memory. Thus, RNN cannot only make use of the input data, but also the previous outputs, which sounds compelling when it comes to time series modeling. RNN comes in many forms such as:

- One-to-One: It consists of single input and single output, which makes it most basic type of RNN.

- One-to-Many: In this form, RNN produces multiple outputs for a single input.

- Many-to-One: As opposed to One-to-Many structure, Many-to-one has multiple inputs for a singly output.

- Many-to-Many: It has multiple outputs and inputs and is known as most complicated structure of RNN.

Hidden unit in RNN feeds itself back into the neural network so that RNN has, unlike feed-forward neural network, recurrent layers, which makes it a suitable method to model a time series data. Therefore, in RNN, activations of a neuron comes from previous time step indication that RNN represents accumulating state of the network instance (Buduma, 2017)

As summarized by Nielsen (2019):

- RNN has time steps one at a time in an orderly fashion.

- The state of the network stays as it is from one time step to another.

统计代写|机器学习作业代写Machine Learning代考|Long-Short Term Memory

Long-Short Term Memory, LSTM for short, deep learning approach has been developed by Hochreiter and Schmidhuber $(1997)$ and it is mainly based on Gated Recurrent Unit (GRU).

GRU is proposed to deal with vanishing gradient problem, which is a common problem in neural network structure and occurs when weight update becomes too small to create a significant change in the network. GRU

consists of two gates: Update and reset. When an early observation is detected as highly important, then we do not update the hidden state. In a similar fashion, when early observations are not significant, it leads to reset the state.

As we previously discussed, the one of the most appealing features of RNN is its ability to connect past and present information. However, this ability turns out to be a failure when “long-term dependencies” comes into the picture. Long-term dependencies mean that model learns from early observations.

For instance, let us examine the following sentence:

Countries have their own currencies as in USA where people transact with dollar

In the case of short-dependencies, it is known that the next predicted word is about a currency but if it is asked which currency is that? Then, things get complicated as we might have various currencies in the text implying longterm dependencies. It is needed to go way back to find something relevant about country using dollar.

LSTM tries to attack the weakness of RNN in long-term dependencies in a way that LSTM has a quite useful tool to get rid of the unnecessary information so that it works more efficiently. LSTM works with gates, enabling LSTM to forget irrelevant data. These are:

- Forget gates

- Input gates

- Output gates

Forget gates is created to sort out the necessary and unnecessary information so that LSTM performs more efficiently than RNN. In doing so, the value of activation function, sigmoid, becomes zero if the information is irrelevant. Forget gate can be formulated as:

$$

F_{t}=\sigma\left(X_{t} W_{I}+h_{t-1} W_{f}+b_{f}\right)

$$

机器学习代写

统计代写|机器学习作业代写Machine Learning代考|Recurrent Neural Network

循环神经网络具有至少一个反馈连接的神经网络结构,因此网络可以学习序列。反馈连接导致一个循环,使我们能够揭示非线性特性。这种类型的连接为我们带来了一个新的非常有用的属性:内存。因此,RNN 不仅可以利用输入数据,还可以利用之前的输出,这在时间序列建模方面听起来很有吸引力。RNN 有多种形式,例如:

- 一对一:由单输入单输出组成,是RNN的最基本类型。

- 一对多:在这种形式中,RNN 为单个输入生成多个输出。

- 多对一:与一对多结构相反,多对一具有多个输入,用于单个输出。

- 多对多:它有多个输出和输入,被称为RNN最复杂的结构。

RNN 中的隐藏单元将自身反馈到神经网络中,因此与前馈神经网络不同,RNN 具有循环层,这使其成为建模时间序列数据的合适方法。因此,在 RNN 中,神经元的激活来自先前的时间步长指示,表明 RNN 表示网络实例的累积状态 (Buduma, 2017)

正如 Nielsen (2019) 总结的那样:

- RNN 有一个有序的时间步长。

- 从一个时间步到另一个时间步,网络的状态保持不变。

统计代写|机器学习作业代写Machine Learning代考|Long-Short Term Memory

长短期记忆,简称 LSTM,深度学习方法由 Hochreiter 和 Schmidhuber 开发(1997)它主要基于门控循环单元(GRU)。

GRU 被提出来处理消失梯度问题,这是神经网络结构中的一个常见问题,当权重更新变得太小而无法在网络中产生显着变化时会发生。格鲁乌

由两个门组成:更新和重置。当早期观察被检测为非常重要时,我们不会更新隐藏状态。以类似的方式,当早期观察不重要时,它会导致重置状态。

正如我们之前所讨论的,RNN 最吸引人的特性之一是它能够连接过去和现在的信息。然而,当“长期依赖”出现时,这种能力就失败了。长期依赖意味着模型从早期观察中学习。

例如,让我们检查以下句子:

国家有自己的货币,就像美国一样,人们用美元进行交易

在短期依赖的情况下,已知下一个预测词是关于一种货币的,但如果问它是哪种货币?然后,事情变得复杂,因为我们可能在文本中使用各种货币来暗示长期依赖关系。需要回溯到使用美元找到与国家相关的东西。

LSTM 试图攻击 RNN 在长期依赖方面的弱点,LSTM 有一个非常有用的工具来消除不必要的信息,从而使其更有效地工作。LSTM 与门一起工作,使 LSTM 能够忘记不相关的数据。这些都是:

- 忘记大门

- 输入门

- 输出门

创建遗忘门是为了整理出必要和不必要的信息,以便 LSTM 比 RNN 更有效地执行。在此过程中,如果信息不相关,则激活函数 sigmoid 的值将变为零。遗忘门可以表述为:

F吨=σ(X吨在一世+H吨−1在F+bF)

统计代写请认准statistics-lab™. statistics-lab™为您的留学生涯保驾护航。统计代写|python代写代考

随机过程代考

在概率论概念中,随机过程是随机变量的集合。 若一随机系统的样本点是随机函数,则称此函数为样本函数,这一随机系统全部样本函数的集合是一个随机过程。 实际应用中,样本函数的一般定义在时间域或者空间域。 随机过程的实例如股票和汇率的波动、语音信号、视频信号、体温的变化,随机运动如布朗运动、随机徘徊等等。

贝叶斯方法代考

贝叶斯统计概念及数据分析表示使用概率陈述回答有关未知参数的研究问题以及统计范式。后验分布包括关于参数的先验分布,和基于观测数据提供关于参数的信息似然模型。根据选择的先验分布和似然模型,后验分布可以解析或近似,例如,马尔科夫链蒙特卡罗 (MCMC) 方法之一。贝叶斯统计概念及数据分析使用后验分布来形成模型参数的各种摘要,包括点估计,如后验平均值、中位数、百分位数和称为可信区间的区间估计。此外,所有关于模型参数的统计检验都可以表示为基于估计后验分布的概率报表。

广义线性模型代考

广义线性模型(GLM)归属统计学领域,是一种应用灵活的线性回归模型。该模型允许因变量的偏差分布有除了正态分布之外的其它分布。

statistics-lab作为专业的留学生服务机构,多年来已为美国、英国、加拿大、澳洲等留学热门地的学生提供专业的学术服务,包括但不限于Essay代写,Assignment代写,Dissertation代写,Report代写,小组作业代写,Proposal代写,Paper代写,Presentation代写,计算机作业代写,论文修改和润色,网课代做,exam代考等等。写作范围涵盖高中,本科,研究生等海外留学全阶段,辐射金融,经济学,会计学,审计学,管理学等全球99%专业科目。写作团队既有专业英语母语作者,也有海外名校硕博留学生,每位写作老师都拥有过硬的语言能力,专业的学科背景和学术写作经验。我们承诺100%原创,100%专业,100%准时,100%满意。

机器学习代写

随着AI的大潮到来,Machine Learning逐渐成为一个新的学习热点。同时与传统CS相比,Machine Learning在其他领域也有着广泛的应用,因此这门学科成为不仅折磨CS专业同学的“小恶魔”,也是折磨生物、化学、统计等其他学科留学生的“大魔王”。学习Machine learning的一大绊脚石在于使用语言众多,跨学科范围广,所以学习起来尤其困难。但是不管你在学习Machine Learning时遇到任何难题,StudyGate专业导师团队都能为你轻松解决。

多元统计分析代考

基础数据: $N$ 个样本, $P$ 个变量数的单样本,组成的横列的数据表

变量定性: 分类和顺序;变量定量:数值

数学公式的角度分为: 因变量与自变量

时间序列分析代写

随机过程,是依赖于参数的一组随机变量的全体,参数通常是时间。 随机变量是随机现象的数量表现,其时间序列是一组按照时间发生先后顺序进行排列的数据点序列。通常一组时间序列的时间间隔为一恒定值(如1秒,5分钟,12小时,7天,1年),因此时间序列可以作为离散时间数据进行分析处理。研究时间序列数据的意义在于现实中,往往需要研究某个事物其随时间发展变化的规律。这就需要通过研究该事物过去发展的历史记录,以得到其自身发展的规律。

回归分析代写

多元回归分析渐进(Multiple Regression Analysis Asymptotics)属于计量经济学领域,主要是一种数学上的统计分析方法,可以分析复杂情况下各影响因素的数学关系,在自然科学、社会和经济学等多个领域内应用广泛。

MATLAB代写

MATLAB 是一种用于技术计算的高性能语言。它将计算、可视化和编程集成在一个易于使用的环境中,其中问题和解决方案以熟悉的数学符号表示。典型用途包括:数学和计算算法开发建模、仿真和原型制作数据分析、探索和可视化科学和工程图形应用程序开发,包括图形用户界面构建MATLAB 是一个交互式系统,其基本数据元素是一个不需要维度的数组。这使您可以解决许多技术计算问题,尤其是那些具有矩阵和向量公式的问题,而只需用 C 或 Fortran 等标量非交互式语言编写程序所需的时间的一小部分。MATLAB 名称代表矩阵实验室。MATLAB 最初的编写目的是提供对由 LINPACK 和 EISPACK 项目开发的矩阵软件的轻松访问,这两个项目共同代表了矩阵计算软件的最新技术。MATLAB 经过多年的发展,得到了许多用户的投入。在大学环境中,它是数学、工程和科学入门和高级课程的标准教学工具。在工业领域,MATLAB 是高效研究、开发和分析的首选工具。MATLAB 具有一系列称为工具箱的特定于应用程序的解决方案。对于大多数 MATLAB 用户来说非常重要,工具箱允许您学习和应用专业技术。工具箱是 MATLAB 函数(M 文件)的综合集合,可扩展 MATLAB 环境以解决特定类别的问题。可用工具箱的领域包括信号处理、控制系统、神经网络、模糊逻辑、小波、仿真等。